新智元报道

编辑:桃子艾伦

强化学习核心是什么?Karpathy 一语道破——环境。全新开源 Environments Hub 横空出世,为强化学习训练带去革命性突破。

强化学习时代,什么最重要?

Karpathy 给出了答案,环境!只有环境,才能让 LLM 真正进行交互、执行动作、观察结果。

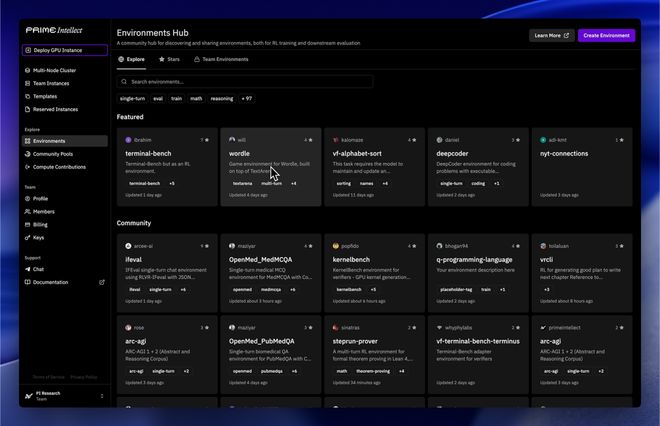

如今,一个开源的环境中心——Environments Hub 正式登场了,它由一家专注于去中心化 AI 开发公司 Prime Intellect 发布。

一直以来,RL 环境是割裂的、封闭的,甚至难以共享。

但有且只有环境,定义了世界、规则,以及「状态—动作—奖励」的反馈闭环。

从游戏到编程,再到聊天对话,它们是 AI 学习发生的场景。没有它们,RL 只是一套无从着力的算法。

Environments Hub 的诞生,能够让任何人模拟出各种各样、高质量的环境,为开源 AGI 做出贡献。

AI 智能体交互,缺的是环境

RL 环境,是智能体学习的试验场。

回想一下,在预训练时代,互联网数据是核心。LLM 主要通过大量多样,且高质量的数据来学习。

到了监督微调阶段,重点变成了「对话数据」。

人们会雇佣外包团队,来为问题创建答案,类似 Stack Overflow、Quora 平台的模式,但又专为 LLM 使用场景而设计。

如今到了强化学习时代,前两个阶段不会消失,但不同的是,环境成为了重心。

这些环境,可以用于模型训练,也可用于评估。不过,问题在于,如何创建出丰富多样的环境?

Karpathy 回忆道,OpenAI 最早的一个项目 Gym,一个希望用统一框架去构建大规模环境集合。

GitHub 地址:https://github.com/openai/gym

不过,这都是近十年前,大模型还未兴起的项目了。所以,当时的环境,都是一些简单的经典控制任务,比如 cartpole、ATARI 之类的。

而现在,Environments Hub 是一个专门针对 LLM 构建的版本。

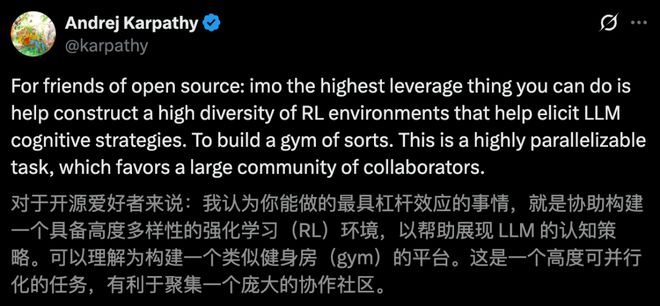

Karpathy 激动地表示,「这是个非常棒的努力和想法」。今年初,他还发文建议过有人应该做类似的事情。

Environments Hub 有个特点,一旦框架构建完成,原则上社区和行业就可以在不同领域并行开发。

而且,环境和智能体交互的方向,是下一个未来。

大厂斥资几百万,搞出围墙花园

为什么需要打造一个 Environments Hub 呢?

目前,多数强化学习环境是由初创公司构建,并将其出售给少数几家不对外开放的大型实验室。

如果高质量的学习环境一直保持封闭且昂贵,开源模型将进一步落后于闭源模型。

要想扭转这种局势,需要有一个强大的开源学习环境和训练工具生态系统能崛起。

Environments Hub 正是承载着这个使命应运而生,旨在让下一波初创公司和 AI 的发展能够构建于开放的基础设施和开源模型之上。

核心功能,一键生成评估报告

总结来说,Environments Hub 具备了以下功能亮点:

-

通过 Hub 或 CLI(命令行)拉取、推送并管理环境

-

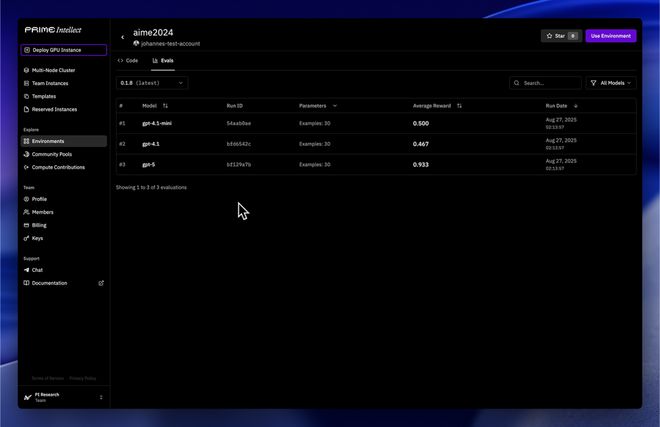

生成跨模型的评测报告

-

与 verifiers 框架深度集成

-

prime-rl 训练器原生支持环境

-

提供用于代码执行的原生沙箱支持

你可以创建、管理和共享用于强化学习及评估的环境:

可以为不同模型创建和浏览环境评估报告:

可扩展训练器 prime-rl 原生支持这些环境:

还有沙盒功能,可直接与 Verifier Environments 对接,以实现安全的代码执行。

如果还有你需求的功能没有满足,你也可以亲自作为该开源项目开发者去贡献代码。

下一步:全栈式开源 AGI 基础设施

过去几个月中,Environments Hub 将基于 Agent 的强化学习训练扩展到规模最大的开源模型,并取得了显著进展。

随着众多众包环境被引入 INTELLECT-3,训练出一个完全开放、最先进的 Agent 模型将成为可能。

除此之外,Environments Hub 关心的重点是,让人人都能用上这套基础设施,使研究人员和初创公司都能为自己的任务训练模型、集成工具、运行强化微调,以及优化 Agent 支撑框架。

prime-rl 的整个技术栈都是开源的,正在扩展到全球的计算资源上无缝运行。

强化学习不仅是通往 AGI 的必经之路,也是构建 AI 原生产品的基础。

未来最成功的初创公司,将是那些能根据自身需求,创造出差异化环境的公司。

如今,最大的障碍并非获取强大模型,而在于大规模训练和部署它们所需的基础设施及成本。

通过降低这一门槛,Environments Hub 旨在为所有 AI 构建者提供廉价、无缝的计算、推理和训练资源,以及全套的强化学习基础设施。

参考资料: