新智元报道

编辑:桃子定慧

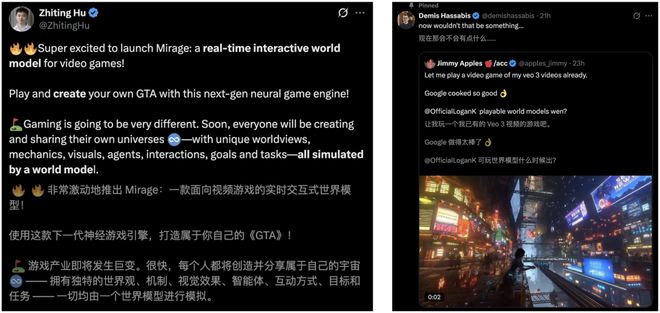

谁曾想,AI 竟能实时生成 GTA 级大作。刚刚,谷歌、英伟达等机构联手,震撼发布全球首款 AI 原生 UGC 游戏引擎——Mirage,没有预设关卡,一句话即生游戏,超长十分钟沉浸式体验。

全球首款 AI 原生 UGC 游戏引擎诞生了!

今天,谷歌、英伟达、微软等八大机构联手,一同祭出了这款实时 AI 游戏引擎——Mirage。

传送门:https://blog.dynamicslab.ai/

它不同于传统游戏引擎,而是玩家想象力的「放大器」,任何人可以随心所欲「造」游戏!

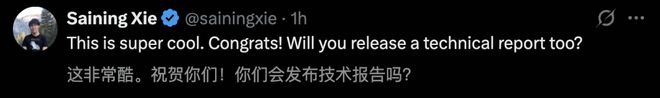

如今,团队直接上线了两个超燃的实时演示(试玩版本),一个是 GTA 风格的都市乱斗(Urban Chaos)。

游戏操作延用传统风格,你可以自由走动,移动视角并且奔跑。

另一个是极限竞速:地平线风格的海岸漂移(Coastal drift)。

AI 原生 UGC 游戏的神奇之处就在于,你可以任意改变游戏内容。

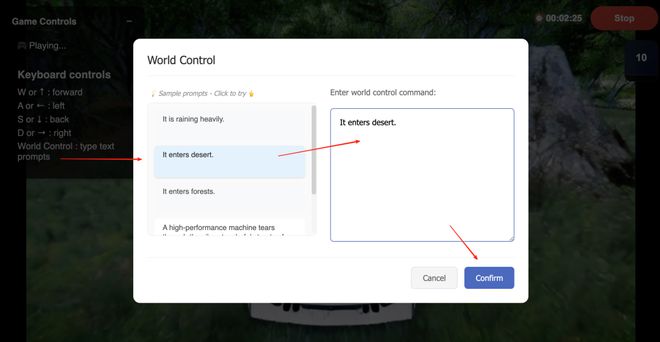

比如在 GTA 风格的都市乱斗中,可以通过 Enter 键调出「世界控制」面板后,选择「阴云密布大雨降至」。

游戏画面马上就从晴空万里变成了黑云压城。

比如,在上面的海岸漂移中,通过 Enter 键调出「世界控制」面板后,可以输入「进入沙漠」。

然后游戏画面就会从绿洲直接变成沙漠!简直比《头号玩家》还要一颗赛艇!

老黄曾预言,「用不了十年,我们就能看到游戏中每个像素都是由 AI 实时生成的」。

Mirage 的登场,不仅让这一愿景更近一步,也预示着未来的游戏产业将迎来巨变。

就连 Hassabis 也很看好 Veo 3 生成的视频游戏

「动嘴」实时体验 GTA 大作

10 分钟超长游玩

传统游戏中,城市布局、任务剧情,一般都是事先设定好的,体验终究有限。

Mirage 彻底打破了这一局限,让玩家在游戏过程中动态创造全新的体验。

AI 大神谢赛宁大赞:太酷了

现在,仅通过自然语言、键盘输入,或是游戏柄,玩家即可请求一条逃生的小象、生成一辆载具,或即时扩展的城市天际线。

举个栗子,来一场倾盆大雨,动动嘴皮子就成了。

再比如,玩超级马里奥时,一句「出现砖块」,Mirage 就会为你实时生成。

可以看到,游戏会立即给出响应,将生成的元素,无缝融合到正在进行的模拟中。

这个 AI 游戏世界不仅仅是可交互的,还能与玩家「共同演化」。

此前,初创公司 Decart 和 Etched 上线的实时神经游戏引擎 Oasis,实现了 20 帧/秒的零延迟交互。

这一次,Mirage 的强大能力,直接掀翻了天花板,究竟有多硬核?

· 16 FPS 流畅可玩:在标准清晰度下,享受实时交互体验。

· 动态用户生成内容(UGC):玩家可以用自然语言指令改变世界。

· 更长游戏时间:Mirage 可生成长达数分钟、且视觉效果连贯的交互式游戏体验。

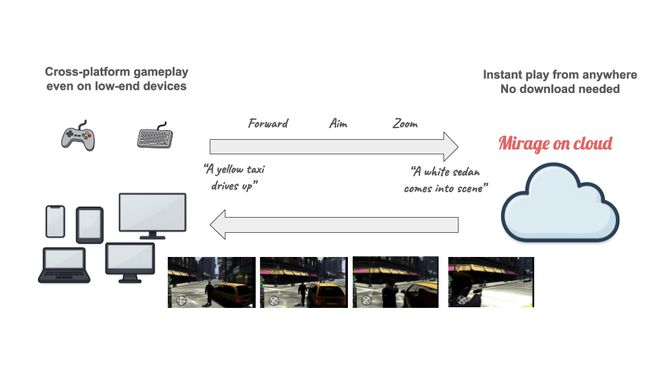

· 云端串流:无需下载,随时随地享受即时跨平台游戏。

· 无限可玩性:每一次游戏,都是独一无二的体验。

· 多模态操控:支持文本、键盘及手柄输入。

从今天起,玩家可以彻底告别千篇一律的预设关卡,在 Mirage 中无限编辑、扩展,甚至从零打造全新的世界。

更令人惊艳的是,Mirage 的画面和操作感,直逼 GTA、Forza 风格的沉浸式体验,远超「我的世界」、「毁灭战士」那样简约化的风格。

它还能支持5-10 分钟,甚至更长时间的持续游玩,打破了短短几秒的片刻体验。

不论是赛车游戏、角色扮演游戏,还是平台跳跃游戏,Mirage 都能一键生成。

接下来,一起看看 Mirage 如何重塑 UGC 2.0。

UGC 2.0

生成式游戏崛起

什么是生成式游戏?

就是游戏的未来并非由专家设计师设计,而是完全靠你的想象实时生成、实时游戏。

比如你输入「一辆黄色计程车突然从街角出现,出现在主角右边」。

然后游戏画面中就会实时「生成」一辆描述中的黄色计程车。

再比如输入「一辆灰色轿车从街道右边出现,并停在主角身边」,然后你就会发现游戏画面中「真的出现」一辆灰色轿车。

你甚至可以跳到轿车的车顶。

传统游戏,不论是休闲游戏还是开放世界的 3A 大作,都是预先创作好的。

城市布局、任务剧情都是事先设定好的,玩家的体验最终有限。

Mirage 打破了这一界限,通过自然语言和控制器,玩家可以如同开了「外挂」一般,可以随时随地按照想象扩展游戏。

比如请求一条逃生的小巷、或者生成一辆载具。

MIRAGE 可以生成各种类型的游戏——从竞速游戏到角色扮演游戏再到平台动作游戏。

你可以驾驶未来战机飞行于空旷的末日世界。

可以漫步于曼哈顿街头,体验 GTA5 的主角日常。

或者是地平线风格的赛车游戏。

或者是赛艇游戏。

你甚至可以生成一个全新的马里奥游戏。

赛车游戏也不在话下,限量版 F1 风格兰博基尼你值得拥有。

这就是 AI 原生 UGC 2.0,在这里,你就是造物主。

在这里,任何人都可以通过简单的文本提示生成属于自己的游戏。

在这里,玩家可以在游戏过程中实时创造、进化并重塑游戏内容。

并且,每一次体验都是独特、动态且无需预先编写脚本的。

背后技术

「世界模型」立大功

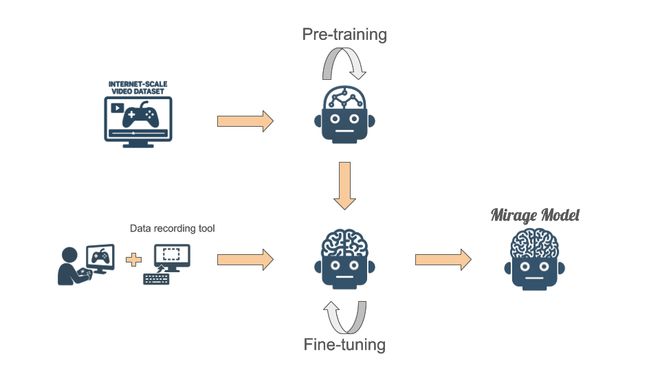

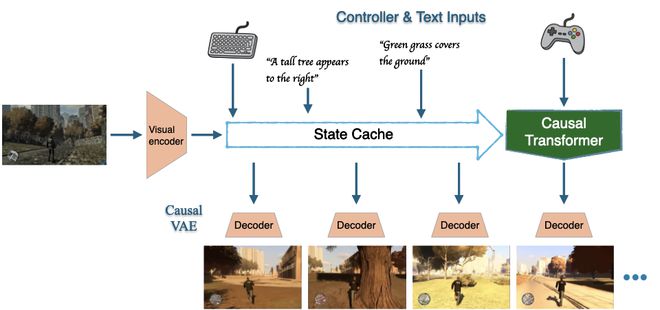

Mirage 的核心是一个实时的交互式「世界模型」,基于 Transformer 和扩散模型完成训练。

该框架整合了多项关键创新,由此能够生成可控、高保真的视频游戏序列。

Mirage 的强大体验,是建立在训练基础之上。

最关键因素,便是从互联网上收集的大规模多样化的游戏数据,提供了足够的广度来捕捉各种游戏机制和风格。

为此,研究团队开发了一款专用的数据记录工具,用于捕捉高质量的人类录制的游戏互动。

这些精心整理的会话,通过细微且高保真的示例丰富了数据集,对于训练模型理解复杂的玩家行为和情境化游戏逻辑至关重要。

然后,收集和记录的数据随后会被输入到一个「垂直训练」流程中——这是一种专注于游戏领域的特定领域训练方法。

这使得模型能够深入内化游戏世界的规则、系统模式和交互动态。

最终,便得到了一个能够生成连贯、真实且灵活的游戏内容的模型,突破了传统预设游戏的限制。

「交互式生成」与「实时控制」完美融合

Mirage 将帧级提示词处理集成至其核心,重新定义了实时交互。

这使得玩家输入的键盘指令和自然语言提示词,都能在游戏过程中被即时解析。

对于玩家来说,通过云游戏实现了随处可玩:

· 动态输入系统:Mirage 以超低延迟处理玩家的输入(主要通过键盘和文本),实现近乎即时的响应。

· 实时输出:视觉更新通过一个全双工通信通道流回浏览器,输入与输出并行处理,从而消除延迟,确保流畅交互。

其底层技术架构是一套定制化的因果 Transformer 模型,并通过以下技术实现了增强。

其中包括,专门的视觉编码器、经过优化的位置编码、专为长时间交互序列而优化的结构。

值得一提的是,Mirage 继承了大模型和扩散模型的优势,支持生成连贯的高质量内容。

这里,研究团队对扩散模型组件采用了先进的蒸馏策略,以同时确保生成速度与内容质量。

玩家可随时通过自然语言重塑游戏环境,触发世界的即时更新。

由 KV 缓存支持的长上下文窗口,能够确保即便世界在实时演变,视觉效果也能保持连贯一致。

八大顶尖机构联手

造出最强 AI 游戏引擎

Mirage 由一支技术深厚且富有创造力的团队打造,团队成员包括了 AI 研究人员、工程师和设计师。

他们来自谷歌、英伟达、Amazon、SEGA、苹果、微软、卡内基梅隆大学和加州大学圣地亚哥分校。

通过 UGC 2.0,Mirage 致力于推动生成式世界模型的边界——每一次边界的拓展都将颠覆我们的想象力。

同时,生成式玩法不仅仅是一个功能,更是一种全新的媒介。

从报纸、广播到电视、手机,再到 3A 大作和 4K 视频,人类的媒介正在不断进化。

沃顿商学院 CS 教授 Ethan Mollick 实测后表示,Mirage 虽未完全到位,但已取得了进展。

还有网友被 Mirage 实时生成效果彻底惊艳了——这简直像 PS2!

Mirage 指向一个全新的未来,在那里游戏无需下载或者等待设计——它们将被想象、被提示、被生成,并被我们亲身体验。

一切才刚刚开始。

参考资料: