10 月 15 日消息,火山引擎在视频云技术大会上发布了大模型训练视频预处理方案。目前,该技术方案已应用于豆包视频生成模型。

火山引擎总裁谭待在活动致辞表示,在 AIGC、多模态等技术的共同推动下,用户体验在多个维度上经历着深刻转变,“基于抖音业务实践和与行业客户共创,火山引擎视频云正积极探索 AI 大模型与视频技术的深度融合,在技术底座、处理链路和业务增长层面为企业寻找解法。”谭待说。

据介绍,对训练视频进行预处理是保障大模型训练效果的重要前提。预处理过程可以统一视频的数据格式、提高数据质量、实现数据标准化、减少数据量以及处理标注信息,从而使模型能更高效地学习视频中的特征和知识,提升训练效果和效率。

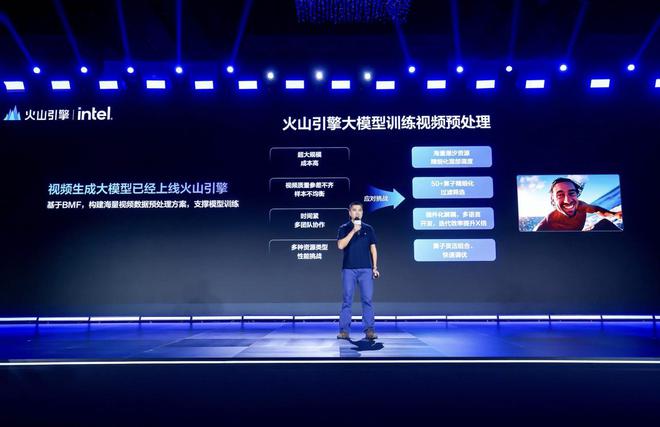

抖音集团视频架构负责人王悦表示,对大模型厂商而言,上述过程中面临着诸多挑战。

“首先,超大规模视频训练数据集导致计算和处理成本激增,”王悦说,“其次是视频样本数据参差不齐,然后是处理链路环节多、工程复杂,最后还面临着对 GPU、CPU、ARM 等多种异构算力资源的调度部署。”

借助 Intel 的 CPU、GPU 等不同资源,火山引擎此次发布的大模型训练视频预处理方案依托于自研的多媒体处理框架 BMF,能有效应对模型训练的算力成本挑战。此外,该方案还在算法和工程方面进行了调优,可以对海量视频数据高质量预处理,短时间内实现处理链路的高效协同,提高模型训练效率。值得一提的是,火山引擎本次还发布并开源了移动端后处理解决方案 BMF lite 版本。BMF lite 支持端侧大模型接入和算子加速,更加轻量、通用。

据了解,豆包视频生成模型 PixelDance 于 9 月 24 日发布,该模型采用 DiT 架构,通过高效的 DiT 融合计算单元和全新设计的扩散模型训练方法,突破了多主体运动的复杂交互、多镜头切换的内容一致性难题。目前,豆包视频生成模型已通过火山引擎面向企业开启邀测。(定西)