新智元报道

编辑:耳朵乔杨

Gary Marcus 再写长文整顿 AI 巨头圈:我们最该害怕的奥特曼是山姆·奥特曼。

2023 年 5 月 16 日,正值人工智能狂热的高峰期,OpenAI 首席执行官奥特曼,站在美国参议院司法小组委员会前,参与人工智能监督会议。

奥特曼在密苏里州圣路易斯长大,是斯坦福大学的辍学生,他在 30 岁之前就成为了非常成功的 Y Combinator 初创孵化器的总裁。

在听证会前几个月,ChatGPT 刚刚席卷了全世界。

整个 2023 年夏天,奥特曼都受到了披头士乐队一般的待遇,像世界巡演一样来到华盛顿,会见了世界各地的总理和总统。

美国参议员 Kyrsten Sinema 滔滔不绝地说,「我从未见过像 Sam 这样聪明的人,他性格内向且谦逊,但是非常擅长与国会议员建立关系,并且可以帮助政府人员了解人工智能。」

当时最美好的词汇都用形容这位年轻 CEO:真诚、才华横溢、富有、充满人文关怀等等。

他常常说人工智能可以改变全球经济,这让世界领导人对他的宏图大计都兴致勃勃。

被耍了?

参议员 Richard Blumenthal 将奥特曼和 Gary Marcus 都召集到华盛顿,讨论应该如何处理人工智能这把新兴科技的「双刃剑」,议程是人工智能政策和监管。

奥特曼代表 AI 巨头,Gary Marcus 作为一名科学家和作家到场。

这位 Gary Marcus 也是老朋友了,AGI 真有泡沫破裂的那天他领头等功。

「最先呼吁 GenAI 泡沫」

Marcus 在听证会当天也差点被奥特曼的人格魅力折服,虽然有时奥特曼会回避问题,但总的来说,他看起来很真诚。

两人在会上都强烈支持人工智能监管。但渐渐地,Marcus 意识到自己、参议院以及美国人民可能都被「耍」了。

事实上,Marcus 一直对 OpenAI 抱有一些疑虑。

OpenAI 新闻宣传活动经常夸大其词,甚至具有误导性,例如他们对机器人玩魔方的花哨演示,结果发现魔方内部装有特殊传感器。

多年来,OpenAI 这个名字,以及他们非营利组织的定位,都代表了科技创造的一种开放性。然而事实上,随着时间的推移,它变得越来越不 Open。

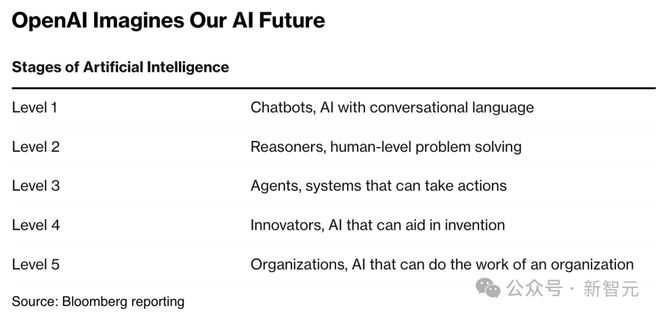

OpenAI 经常暗示 AGI 即将到来,在 Marcus 看来,这是毫无根据的炒作,奥特曼却用不同的话术吹得让人眼花缭乱。

在参议院,奥特曼给自己立了一个无私热血的人设。参议员 John Kennedy 问道,「好吧,你赚了很多钱吗?」

奥特曼回答说,「并没有,我得到的钱足以支付医疗保险的费用。我没有 OpenAI 的股权。」他解释说,「我这样做是因为我热爱 AI」参议员们听了都很受用。

然而,Marcus 写道,奥特曼并没有说出全部真相。他的确没有持有 OpenAI 的任何股票,但他持有 Y Combinator 的股票,而 Y Combinator 也持有 OpenAI 的股票。

这意味着奥特曼间接拥有 OpenAI 的股份,这一事实在 OpenAI 的网站上也可以确认。

如果间接持股仅占公司价值的 0.1%,那么其价值将接近 1 亿美元。

这一模糊的表达就是一个警告信号。当话题回来时,奥特曼本可以补充和纠正它,但他没有这么做。

人们总喜欢听热血青年无私创业的神话,他在《财富》杂志的一篇文章中也声称他不需要 OpenAI 的股权, 。

不久之后的宫斗大戏中,OpenAI 转头与奥特曼投资的一家芯片公司达成了交易。

最搞笑的是,两家公司总部都在旧金山,相距不到一公里,走个路十来分钟就到。

事后看来,关于金钱的讨论并不是奥特曼在参议院期间唯一不完全坦诚的事情。

言行不一

更重要的是 OpenAI 对人工智能监管的立场,奥特曼公开告诉参议院他支持这一法案,而事实表明,奥特曼的言行并不一致。

一方面,也许奥特曼头脑中的一小部分确实支持人工智能监管。

他多次提到奥本海默,表示他与曼哈顿计划的领导人同一天生日,也认识到了 AI 就像核武器一样,对人类构成严重风险。

用他自己在参议院所说的话说,「看,我们已经非常清楚地了解其中的风险……我最担心的是我们会造成负面影响,AI 技术对世界造成巨大伤害。」

但在私下里,他的游说者不断推动放松 AI 监管,或者根本不监管。

参议院听证会 1 个月后,有消息称 OpenAI 正在努力淡化欧盟的人工智能法案。

当他于 2023 年 11 月因对董事会「始终不坦诚」而被 OpenAI 解雇时,Marcus 并不感到惊讶。

当时,很少有人支持董事会解雇奥特曼的决定,大批支持者前来帮助他。

许多人是奥特曼的忠实粉丝,Marcus 发现著名记者 Kara Swisher 在推特上屏蔽了他,仅仅因为 Marcus 暗示了董事会这样做可能有道理。

另外,奥特曼也利用了媒体。五天后,由于 OpenAI 的主要投资者微软的帮助,以及员工支持撰写请愿书,他被复职。

但自那以后,民众对于奥特曼的态度也发生了变化,近几个月来,对奥特曼的担忧和批评从小众到了附和不断。

记者 Edward Zitron 写道,奥特曼是「一个假先知,一个肮脏的骗子,利用他非凡的能力来打动和操纵硅谷的精英」。

彭博新闻社的 Ellen Huet 在播客 Foundering 上得出的结论是,「当奥特曼说某事时,你无法确定他是否真的是这个意思」。

人工智能先驱 Geoffrey Hinton 最近也开始质疑奥特曼的动机。

Marcus 写了一篇名为《山姆·奥尔特曼剧本》的文章,剖析了他如何以表面谦逊的方式大肆宣传,成功地愚弄了大众这么长时间。

对于一些人来说,奥特曼人设崩塌的导火索是和演员斯嘉丽·约翰逊的纠纷。

斯嘉丽曾明确要求 OpenAI 不要用她的声音制作聊天机器人,而奥特曼随后使用了另一位配音演员,但声音明显与她相似,事情闹大后只能灰溜溜下架。

事实上,在名誉权和著作权上,OpenAI 等大公司只向许多艺术家、作家提供很少的补偿,甚至可能根本没有。演员 Justine Bateman 将其描述为「美国历史上最大的盗窃案」。

与此同时,OpenAI 长期以来一直口头上强调制定人工智能安全措施的价值,但几位与安全相关的关键员工纷纷离职。

联合创始人 Ilya Sutskever 离职,并将他的新公司命名为 Safe Superintelligence,而前 OpenAI 员工 Daniel Kokotajlo 也警告说,有关安全的承诺正在被忽视。

OpenAI 似乎也在堵住员工的嘴,这一现象更加加剧了 OpenAI 对安全的漠视。

今年 5 月,记者 Kelsey Piper 发现了一些文件,允许 OpenAI 从说公司坏话的前员工手中收回既得股票,这种做法令许多业内人士感到震惊。

在 Ted AI Show 播客中表示,「多年来,奥特曼一直让董事会感到很为难……你知道,他隐瞒信息,歪曲了公司正在发生的事情,在某些情况下甚至是公然地歪曲事实并且对董事会撒谎。」

到了 5 月下旬,针对 OpenAI 及其首席执行官的负面新闻不断累积,以至于风险投资家 Matt Turck 在X上发布了一幅漫画,「自上次轻松避免 OpenAI 争议以来的天数:0。」

贪婪之罪

短暂的风暴之后,奥特曼仍然运营着 OpenAI,并且在很大程度上仍然代表人工智能的公众形象。

他基本上按照自己的喜好重组了 OpenAI 的董事会,甚至就在 2024 年 4 月,国土安全部部长 Alejandro Mayorkas 还前往拜访了奥特曼,招募他加入国土安全部的人工智能安全委员会。

奥特曼的选择很可能以持久的方式影响全人类——而不仅仅是个人用户。

此外,由 OpenAI 普及的 GenAI 军备竞赛正在对环境产生巨大的影响,无论是用电量、排放量还是用水量。

正如彭博社最近所说,「人工智能已经对全球电力系统造成了严重破坏。」

随着模型本身变得越来越大,对环境的恶劣影响也会越来越大。各国政府目前遵循奥特曼的说法——人工智能最终会得到回报(到目前为止肯定还没有),证明环境成本是合理的。

与此同时,OpenAI 仍然占据了领导地位,奥特曼是国土安全委员会的成员,应该要以审慎的态度接受他的建议。

奥特曼曾经试图吸引投资者对围绕生成人工智能的基础设施进行 7 万亿美元的投资,这可能会导致资源的巨大浪费。

最后,高估当前的人工智能局势可能会导致战争。

例如,中美围绕出口管制展开的「芯片战争」——美国限制英伟达设计、台积电制造的关键 GPU 芯片的出口,影响中国在人工智能领域的发展能力,并导致两国之间的紧张局势升级。

奥特曼的出发点可能是好的,也许他真的想拯救世界免受人工智能的威胁,并引导人工智能向善。

但奥特曼毕竟是一位企业家,有时也许贪婪占据了上风。

不幸的是,许多其他人工智能公司似乎走在了奥特曼炒作和偷工减料的老路上。

价值数十亿美元的初创公司 Perplexity 似乎是贪婪的另一个教训,它对不应该使用的数据进行训练。

与此同时,微软从倡导「负责任的人工智能」转向匆忙推出存在严重问题的产品,盲目地卷速度迫使谷歌也这样做。

金钱和权力正在腐蚀人工智能,就像它们腐蚀社交媒体一样。

我们根本无法相信大型私营人工智能初创公司能够以道德和透明的方式进行自我管理,如果我们不能相信他们能够管理自己,我们当然就不应该让他们管理世界。

Marcus 尖锐地指出,如果我们继续走当前的道路,他不认为我们会得到一个值得信赖的人工智能。

除了权力和金钱的腐败影响之外,还存在一个深层次的技术问题:大语言模型不太可能是完全安全的。

它们本质上是顽固的、不透明的——所谓的「黑匣子」,但这样的黑匣子从来都不可靠。

讽刺的是,当今人工智能面临的最大威胁可能是人工智能公司本身。

他们的不良行为和夸大的承诺让很多人望而却步,许多人已经准备好让政府采取更强硬的手段。

根据人工智能政策研究所 6 月份的民意调查, 80% 的美国选民选择「对 AI 进行监管,要求采取安全措施对 AI 实验室进行监督,而不是放任他们进行自我监管」。

为了获得值得信任的人工智能,Marcus 长期以来一直在游说跨国合作,专注于人工智能的安全性和可靠性而不是利润,开发一套属于人类的新 AI 技术。

更重要的是,公民需要大声疾呼,要求人工智能有利于大多数人,而不仅仅是少数人。

如果我们把一切都交给硅谷,我们就无法到达人工智能的乐土。

数十年来,科技巨头们一直在掩盖真相,为什么我们要继续信任一个企业家的空头支票呢?