梦晨发自凹非寺

量子位公众号 QbitAI

首款大模型推理专用 ASIC 芯片问世,一上来就要挑战英伟达——

- 一张顶 20 张 H100

- 700 亿参数 Llama 3 吞吐量达到每秒 500000(五十万)tokens

- 比英伟达下一代芯片 GB200 快一个数量级,还更便宜

Sohu 芯片,来自初创公司 Etched,一经推出就引起业界墙裂关注。

作为专用集成电路 ASIC,与通用计算的 GPU 不同,它只支持 Transformer一种算法,无法运行同为神经网络的 CNN、LSTM、以及 Mamba 等状态空间模型。

Etched 公司也刚刚完成1. 2 亿美元A轮融资(约 8.7 亿元人民币),Peter Thiel、GitHub 现任 CEO Thomas Dohmke 等重量级天使投资人参与。公司还透露,已有某客户预定了价值数千万美元的硬件产品。

今天的每个 SOTA 模型都基于 Transformer,ChatGPT、Sora、Gemini、Stable Diffusion 3 等。

假如有一天 Transformer 被 SSM、RWKV 或任何新架构取代,我们的芯片将毫无价值。

但如果我们是对的,Sohu 将改变世界。

对此,Mamba 作者 Tri Dao 也感叹:

这是一场豪赌,不过大模型推理需求正盛,所以可能是正确的入场时机。

有网友一算,人平均每天说 1.8 万个单词,那 Sohu 芯片一秒内就能生成 21 个人一天说的所有话,感觉太虚幻了。

(但实际上每秒 500000tokens 吞吐量包含输入和输出,不是纯生成这么多)

那么 Sohu 能威胁到英伟达的地位么?

考虑到 Sohu 更适合推理而不是训练,对于其他注重 AI 推理的芯片如 Groq 和 SambaNova 更是一种挑战,而不是威胁英伟达。

实在不行,老黄也可以使用钞能力把整个 Etched 买下来嘛(手动狗头)。

把 Transformer 烧录到芯片里

ASIC 全称是应用专用集成电路(Application-Specific Integrated Circuit),相当于把某种特定的程序“硬件化”。并且只为一种任务优化,去掉不必要的功能,以达到比通用芯片更快并且功耗更低的目的。

如比特币后期,矿工们就抛弃了 GPU,使用挖矿专用 ASIC 芯片能带来更多的利润。又或者手机里的视频解码芯片,通常也是一种 ASIC。

具体到 Sohu,就相当于把 Transformer 网络架构“烧录”到芯片里,公司名称 Etched 也是取自“蚀刻”的意思。

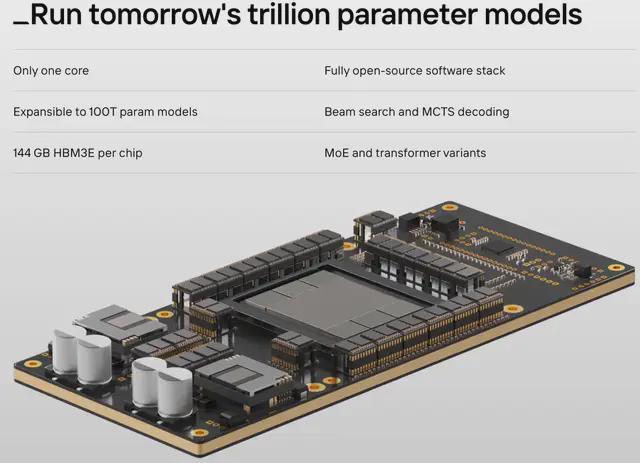

Sohu 由台积电 4nm 工艺制造,只有 1 个核心,每张芯片配有 144GB HBM3E 高带宽内存。

一张芯片最高能支持 100 万亿参数大模型(现在根本还没有这么大的),支持 MoE 架构和各种 Transformer 变体,支持束搜索和蒙特卡洛树搜索解码。

基本上今天主流大模型需要的支持都考虑到了。

在 Etched 自己给出的测试结果中,Sohu 比推理 Llama-3 70B 比 H100 快 20 倍以上,

具体设置如下:

- FP8 精度的 Llama-3 70B,无稀疏性,8 倍模型并行,2048 输入长度/128 输出长度

- 使用 TensorRT-LLM 0.10.08(最新版本)评估 H100 性能,B200 的数字是估计的

Etched 团队表示,H100 有 800 亿个晶体管,却只有 3.3% 用于矩阵乘法,这种大模型推理时最常见的运算。

只支持 Tranformer 的 Sohu 芯片 FLOPS 有效利用率超过 90%(GPU 大约是 30%),无需用低精度量化或稀疏性等降低推理成本,同时也在一定程度上削弱模型能力的方法了。

让 AI 模型快了 20 倍、同时更便宜,能带来哪些改变?

Etched 团队列举了今天 SOTA 模型的几个痛点:

- Gemini 需要 60 秒才能回答与视频有关的问题

- 编程智能体的成本还高于人类软件工程师

- 视频生成模型每秒约生成一帧

同时它们也给出了 3 个应用场景参考:

实时语音客服,几毫秒理解几千字并给出回复。

具体场景是饭店顾客问还需要等多长时间才有座位,AI 查询系统中每桌预定情况数据后,计算出还要等 45 分钟,并引导用户预定位置。

代码场景,使用树搜索算法并行比较几百个方案,选择最好的。

文本生成,也能更好地利用投机解码提高生成的质量和速度。

目前 Sohu 开发者云已开启抢先体验申请,在实际场景中能取得什么样的效果,量子位将持续关注。

两哈佛辍学生创办

Etched 公司成立仅两年,由两位哈佛辍学生Gavin Uberti和Chris Zhu创办。

两人声称在 2022 年就赌 Transformer 将改变世界。领英资料也显示公司创立时间在 2022 年 10 月,比 ChatGPT 问世还早一个月。

Etched 刚刚完成 1.2 亿美元的A轮融资,由 Primary Venture Partners 和 Positive Sum Ventures 共同领投,主要投资人还包括 Peter Thiel、GitHub 首席执行官 Thomas Dohmke、Cruise 联合创始人 Kyle Vogt 和 Quora 联合创始人 Charlie Cheever。

除了这些大咖之外,我们发现也有不少 AI 初创公司创始人投资了 Etched 后激情“晒单”。

投资者中的不少人都认同 Transformer 专用芯片是不可避免的新趋势。

四年间,GPU 并没有变得更好

Etched 提出,GPU 在过去四年间效率并没有变得更好,只是变得更大了:芯片每平方毫米的的 TFLOPS 几乎持平。

事实上老黄本人也在今年 GTC 大会上提出:“我们需要更大的 GPU,如果不能更大,就把更多 GPU 组合在一起,变成更大的虚拟 GPU。”

在 Etched 看来,随着摩尔定律放缓,同时在性能和效率上取得突破的方法只剩下专用化。

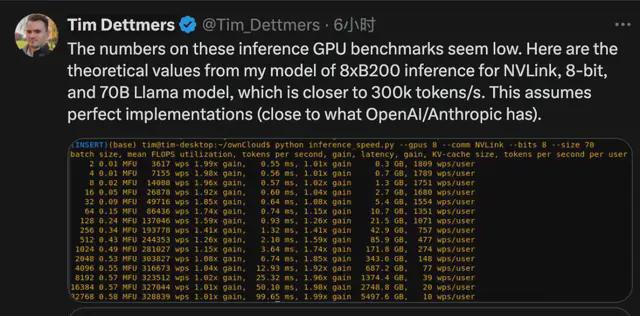

不过对 Etched 和 Sohu 芯片,业界也有人提出质疑。

曾撰写爆火教程“2023 年性价比 GPU 选购指南”的华盛顿大学博士生 Tim Dettmers 指出,Etched 官方的测试数据中 GPU 的性能可能并不是当前 SOTA 方法。

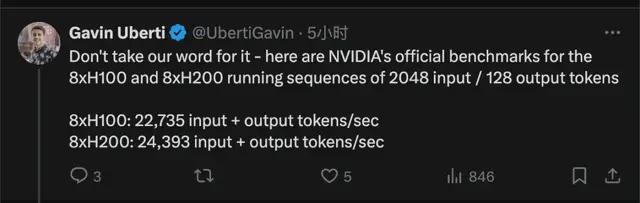

创始人 Uberti 解释 H100 的数据取自英伟达官方测试。

也有人不看好的原因是,Transformer 之后还是会有下一个重大架构突破。

曾有投资人透露,至少有 6 家公司正在秘密开发 Transformer 专用 ASIC 芯片,现在看来 Etched 只是浮出水面的第一家。

你看好 Transformer 专用芯片吗?欢迎在评论区留下你的看法。

参考链接:

[1]https://www.etched.com/announcing-etched