新智元报道

编辑:乔杨好困

【新智元导读】最近,许久没有新动向的马斯克放出了大消息——他旗下的人工智能初创公司 xAI 将投入巨资建造一个超算中心,以保证 Grok 2 及之后版本的训练。这个「超级计算工厂」预计于 2025 年秋季建成,规模将达到目前最大 GPU 集群的四倍。

前段时间,OpenAI、谷歌、微软相继开大会,AI 圈子的竞争如火如荼。

这么热闹的时候,怎么能少得了马斯克。

前段时间忙着特斯拉和星链的他,最近好像开始腾出手,而且不鸣则已、一鸣惊人,直接放出一个大消息——自己要造世界上最大的超算中心。

今年 3 月,他旗下的 xAI 发布了最新版的 Grok 1.5,此后一直有关于 Grok 2 即将面世的传说,但却迟迟没有官方消息。

难道是因为算力不够?

没错,亿万富翁可能也买不到足够的芯片。今年四月他曾亲自下场表示,没有足够多的先进芯片,推迟了 Grok 2 模型的训练和发布。

他表示,训练 Grok 2 需要大约 2 万个基于 Hopper 架构的英伟达 H100 GPU,并补充说 Grok 3 模型及更高版本将需要 10 万个 H100 芯片。

特斯拉第一季度的财报也显示,公司此前一直受到算力的限制,当时马斯克的计划还是年底前部署 8.5 万个 H100 GPU,将 xAI 从红杉资本和其他投资者那里筹集的 60 亿美元中的大部分都花在芯片上。

目前每台 H100 的售价约为 3 万美元,不算建造费用和其他服务器设备,仅仅是芯片就需要花掉 28 亿美元。

根据马斯克的估算,这个芯片储量训练 Grok 2 绰绰有余。

但可能老马思考了一个月之后,觉得这一步迈得还不够大,不够有突破性。毕竟 xAI 的定位是要和 OpenAI、谷歌这种强劲对手正面掰头的,以后想训练模型可不能再因为算力掉链子。

于是,他最近公开表示,xAI 需要部署 10 万个 H100 来训练和运行 Grok 的下一个版本。

而且,xAI 还计划将所有芯片串联成一个巨大的计算机——马斯克称之为「超级计算工厂」(Gigafactory of Compute)。

老马这个月已经向投资者表示,他希望在 2025 年秋季之前让这台超级计算机运行起来,而且他将「个人负责按时交付超级计算机」,因为这对于开发 LLM 至关重要。

这台超算可能由 xAI 与 Oracle 合作共建。这几年来,xAI 已经从 Oracle 租用了带有约 1.6 万个 H100 芯片的服务器,是这些芯片最大的订单来源。

如果不发展自己的算力,未来几年 xAI 在云服务器上很可能就要花费 100 亿美元,算下来居然还是「超级计算工厂」比较省钱。

目前最大 GPU 集群

这个「超级计算工厂」一旦完工,规模将至少是当前最大 GPU 集群的 4 倍。

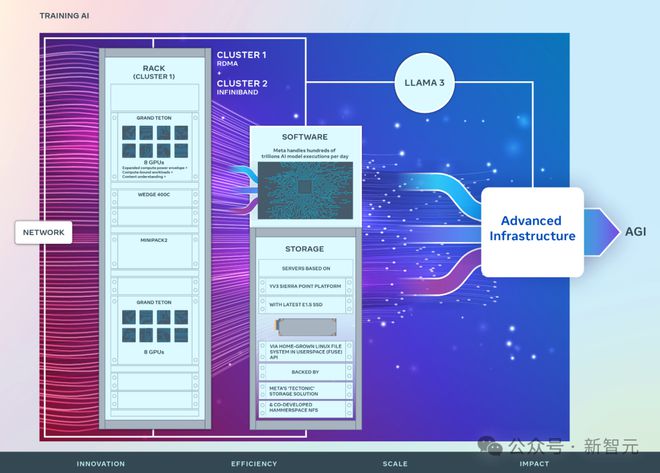

比如 Meta 官网在 3 月发布的数据显示,他们当时推出了 2 个包含 2.4 万个 H100 GPU 的集群用于 Llama 3 的训练。

虽然英伟达已经宣布今年下半年开始生产并交付全新架构 Blackwell 的 B100 GPU,但马斯克目前的计划还是采购 H100。

为什么不用最新型号的芯片,反而要大批量购入快要淘汰的型号?这其中的原因,老黄本人向我们解释过——「在今天的 AI 竞争里,时间很重要」。

英伟达会每一年更新一代产品,而如果你想等我的下一个产品,那么你就丢失了训练的时间和先发优势。 下一个达到里程碑的公司会宣布一个突破性的 AI,而接下来的第二名只在它上面提升 0.3%。你要选择做哪一种? 这就是为什么一直做技术领先的公司很重要,你的客户会在你上面建设并且相信你会一直领先。这里面时间很重要。 这就是为什么我的客户现在依然疯狂的在建设 Hopper 系统。时间就是一切。下一个里程碑马上就来。

然而,即使一切顺利,「超级计算工厂」在马斯克的「个人负责」下按时交付,这个集群到了明年秋天是否仍然有规模优势,也是一个未知数。

扎克伯格今年 1 月曾经在 Instagram 上发帖,称 Meta 到今年底将再部署 35 万个 H100,加上之前的算力总共相当于 60 万个 H100,但他并未提及单个集群的芯片数量。

但这个数字没过半年就几乎翻了一番,5 月初 Llama 3 发布前,有消息称 Meta 已从英伟达额外购买了 50 万块 GPU,总数达到 100 万块,零售价值达 300 亿美元。

同时,微软的目标是到年底拥有 180 万个 GPU,OpenAI 甚至更加激进,希望为最新的 AI 模型使用 1000 万个 GPU。这两家公司也在讨论开发一个价值 1000 亿美元的超级计算机,包含数百万个英伟达 GPU。

这场算力之战,最后谁会胜出呢?

应该是英伟达吧。

而且不仅仅是 H100,英伟达 CFO Colette Kress 曾经提到过一份 Blackwell 旗舰芯片的优先客户名单,包括 OpenAI、亚马逊、谷歌、xAI 等等。

即将投产的 B100,以及英伟达之后将要一年一更的芯片,将会源源不断地进入科技巨头们的超算中心,帮助他们完成算力的升级迭代。

芯片短缺,电也不够

马斯克在谈到特斯拉的算力问题时也补充说,虽然迄今为止芯片短缺是 AI 发展的一大制约因素,但电力供应在未来一两年将至关重要,甚至会取代芯片成为最大的限制因素。

包括新建的这家「超级计算工厂」的选址,最需要考虑的因素也是电力供应。一个拥有 10 万 GPU 的数据中心可能需要 100 兆瓦的专用电力。

要提供这种量级的电力,xAI 总部办公室所在的旧金山湾区显然不是理想的选择。为了降低成本,数据中心往往建在电力更便宜且供应更充足的偏远地区。

例如,微软和 OpenAI 除了计划那个耗资千亿美元的超算,也正在威斯康星州建造大型数据中心,建设成本约为 100 亿美元;亚马逊云服务的数据中心则选址在亚利桑那州。

「超级计算工厂」一个非常可能的选址,是特斯拉总部,德克萨斯州奥斯汀市。

去年特斯拉宣布建造的 Dojo 就部署在了这里。这台超算基于定制芯片,帮助训练 AI 自动驾驶软件,也可以用于向外界提供云服务。

第一台 Dojo 运行在 1 万个 GPU 上,建造成本约为 3 亿美元。马斯克 4 月表示,特斯拉目前共有 3.5 万个 GPU 用于训练自动驾驶系统。

在数据中心进行模型训练是一个极其耗电的过程。据估计,训练 GPT-3 的耗电量为 1287 兆瓦时,大约相当于 130 个美国家庭每年消耗的电量。

注意到 AI 电力问题的 CEO 不止马斯克一人,Sam Altman 本人曾向初创公司 Helion Energy 投资 3.75 亿美元,这家公司旨在利用核聚变提供一种更环保、更低成本的 AI 数据中心运行方式。

马斯克则没有押注在核聚变技术上,他认为,AI 公司很快将开始争夺降压变压器(step down transformer),可以将高压电流转换为电网可用的电力,「从公用电网获得的电力(例如 300 千伏)降至 1 伏以下是一个巨大的下降」。

芯片之后,AI 行业需要「transformers for Transformers」。

参考资料:

https://finance.yahoo.com/news/jensen-huang-elon-musk-openai-182851783.html?guccounter=1