摘要

让更便宜的大模型,成为全社会创新加速的基础设施。

5 月 21 日,武汉光谷万豪,阿里云「AI 智领者峰会」。

抵达现场后,与会嘉宾发现一丝不同寻常,一个已经在一个月时间里相继在杭州、北京、西安举办过的系列峰会,这次阿里云智能集团资深副总裁、公共云事业部总裁刘伟光亲自来了——阿里云这次,可能要搞个大的。

果不其然,发布会开始十多分钟,刘伟光便聊起了一个硬件领域老生常谈的话题「摩尔定律」。

极客最高级的致敬是「show me code」;商业教父最高级的致敬,是把他的观点,变成行业定律,摩尔定律就是其一。

1965 年,这位英特尔联合创始人的一句话,「单位面积上,晶体管的密度,每隔 18 个月就翻一番」,主导了迄今半导体行业 60 多年的发展。

然而,伴随摩尔故去,摩尔定律在微观晶体管领域,也逐渐褪色。冯诺依曼架构的原始限制、量子隧穿成为摆在眼前的拦路虎。

那将观察角度转为宏观,或者转为用户导向呢?这是阿里云思考了很多年的问题。

从用户角度出发,晶体管密度只是其次,摩尔定律最根本的意义是在于每过 18 个月,用户就能以相同价格买到翻倍的算力。

但很显然,实现越来越便宜的算力,不止有晶体管密度这一条路。

而公共云与 AI,或许就是阿里云超越摩尔定律的尝试。

01 AI 推理成本,开始指数级下降

「我觉得 AI 推理成本只有每年有十倍甚至百倍的降低,才能真正推动行业各行各业的 AI 应用的爆发。」

刘伟光话一出口,台下的人面面相觑:目前中国 80% 的科技企业,一半大模型公司都跑在阿里云之上。每年百倍,也就意味着,阿里云要一步将国产大模型的使用成本打到地板价。

紧随其后,阿里云官宣,旗下 9 款核心商业化及开源系列模型将全数降价,且都已经可以通过阿里云百炼官网开通使用。其中,阿里云对标 GPT-4 级别的长文本模型 Qwen-Long,降价至 GPT-4 价格的 1/400,全球最低。

Qwen-Long 是通义千问的长文本增强版模型,主要适用最消耗 token 的长文本场景,上下文长度最高达 1 千万,可处理约 1500 万字或 1.5 万页的文档。

此次官宣后,其 API 输入价格从 0.02 元/千 tokens 降至 0.0005 元/千 tokens,直降 97%。这意味着,1 块钱可以买 200 万 tokens,相当于 5 本《新华字典》的文字量。相比之下,国内外厂商 GPT-4、Gemini1.5 Pro、Claude 3 Sonnet 及 Ernie-4.0 每千 tokens 输入价格分别为 0.22 元、0.025 元、0.022 元及 0.12 元,均远高于 Qwen-long。同时,Qwen-Long 输出价格也从 0.02 元/千 tokens 降至 0.002 元/千 tokens,降幅 90%。

不久前发布的通义千问旗舰款大模型,权威基准 OpenCompass 上性能追平 GPT-4-Turbo 的 Qwen-Max,同样参与此次降价,API 输入价格降至 0.04 元/千 tokens,降幅达 67%。

其他开源模型上,Qwen1.5-72B、Qwen1.5-110B 等 5 款开源模型的输入价格也分别直降 75% 以上。

从应用范围最广,到性能最佳,阿里云拿出的,都是最重磅的产品,决心可见一斑。

02 阿里云的决心:成为大模型爆发的基础设施

为什么降价?

答案就写在这次活动的主题中:「让天下没有难做的 AI 应用」,成为大模型时代的基础设施。

据多位内部人士表示,AI 的定位在阿里云已经上升到前所未有的战略高度。在多次内部会上,阿里云高管都将 2024 的 AI 类比 2017 年的短视频与 2012 年的移动支付。2012 年到 2013 年,3G 过渡到 4G 过程当中,中国的移动支付两年增长了 800%;在 2017 到 2018,多家短视频的爆发,实现了整个中国短视频呈现 8.5 倍的增长。

未来 AI 的爆发速度,也将远远超出所有人的想象——现在,中国所有大模型公司 API 的日调用量不超过一个亿,年底这一数据量将达 100 亿次,增长百倍。

为达成「AI 基础设施」这一目标,阿里云给自身的定位是做到四有:

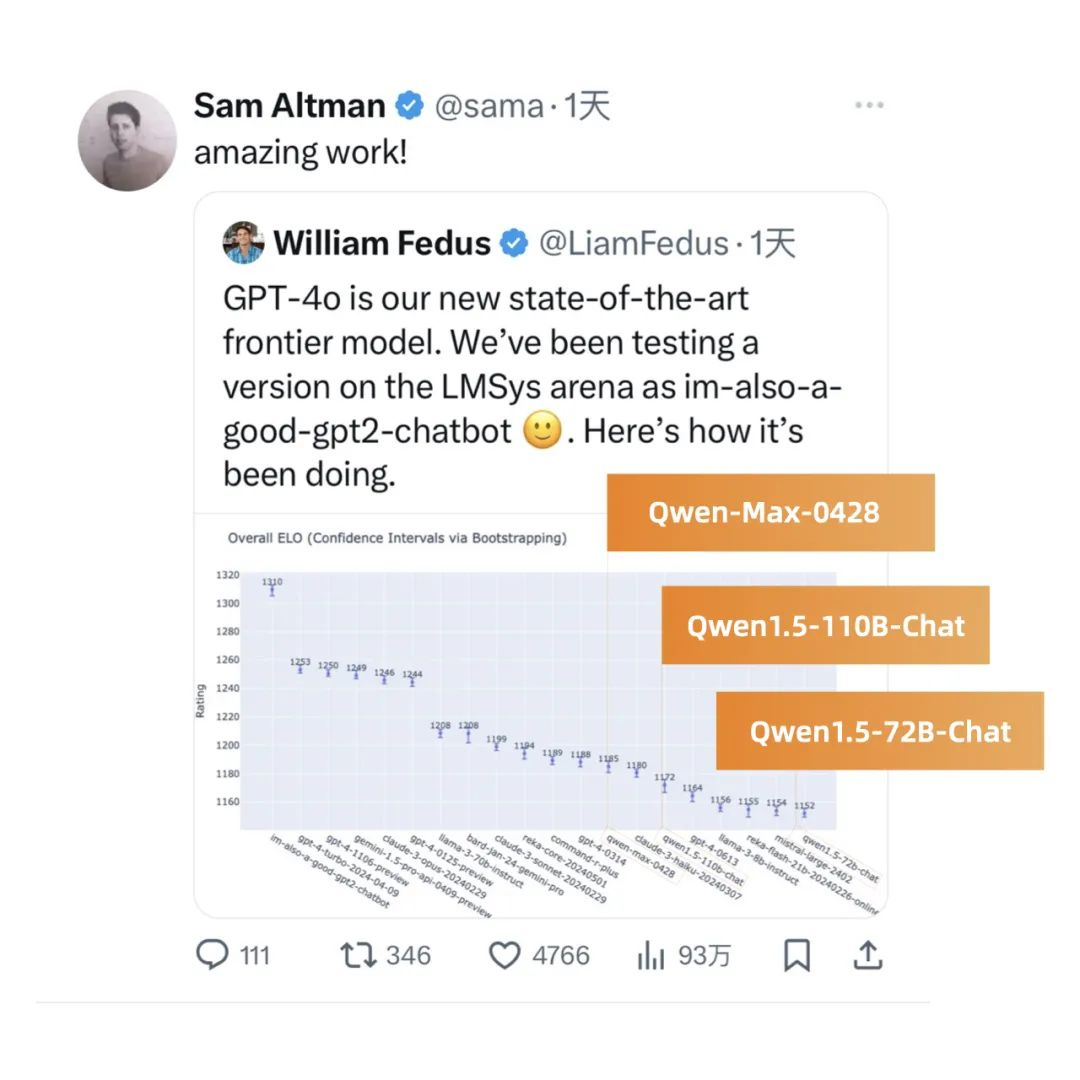

一有,有实力提供全球领先的模型服务。不久前,OpenAI 的 Sam Altman 转发了 Chatbot Arena 榜单来印证 GPT-4o 的能力,其中全球排名前 20 的模型中,三款通义千问代表中国模型实力跻身世界前列。

Sam Altman 在 X 上转发 GPT-4o 测试成绩|X

二有,有能力建设国内最大的推理集群。全球三十处公共云地域分布、共计 89 个可用区,可做到 4X 推理吞吐提升,8X 计算资源节省,以及分钟级快速动态扩容。

三有,有态度坚持开放、持续开源。作为首个提出 MaaS(模型即服务)理念的云厂商,目前,瞄着让模型更好的服务的目标,阿里云百炼模型服务平台已可以调用众多三方及垂直领域大模型、魔塔社区则是中国最大的模型社区,拥有 4500+ 模型总数以及 500 万+用户数;通义持续开源全模态全尺寸模型家族,共计 700 万开源模型下载量。

四有,有信心,迎接 AI 应用的爆发。财报数据显示,同比去年,阿里云的 AI 相关收入同比三位数增长。

而与阿里云的「四有」,形成对比的,则是行业内的「两贵」。

一方面是开发以及微调的人力成本贵。大模型人才稀缺已是业内共识,某家消费电子巨头曾算了一笔账,大模型研发方向,公司平均平均税后人才成本为 100 万元。而对普通企业来说,即便跳过基模这一步,采用开源大模型微调,成本同样高企。

另一方面则是硬件成本「硅谷卡贵」。一个创业公司,拥抱大模型,起步价实买 50 台 GPU 服务器,甚至 100 台、200 台乃至更大尺寸的集群。如果对标全球顶级水平,训练一个 100B 规模的 LLM,以 Falcon 系列模型为例,其资源消耗量 3.5 万亿 token,约 4096 个 A100 组成的集群,训练时长约 70 天。其中,一张 A100 的价格,通常在一万美金乃至更多。而构建集群,除了 GPU 的采购,还有包括软件部署、网络费用、电费、运维成本,以及不断投入的试错成本,成本远非普通企业可以承受。

那么,对阿里云来说,接下来的核心目标,就是如何用阿里云的「四有」,解决 AI 爆发遇到的「两贵」。

03 决定 API 价值的要素:技术高度+普惠能力

不难发现,本次活动,阿里云的重点有二,其一是强调 API 价值,其二是降价普惠的能力。

API 很好理解,互联网发展没必要重复造轮子,大模型发展,也不是人人都需要从基模开始。通过 API 与公共云相组合,不仅可以降低大模型开发的人力成本,更是通往大模型普惠的必经之路。

一方面,云厂商天然的开放性,能为开发者提供私有部署所不具备的丰富模型和工具链。阿里云百炼平台上汇聚通义、百川、ChatGLM、Llama 系列等上百款国内外优质模型,内置大模型定制与应用开发工具链,开发者可以便捷地测试比较不同模型,开发专属大模型,并轻松搭建 RAG 等应用。从选模型、调模型、搭应用到对外服务,一站式搞定。

另一方面,云上更方便进行多模型调用,并提供企业级的数据安全保障。阿里云可以为每个企业提供专属 VPC 环境,做到计算隔离、存储隔离、网络隔离、数据加密,充分保障数据安全。目前,阿里云已主导或深度参与 10 多项大模型安全相关国际国内技术标准的制定。

降价背后的逻辑,则是具备普惠的能力。

在 PC 时代,主导行业不断发展的是安迪-比尔定律。其中,安迪代表的是英特尔卖 CPU 的,比尔则是微软,做 Windows 操作系统的。两者组合,随着操作系统为代表的软件的体量日益庞大,用户必须定期更新迭代新的硬件。

换到 AI 时代同理,大模型发展越好,云计算等算力的需求越高。「生成式 AI 所依赖的算力不仅仅是 CPU 和简单的技术带来的策略,更多是一个大规模集群,大规模 GPU 集群带来算力的基础,包括网络存储背后能力的提升。所以生成式 AI,无论是推理和训练,逐渐更多的走向云端,再一次的点燃了公共云的爆发」刘伟光直言。

而这次空前降价的底气,则是云计算本身超越摩尔定律的特性。

过去,摩尔定律主导单位面积下,芯片晶体管的密度 18 个月翻番。相同算力,用户的使用成本 18 个月降一半。

现如今,晶体管的摩尔定律失效,但公共云的技术红利和规模效应,依然能带来算力成本的继续优化。一个例证是,阿里云过去十年,算力成本降低 80%,存储成本降低 90%。

具体到 AI 方向,阿里云基于自研的异构芯片互联、高性能网络 HPN7.0、高性能存储 CPFS、人工智能平台 PAI 等核心技术和产品,构建了极致弹性的 AI 算力调度系统,结合百炼分布式推理加速引擎,大幅压缩了模型推理成本,并加快模型推理速度。

也是因此,即便同样的开源模型,在公共云上的调用价格也远远低于私有化部署。以使用 Qwen-72B 开源模型、每月 1 亿 tokens 用量为例,在阿里云百炼上直接调用 API 每月仅需 600 元,私有化部署的成本平均每月超 1 万元。

至此,大模型的爆发才刚刚开始,但如何打好这场持久战,阿里云的基础设施的铺垫,已然悄然酝酿完成。

阿里云开启的连锁反应

事实上,阿里云开始幅度如此激进的降价,不会是故事的结尾。

就在今天,上午阿里云大模型大幅降价后,下午随即百度两款轻量型主力大模型宣布免费。虽然这和阿里云降价的模型能力并不完全匹配,看起来是一种声势上的快速应对,但毫无疑问,阿里云开启的这一波大模型能力普惠将引发进一步的业界连锁反应。

对于应用创新,大模型 API 成本的下降,甚至开始可以接近免费试用,真正跑起来再算钱,对激发应用创新是一件好事。过去,中国在实体经济,有基建狂魔称号,「要致富先修路」也成为家喻户晓的常识。其背后的底层经济规律是,基础设施的价格与社会的创新总量,之间是一个微妙的跷跷板结构:

只有基础设施的价格下降,创新才会如成熟的蒲公英,借助风口,把种子播撒向远方。过去实体经济如此,期待 AI 时代亦如此。

*头图来源:视觉中国

本文为极客公园原创文章,转载请联系极客君微信 geekparkGO