明敏发自凹非寺

量子位公众号 QbitAI

猛然间,大模型圈掀起一股“降价风潮”。

前脚,智谱、DeepSeek 等大模型厂商将 API 价格一降再降,输入 100 万 tokens 仅需 1 元。

紧接着,GPU 租赁的价格也被打了下来。

现在潞晨云官方进行限时大额算力补贴,NVIDIA H800 的租用价格,低至 6. 99 元/卡/时;NVIDIA A800 为 5. 99 元/卡/时,4090 甚至低至 1. 39 元/卡/时。

不只有租赁服务,平台上还支持快速简易部署 Llama 3 微调、训练、推理。

其中在 64 卡 H100 集群上,经过 Colossal-AI 优化,相比微软+英伟达方案,可提升 LLaMA3 70B 的训练性能近 20%,推理性能也优于 vLLM 等方案。

Open-Sora 也能玩转。

如上最新动向来自潞晨云(https://cloud.luchentech.com)。

他们不仅将个人开发者、中小企业用户玩转大模型的成本大幅降低,而且上手门槛也不高。

具体来看实操演示~

部署 Llama 3 微调训练推理

潞晨云提供一键部署功能,只需简单操作即可快速启动计算环境。

在最开始时需要先创建云主机。比如对 Llama3 微调训练,可在 8 卡 H800 上完成,在算力市场中选择即可。

此处选择 Colossal-llama3 训练微调镜像,单击创建按钮,创建云主机。

确认当前路径名,并修改 config 文件,输入教程中的 Llama3 训练脚本,本脚本已预置已处理数据集为例进行微调。

首先编译安装 Colossal-AI,其次创建训练需要的文件夹,接着修改 hostfile,在镜像中安装 IP address 指令,查看镜像内 IP 地址。输入 IP address 指令将机内 IP 地址复制并更新到 hostfile 中,就完成了 Llama3 微调的全部流程。

如果是对 Llama 3 推理,可在云主机上选择单张 H800 作为算力资源。

Colossal-Inference 现已适配支持了 LLaMA-3 推理加速。

模型权重已准备好,无需额外安装。然后运行生成脚本:

PRETRAINED_MODEL_PATH="/root/notebook/common_data/Meta-Llama-3-8B" # huggingface or local model pathcd ColossalAI/examples/inference/colossalai run --nproc_per_node 1 llama_generation.py -m PRETRAINED_MODEL_PATH --max_length 80

进行多卡 TP 推理、如下例使用两卡生成:

colossalai run --nproc_per_node 2 llama_generation.py -m PRETRAINED_MODEL_PATH --max_length 80 --tp_size 2

运行吞吐 Benchmark 测试:

PRETRAINED_MODEL_PATH="/root/notebook/common_data/Meta-Llama-3-8B"git pull # update example benchmark from branch feature/colossal-infercd ColossalAI/examples/inference/python benchmark_llama3.py -m llama3-8b -b 32 -s 128 -o 256 -p PRETRAINED_MODEL_PATH

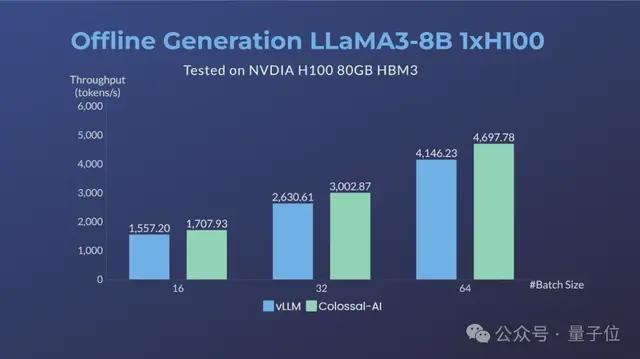

单卡 H100 对 LLaMA3-8B 进行 Benchmark 结果与 vLLM 对比(例:输入序列长度 128,输出长度 256)。

而且支持常用的计算环境配置保存为私有镜像,随时调用,减少重复配置的时间,并保证环境的一致性和稳定性。

部署 Open-Sora 推理

除了大火的语言模型外,潞晨云也支持视频生成模型部署。

前段时间,潞晨开源全球首个类 Sora 架构视频生成模型「Open-Sora 1.0」。

现在在潞晨云上即可部署 Open-Sora 推理。

Open-Sora 推理可以在单卡 H800 上完成,可在算力市场中选择 1 卡 H800。

潞晨云 Open-Sora 镜像中内置了运行环境,同时预置了 Open-Sora 权重,支持开箱即用。

速来薅羊毛

值得一提的是,潞晨云是按秒计费模式,有效降低了不必要的成本支出,特别适合短期或动态计算任务。

除了复杂机器学习模型训练、海量数据分析外,还支持高性能图形渲染,能为广泛应用场景提供强大的计算支持和优化方案。

用户在此还能利用市场波动实现成本优化,通过算力市场提供潮汐定价机制,用户可根据需求和预算选择不同的算力资源,

最近他们正在搞特别活动,提供百万补贴并定期发放代金券。

用户在社交媒体和专业论坛(如知乎、小红书、微博、CSDN 等)上分享使用体验,有效分享一次可得 100 元代金券。每月最佳分享可额外再获 500 元代金券。

在平台分享 AI 应用镜像等,可根据后续平台用户的调用时长,获得现金奖励。同时还在社群中不定时发放特价资源、代金券等优惠活动。

感兴趣的童鞋,戳下方链接即可了解更多详情!