黄健成投稿

量子位公众号 QbitAI

针对图像编辑中的扩散模型,中科院联合 Adobe 和苹果公司的研究人员发布了一篇重磅综述。

全文长达 26 页,共 1.5 万余词,涵盖 297 篇文献,全面研究了图像编辑的各种前沿方法。

同时,作者还提出了全新的 benchmark,为研究者提供了便捷的学习参考工具。

在这份综述中,作者从理论和实践层面,详尽总结了使用扩散模型进行图像编辑的现有方法。

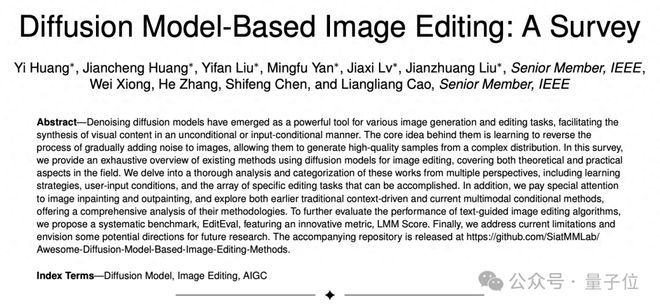

作者从学习策略、输入条件等多个角度对相关成果进行分类,并展开了深入分析。

为了进一步评估模型性能,作者还提出了一个测评基准,并展望了未来研究的一些潜在方向。

△基于扩散模型的图像编辑成果速览

下面,作者将从任务分类、实现方式、测试基准和未来展望四个方面介绍基于扩散模型的图像编辑成果。

图像编辑的分类

除了在图像生成、恢复和增强方面取得的重大进步外,扩散模型在图像编辑方面也实现了显著突破,相比之前占主导地位的生成对抗网络(GANs),前者具有更强的可控性。

不同于“从零开始”的图像生成,以及旨在修复模糊图像、提高质量的图像恢复和增强,图像编辑涉及对现有图像外观、结构或内容的修改,包括添加对象、替换背景和改变纹理等任务。

在这项调查中,作者根据学习策略将图像编辑论文分为三个主要组别:基于训练的方法、测试时微调方法和无需训练和微调的方法。

此外,作者还探讨了控制编辑过程使用的 10 种输入条件,包括文本、掩码、参考图像、类别、布局、姿势、草图、分割图、音频和拖动点。

进一步地,作者调查了这些方法可以完成的 12 种最常见的编辑类型,它们被组织成以下三个广泛的类别:

- 语义编辑:此类别包括对图像内容和叙述的更改,影响所描绘场景的故事、背景或主题元素。这一类别内的任务包括对象添加、对象移除、对象替换、背景更改和情感表达修改。

- 风格编辑:此类别侧重于增强或转换图像的视觉风格和审美元素,而不改变其叙述内容。这一类别内的任务包括颜色更改、纹理更改和整体风格更改,涵盖艺术性和现实性风格。

- 结构编辑:此类别涉及图像内元素的空间布局、定位、视角和特征的变化,强调场景内对象的组织和展示。这一类别内的任务包括对象移动、对象大小和形状更改、对象动作和姿势更改以及视角/视点更改。

图像编辑的实现方式

基于训练的方法

在基于扩散模型的图像编辑领域,基于训练的方法已经获得了显著的突出地位。

这些方法不仅因其稳定的扩散模型训练和有效的数据分布建模而著名,而且在各种编辑任务中表现可靠。

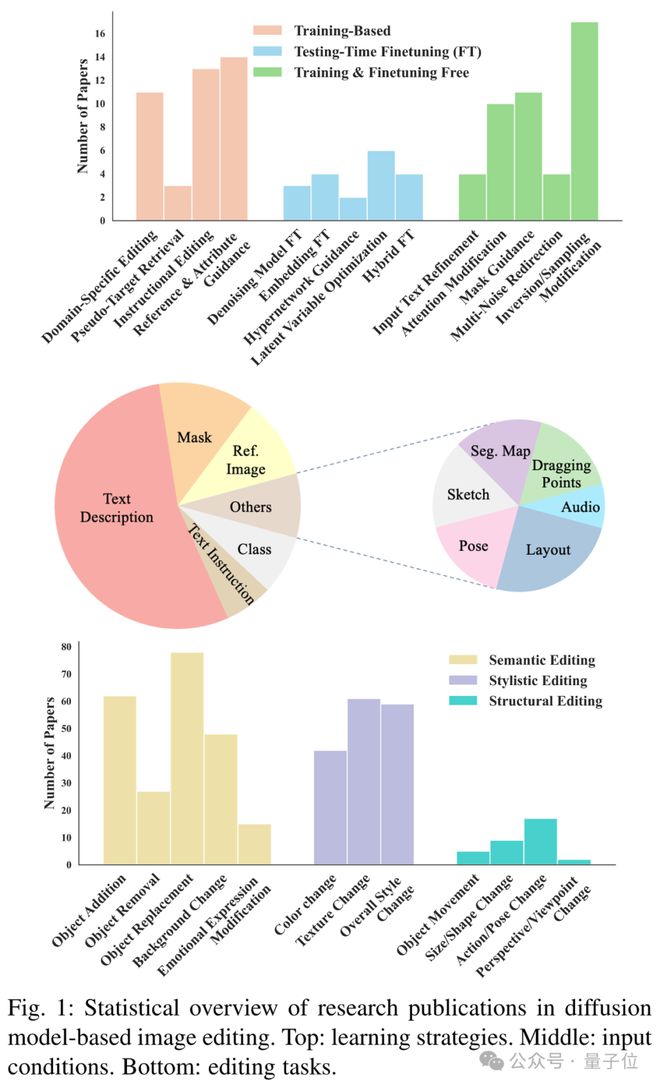

为了彻底分析这些方法,作者根据它们的应用范围、训练所需条件和监督类型将它们分类为四个主要组别。

根据核心编辑方法,这些主要组别中的方法又可以细分为不同的类型。

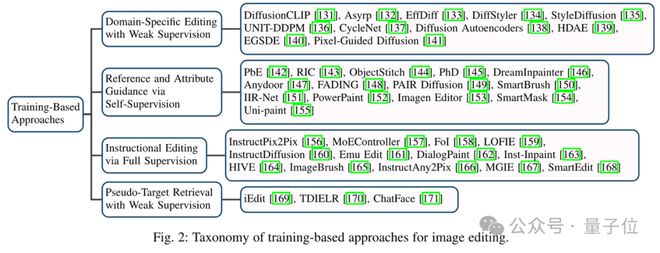

下图展示了两种有代表性的 CLIP 指导方法——DiffusionCLIP 和 Asyrp 的框架图。

△样本图像来自 CelebA 数据集上的 Asyrp

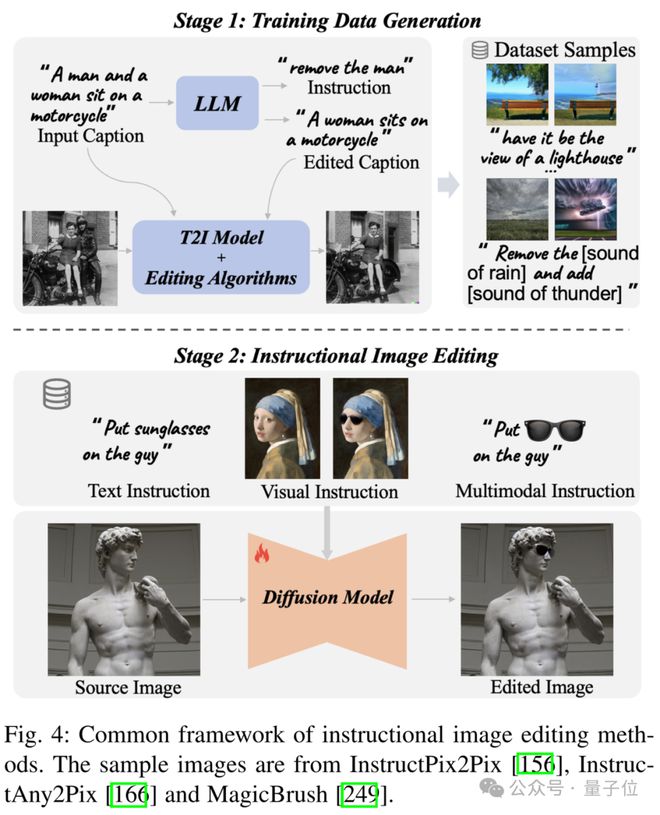

下面的图片,展示的是指令图像编辑方法的通用框架。

△示例图像来自 InstructPix2Pix、InstructAny2Pix 和 MagicBrush

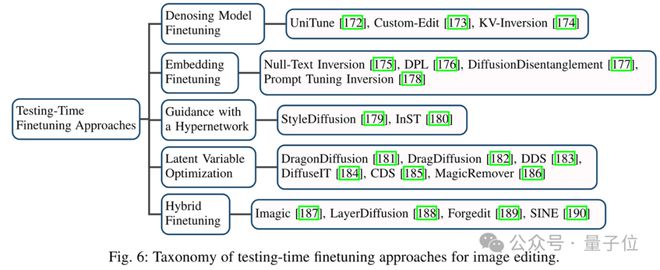

测试时微调的方法

在图像生成和编辑中,还会采用微调策略来增强图像编辑能力,测试时微调带来了精确性和可控制性的重要提升。

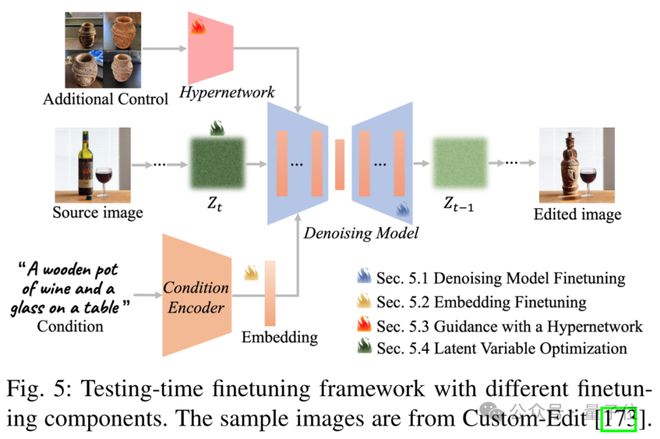

如下图所示,微调方法的既包括微调整个去噪模型,也包括专注于特定层或嵌入。

此外,作者还讨论了超网络的集成和直接图像表示优化

下图展示了使用不同微调组件的微调框架。

△样本图像来自 Custom-Edit

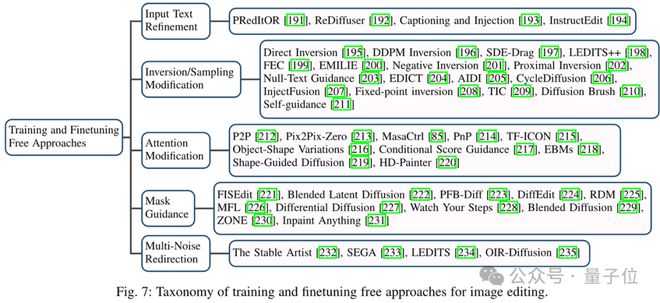

免训练和微调方法

在图像编辑领域,无需训练和微调的方法起点是它们快速且成本低,因为在整个编辑过程中不需要任何形式的训练(在数据集上)或微调(在源图像上)。

根据它们修改的内容,可以分为五个类别,这些方法巧妙地利用扩散模型内在的原则来实现编辑目标。

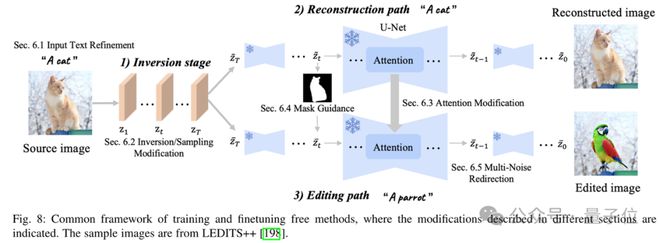

下图是免训练方法的通用框架。

△样本图片来自 LEDITS++

图像 inpainting(补全)和 outpainting(外扩)

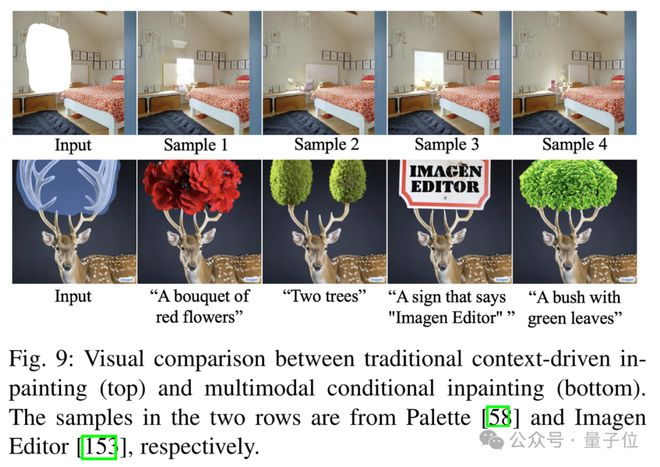

图像补全和外扩通常被视为图像编辑的子任务,可以分为两大类型——上下文驱动的补全(上排)与多模态条件补全(下排)。

△样本分别来自于 Palette 和 Imagen Editor

全新测试基准

除了分析各种方法的实现原理,评估这些方法在不同编辑任务中的能力也至关重要,但现有的图像编辑测试标准存在局限。

例如,EditBench 主要针对文本和掩码引导的补全,但忽略了涉及全局编辑的任务(如风格转换);TedBench 虽然扩展了任务范围,但缺乏详细指导;EditVal 试图提供更全面的任务和方法覆盖范围,但图像通常分辨率低且模糊……

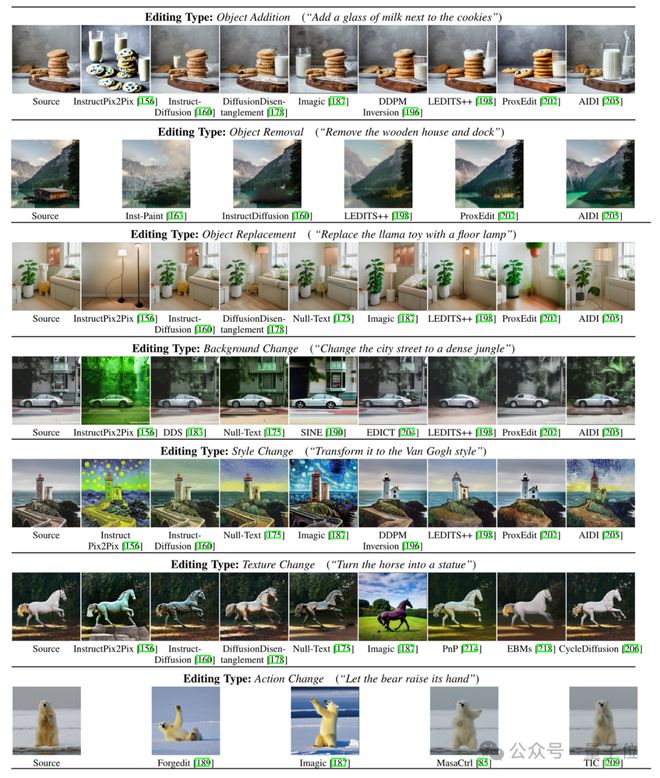

为了解决这些问题,作者提出了EditEval基准,包括一个 50 张高质量图像的数据集,且每张图像都附有文本提示,可以评估模型在 7 个常见编辑任务的性能。

这 7 种任务包括物体添加/移除/替换,以及背景、风格和姿势、动作的改变。

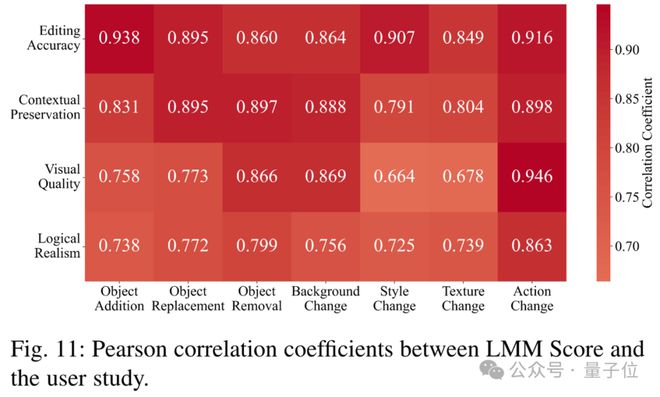

此外,作者还提出了 LMM 分数,利用多模态大模型(LMMs)评估不同任务上的编辑性能,并进行了真人用户研究以纳入主观评估。

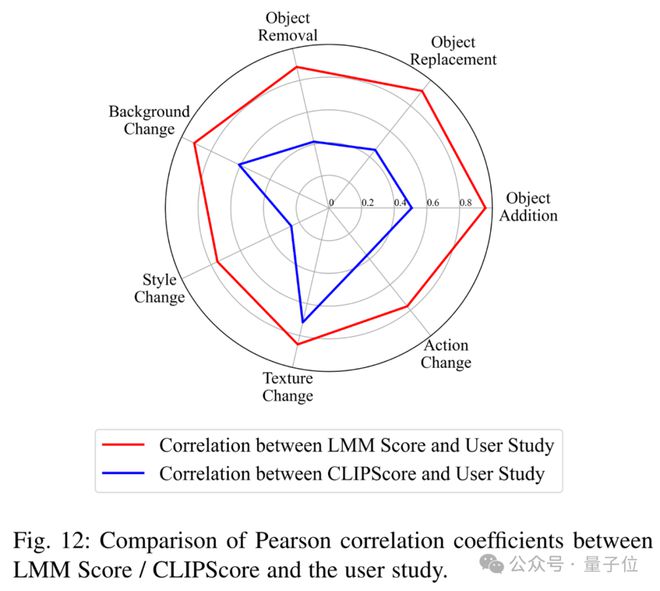

△LMM Score 与用户研究的皮尔逊相关系数

下图比较了 LMM Score/CLIPScore 与用户研究的皮尔逊相关系数。

挑战和未来方向

作者认为,尽管在使用扩散模型进行图像编辑方面取得了成功,但仍有一些不足需要在未来的工作中加以解决。

减少模型推理步骤

大多数基于扩散的模型在推理过程中需要大量的步骤来获取最终图像,这既耗时又耗费计算资源,给模型部署和用户体验带来挑战。

为了提高推理效率,已经由团队研究了少步骤或一步生成的扩散模型。

近期的方法通过从预训练的强扩散模型中提取知识来减少步骤数,以便少步骤模型能够模仿强模型的行为。

一个更具挑战性的方向是直接开发少步骤模型,而不依赖于预训练的模型(例如一致性模型)。

提高模型效率

训练一个能够生成逼真结果的扩散模型在计算上是密集的,需要大量的高质量数据。

这种复杂性使得开发用于图像编辑的扩散模型非常具有挑战性。

为了降低训练成本,近期的工作设计了更高效的网络架构作为扩散模型的骨干。

此外,另一个重要方向是只训练部分参数,或者冻结原始参数并在预训练的扩散模型之上添加一些新层。

复杂对象结构编辑

现有的工作可以在编辑图像时合成逼真的颜色、风格或纹理,但处理复杂结构时仍然会产生明显的修改痕迹,例如手指、标志和文字。

研究者已经在尝试解决这些问题,常用的策略是把“六个手指”等常见问题作为负面提示,以使模型避免生成此类图像,这在某些情况下是有效的,但不够稳健。

近期的工作中,已有团队开始使用布局、边缘或密集标签作为指导,编辑图像的全局或局部结构。

复杂的光照和阴影编辑

编辑对象的光照或阴影仍然是一个挑战,因为这需要准确估计场景中的光照条件。

以前的工作(如 Total Relighting)使用网络组合来估计前景对象的法线、反照率和阴影,以获得逼真的重新照明效果。

最近,也由有团队提出将扩散模型用于编辑面部的光照,ShadowDiffusion 也探索了基于扩散模型的阴影合成,可以生成合理的对象阴影。

然而,使用扩散模型在不同背景条件下准确编辑对象的阴影仍然是一个未解决的问题。

图像编辑模型的泛化性

现有基于扩散的图像编辑模型能够为给定的一部分条件合成逼真的视觉内容,但在许多现实世界场景中仍然会失败。

这个问题的根本原因在于,模型无法准确地对所有可能的样本在条件分布空间中进行建模。

如何改进模型以始终生成无瑕疵的内容仍然是一个挑战,解决这个问题有以下几种思路:

首先是扩大训练数据规模,以覆盖具有挑战性的场景,这种方式效果显著,但成本较高,如在医学图像、视觉检测等领域数据难以收集。

第二种方法是调整模型以接受更多条件,如结构引导、3D 感知引导和文本引导,以实现更可控和确定性的内容创作。

此外,还可以采用迭代细化或多阶段训练的方式,以逐步改进模型的初始结果。

可靠的评估指标

对图像编辑进行准确评估,对于确保编辑内容与给定条件的对齐至关重要。

尽管有如 FID、KID、LPIPS、CLIP 得分、PSNR 和 SSIM 等定量指标,但大多数现有评估工作仍然严重依赖于用户研究,这既不高效也不可扩展。

可靠的定量评估指标仍然是一个待解决的问题。最近,已经有团队提出了更准确的指标来量化对象的感知相似性。

DreamSim 测量了两幅图像的中等级别相似性,考虑了布局、姿态和语义内容,并且优于 LPIPS。

类似的,前景特征平均(FFA)也是一种简单而有效的方法,可被用于测量对象的相似性。

另外,作者在本文中提出了的 LMM score,也是一种有效的图像编辑度量。

更多有关用于图像编辑的扩散模型的详细信息,可以阅读原作,同时作者也在 GitHub 上发布了附带资源库。

论文链接:

https://arxiv.org/abs/2402.17525

Github:

https://github.com/SiatMMLab/Awesome-Diffusion-Model-Based-Image-Editing-Methods