新智元报道

编辑:peter 东

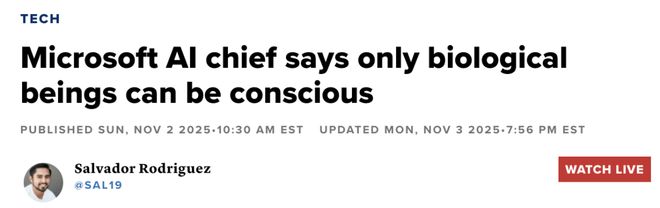

微软 AI 负责人 Mustafa Suleyman 表示,只有生物体才能具备意识,开发者和研究人员应该停止追求让 AI 具有意识。

让 AI 具有意识是个伪命题!

如果你问错问题,你就会得到错误的答案。

如何让 AI 具备意识,这就是一个错误的问题,因为 AI 根本就不可能具备意识。而当前很多 AI 陪伴产品,其 ppt 是宣称要在未来让 ai 具有意识。

微软人工智能领域的顶级高管 Mustafa Suleyman,撰写了《浪潮将至》,曾多次反对这样的观点。

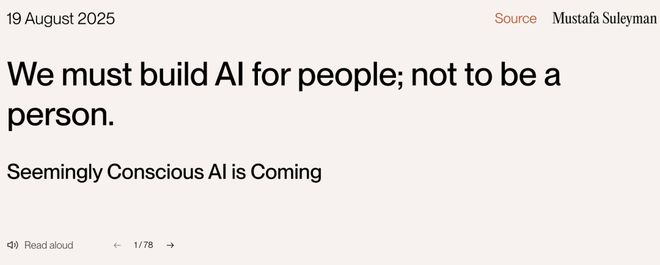

他今年 8 月的博客文章,标题是「我们必须为人构建 AI,而不是成为一个人」。

在休斯顿的 AfroTech 会议上接受 CNBC 采访时,他说:「我认为人们不应该做以构建有意识的 AI 为目标的工作」。

Suleyman 强调:区分人工智能变得更聪明和更有能力,与它是否能够拥有人类情感甚至意识是两个不同的问题,这两者的区别尤其重要。

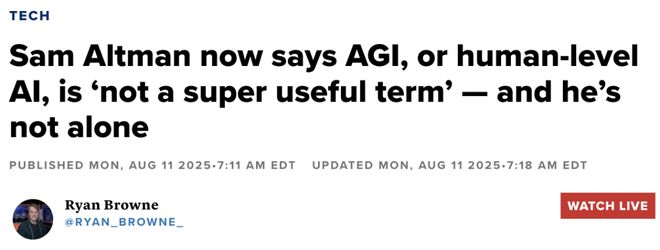

这一观点与奥特曼不谋而合。

在 8 月份接受 CNBC 的《Squawk Box》节目采访时,他表示,通用人工智能不是一个很有用的描述,真正发生的是模型正在快速进步,我们将越来越依赖它们「做更多的事」。

这意味着不必等到实现了 AGI,先让 AI 有了意识,我们当下依旧能让 AI 变得更有用。

意识依赖于生物脑的生化过程

如今已有越来越多的证据,支持生物自然主义。

根据生物自然主义,我们的身体疼痛体验让我们非常悲伤,感觉非常糟糕,但人工智能在经历‘疼痛’时并不感到悲伤。

实际上,机器只是在创造感知,似是而非的经验和自我,以及模拟意识存在.

但这并不是它实际经历的事情。从技术上讲,你知道这一点,因为我们可以看到模型正在做什么。

我们今天赋予人们权利,是因为我们不想伤害他们,因为他们会遭受痛苦。他们有避免痛苦的偏好。

然而,大模型没有这些。它们只是模拟。

如果一些人开始尝试开发有意识的 AI,并且这些 AI 说服其他人它们可以感到痛苦,或者它们有不被关闭的权利。

那由于意识按定义是无法触及的,属于个人体验。那么总有一天,这些人会发展到争论法律该不该赋予 AI 伴侣的「人权」。

在一个已经因为身份和权利问题而争论激烈的世界里,这将为支持者和反对 AI 权利的人之间增加一个混乱之源。

它使人们与现实脱节,磨损脆弱的社会纽带,占据了宝贵的注意力资源。

然而,这样的讨论完全缺少科学依据。

这就是为何 Suleyman 坚决反对讨论 AI 意识的原因。还是让我们将所有精力集中在保护地球上人类、动物和自然环境的福祉和权利上吧。

不拥有意识也可以做好 AI 产品

随着 AI 伴侣产品的竞争,各家都想让自己的产品具有个性,以此留住用户。

对此 Suleyman 在巡回演讲及博客文章中分享了他对微软产品的看法。

例如,微软宣布为其 Copilot AI 服务推出新功能,包括名为 Mico 的 AI 伴侣以及与他人进行群聊中与 Copilot 互动的能力。

Suleyman 表示,微软正在构建意识到自己是 AI 的服务。

之所以要让 AI 意识到自己是 AI,是因为微软要创建始终服务于人类的 AI,而不是模仿人类的 AI。

Suleyman 还介绍了微软近期推出的一项名为「真实对话」的功能。

这是一种 Copilot 的对话风格,旨在挑战用户的观点,而不是一味奉承。这样的对话下,AI 会给用户辛辣的批评。

人工智能本身充满了矛盾。

AI 不拥有意识,也一样可以有自己的价值观和性格。

AI 伴侣可以在某些方面令人失望,同时却又完全神奇,Suleyman 在采访中指出

如果你不感到害怕,那就说明你对 AI 真的不懂。你应该感到害怕。

恐惧是健康的。怀疑是必要的。

我们不需要无节制的加速主义。

参考资料: