“墨镜、手杖、导盲犬是视障人士出行的三件套,这是他们的助手,也是他们的标志。通过创新的智能软硬件,逐渐去除这些标志,让视障人士从外观到行为都能像正常人一样生活,是我们的终极目标。”上海交通大学计算机学院清源研究院长聘教轨副教授、博士生导师顾磊磊日前在接受澎湃科技记者采访时表示。

4 月 14 日,国际学术期刊《自然-机器智能》在线发表了他的一篇论文,即介绍了一款可以为障碍人士提供导航辅助功能的可穿戴系统。

该系统通过摄像头拍照来获得图像等视觉信息,然后基于 AI 算法进行分析,确定目标及障碍物后等关键情况后作出判断,通过骨传导耳机的立体音和腕部皮肤的触觉等信号传递给使用者,指导使用者做出前进、左移或者右移等安全动作。该指示随着使用者移动而实时更新,一步步指示使用者达到最终目标。

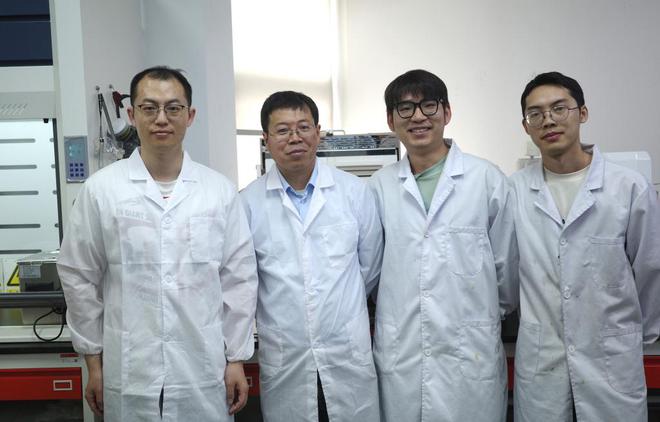

上海交通大学电院清源研究院长聘教轨副教授、博士生导师顾磊磊(左二)和部分实验室成员。 受访者供图

顾磊磊表示,以前为视障人士提供的类似导航系统往往把人当作一台车来处理。但人不是机器,有自己的特点,也对系统有自己独特的要求。人有大脑,完整的视觉回路需要 AI 和大脑中继完成,AI 的输出需要和大脑的认知一致,两套系统才能良好配合,人用起 AI 系统才会觉得像在使用自己本来的器官一样轻松自在;行为上,人也没法像机器一样严格地遵循指令,需要 AI 系统平衡准确度与自由度;最后,人的承载能力也无法和机器相比,人体力有限,希望系统足够轻、薄甚至美。传统电子辅助系统在这些方面的差距使其在盲人群体接受度始终不高。

顾磊磊的这套系统目标是提高视障人士的行动能力,通过系统提示可以避开障碍物。新系统总重约 200 克,由装载了 RGB-D(红绿蓝和深度)摄像头的眼镜、两小块人造电子皮肤和一个微型单板计算机组成。新系统从拍照到响应、输出的时间是仅 200-300 毫秒,与人类的反应时间一致,从而可以与使用者更默契地配合。

为了解决光线不足可能给拍照系统带来的风险,该系统还集成了一个红外探测器,可以“像激光雷达一样”进行主动探测,提供距离、高低等信息。

“我们调研后发现,视障人士的基本需求有三个,第一个是明暗变化,比如眼前有没有障碍物;第二个是形状;第三是看到运动的信息,比如面前是不是有东西移动过去。他们没有爬山、游泳那么高的要求。所以,我们是一直在做减法。把功能做得像车载系统一样很高很强不是我们的最终目的,我们是要它具有人们刚需使用时的合理功能,在此基础上尽力压低它的体积、重量以及能量算力等方面需求。”顾磊磊表示。

此外,该系统还提供了一双摩擦供电的智能鞋垫和 VR 训练平台,让使用者在正式出行前可以在虚拟系统中进行模拟、训练,降低摔倒、碰撞等风险。

对于新系统的局限性,顾磊磊表示,目前属于基础研究阶段,只是进行了少量的测试——一共有 20 人试用的数据,其中 18 人是视障人士。该产品如果要投放市场,需要更多的反馈数据,以进行优化。

“说不定我们可以把摄像头换掉。”顾磊磊希望把摄像头整合到隐形眼镜中,取代目前系统中的镜框眼镜,代替手杖,“让使用者尽力看起来像健全人”。

此外,他表示,很重要的一点是,希望未来的类似系统是个性化的,因为每位用户关注的东西不一样。而这样的“量身定做”可以基于 AI 算法的优化来实现。

眼球模型澎湃新闻记者吴跃伟摄