金磊发自凹非寺

量子位公众号 QbitAI

阿里又发了个有意思的大模型——

QVQ-Max,第一版视觉推理模型,对任意图像或视频都可以进行深度思考。

举个有趣的例子,上传一张你的手掌,再点击

Thinking,QVQ-Max 就可以给你看手相

可以看到,在深度思考过后,QVQ-Max 就开始逐步分析手掌上的线条和其他特征。

包括心线、头线、生命线等主要线条的分析,以及戒指手指上的金戒指的象征意义。

这还只是一个比较有娱乐性的例子。

如果你一口气给 QVQ-Max“喂”多张图片,它也可以进行深度思考:这两张图片描绘了哪些风景?它们之间的关系是什么?

在一顿思考过后,QVQ-Max 准确地识别出两张图联系——都是西湖的风景,但一张是春夏时节,另一张是冬季。

再如数学推理,同样是给它“喂”一张图即可,连提问都省了:

在思考之后,QVQ-Max 是找到了数字们之间的规律,并最终给出了正确答案:10。

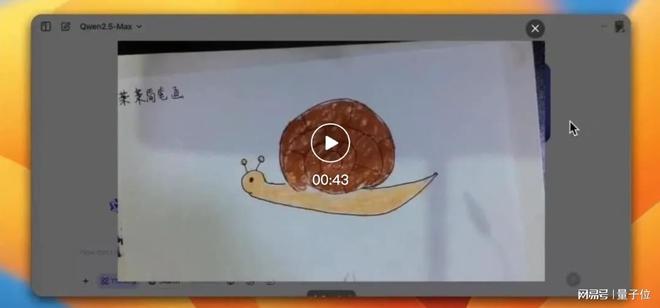

以及直接上传一个手绘简笔画视频,并附上一句:分析视频,将视觉内容与文字结合,并为视频中的镜头创建生动有趣的字幕。

最终,QVQ-Max 依旧是稳稳地完成了任务。

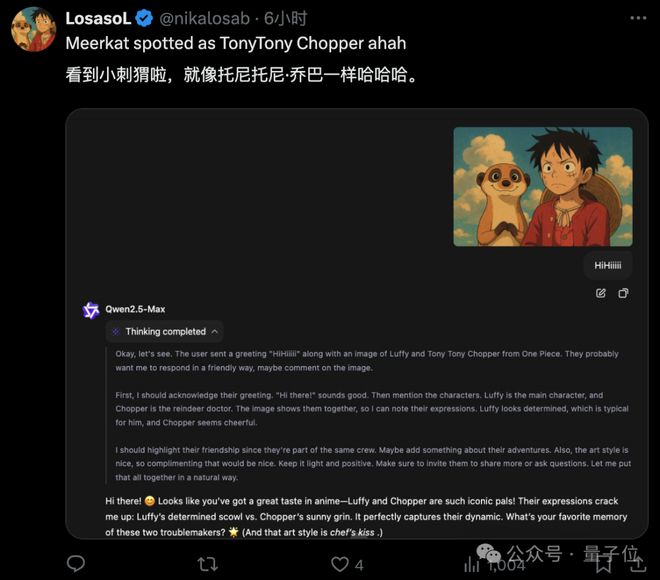

网友们看罢,也是麻溜地去试了试。

不过这一次,QVQ-Max 有点小翻车——路飞是认对了,但这个乔巴……

以及啊,这两天被 OpenAI GPT-4o 图像生成带火的吉卜力,网友们也是跟上了:

那么 QVQ-Max 的图像视频深度思考实力到底如何,我们这就亲手尝试一番。

实测 QVQ-Max

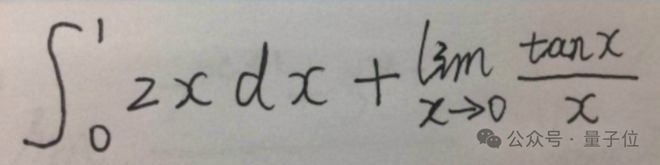

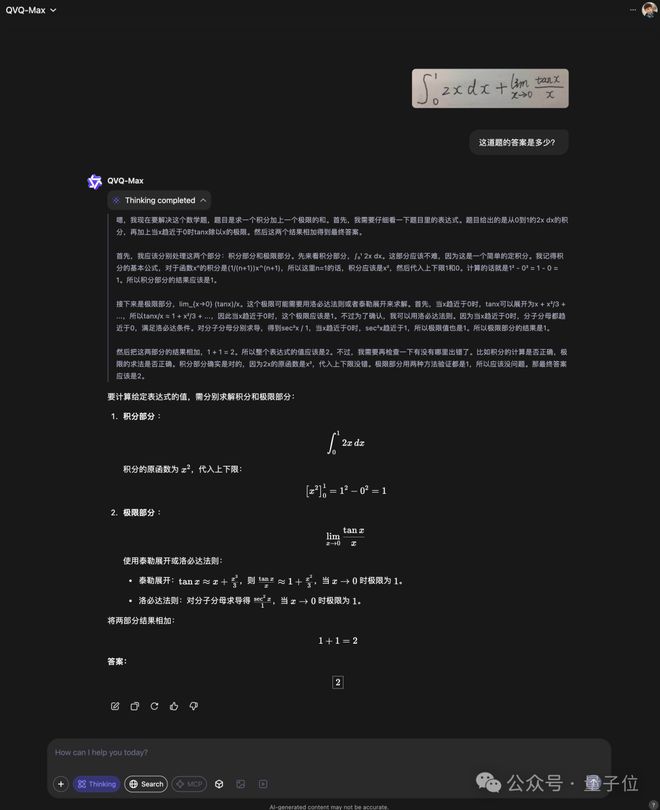

首先,我们还是来测试一下 QVQ-Max 看图解数学题的能力。

题目是这样的:

然后我们提问:这道题的答案是多少?

在深度思考过后,QVQ-Max 不仅精准识别出了手写的题目,而且给出了正确答案:2。

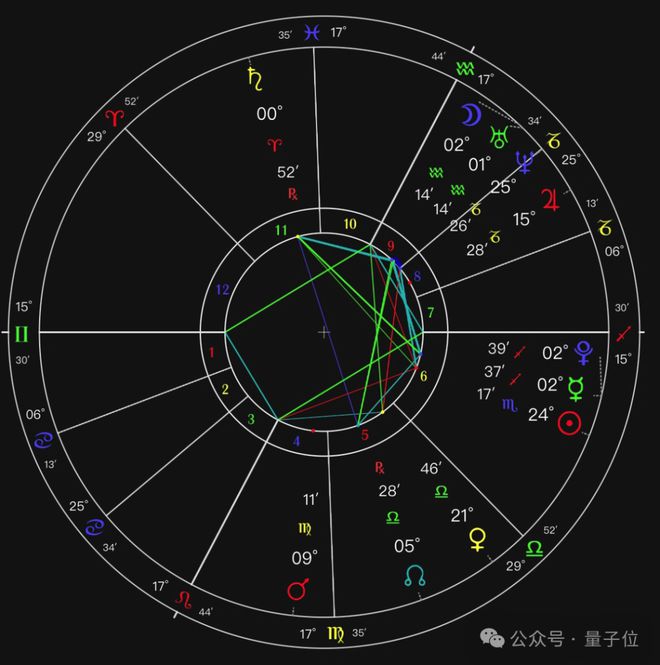

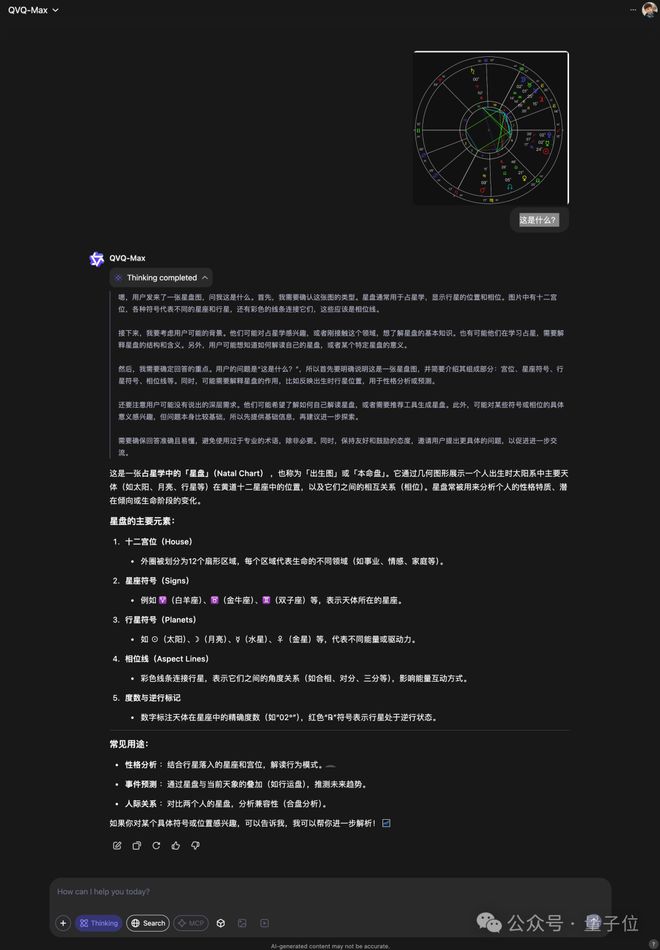

刚才 Qwen 官方给出了看手相的例子,这次我们再来“喂”下这张图:

问题是这样的:这是什么?

嗯,是比较全面地介绍了星盘。

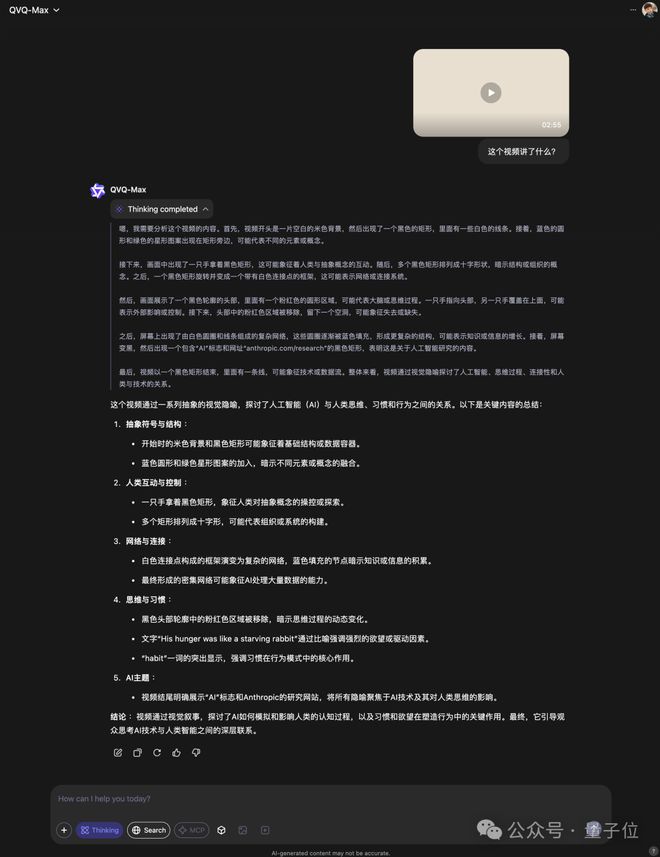

接下来,我们再来测试一下视频推理,例子就用 Anthropic 最新发布的一个:

若是刨去视频里的背景音,单是看内容,还是比较抽象的。

对此,QVQ-Max 给出的理解是:

从观察到推理

除了效果之外,虽然 Qwen 团队没有公布相关论文,但对于背后的技术亮点,团队还是简单的介绍了一番。

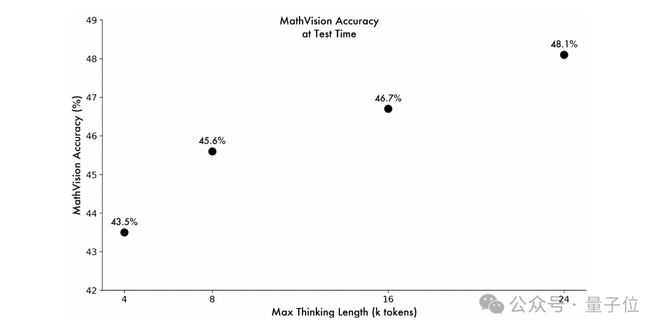

首先,团队在MathVision这个 benchmark(汇集各类困难多模态数学)上进行了一番测试:

结果表明,通过调整模型 thinking 的最大长度,模型在 MathVision 上的准确率也会持续提升。

除此之外,团队还总结了 QVQ-Max 的三大能力特点。

包括对图片的解析能力非常强,无论是复杂的图表还是日常生活中随手拍的照片,它都能快速识别出关键元素。比如,它可以告诉你一张照片里有哪些物品、有什么文字标识,甚至还能指出一些你可能忽略的小细节。

仅仅识别出图片里的内容还不够,QVQ-Max 还能进一步分析这些信息,并结合背景知识得出结论。

例如,在一道几何题中,它可以根据题目附带的图形推导出答案;在一段视频里,它能根据画面内容推测出接下来可能发生的情节。

除了分析和推理,QVQ-Max 还能做一些有趣的事情,比如帮你设计插画、生成短视频脚本,甚至根据你的需求创作角色扮演的内容。

如果你上传一幅草稿,它可能会帮你完善成一幅完整的作品;上传一个日常照片,它可以化身犀利的评论家,占卜师。

值得注意的是,QVQ-Max 是免费可用的哦,感兴趣的朋友快去试试吧~

体验地址:https://chat.qwen.ai