3 月 27 日凌晨,阿里巴巴发布并开源首个端到端全模态大模型通义千问 Qwen2.5-Omni-7B,可同时处理文本、图像、音频和视频等多种输入,并实时生成文本与自然语音合成输出。

据介绍,在权威的多模态融合任务 OmniBench 等测评中,Qwen2.5-Omni 刷新业界纪录,全维度远超 Google 的 Gemini-1.5-Pro 等同类模型。Qwen2.5-Omni 以接近人类的多感官方式「立体」认知世界并与之实时交互,还能通过音视频识别情绪,在复杂任务中进行更智能、更自然的反馈与决策。

现在,开发者和企业可免费下载商用 Qwen2.5-Omni,手机等终端智能硬件也可轻松部署运行。

据了解,Qwen2.5-Omni 采用了通义团队全新首创的 Thinker-Talker 双核架构、Position Embedding (位置嵌入)融合音视频技术、位置编码算法 TMRoPE(Time-aligned Multimodal RoPE)。双核架构 Thinker-Talker 让 Qwen2.5-Omni 拥有了人类的“大脑”和“发声器”,形成了端到端的统一模型架构,实现了实时语义理解与语音生成的高效协同。

具体而言,Qwen2.5-Omni 支持文本、图像、音频和视频等多种输入形式,可同时感知所有模态输入,并以流式处理方式实时生成文本与自然语音响应。

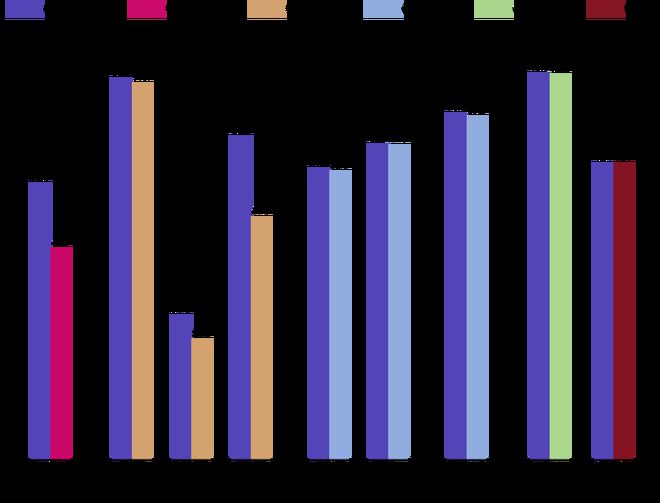

Qwen2.5-Omni 在一系列同等规模的单模态模型权威基准测试中,其在语音理解、图片理解、视频理解、语音生成等领域的测评分数,均领先于专门的 Audio 或 VL 模型,且语音生成测评分数(4.51)达到了与人类持平的能力。

相较于动辄数千亿参数的闭源大模型,Qwen2.5-Omni 以 7B 的小尺寸让全模态大模型在产业上的广泛应用成为可能。即便在手机上,也能轻松部署和应用 Qwen2.5-Omni 模型。当前,Qwen2.5-Omni 已在魔搭社区和 Hugging Face 同步开源,用户也可在 Qwen Chat 上直接体验。

资料显示,从 2023 年起,阿里通义团队就陆续开发了覆盖 0.5B、1.5B、3B、7B、14B、32B、72B、110B 等参数的 200 多款「全尺寸」大模型,囊括文本生成模型、视觉理解/生成模型、语音理解/生成模型、文生图及视频模型等「全模态」,真正实现了让普通用户和企业都用得上、用得起 AI 大模型。截至目前,海内外 AI 开源社区中千问 Qwen 的衍生模型数量突破 10 万。(定西)