最近一年来,如何用多模态大模型赋能具身智能研究是个十分火热的话题。然而,主流的多模态大模型聚焦于 2D 视觉理解,这对需要三维空间感知理解能力的具身智能来说是远远不够的。

由于无法精准地感知理解三维空间,一些基于流行的 2D 视觉语言模型构建的具身大模型,局限于完成 high-level 规划任务,而在 manipulation 任务上表现很差。

赵波教授于 8 月份入职上海交通大学,此前,早在 2024 年初该团队产生了让多模态大模型理解三维空间并赋能具身 manipulation 的想法。

图赵波(来源:赵波)

考虑到许多机械臂上都配备有深度相机,能够提供精准的深度信息,因此他们计划训练一个面向具身智能的、能够同时理解 RGB+D 信息的多模态模型。

不管是流行的视觉特征提取器还是多模态大语言模型,都没有在深度图上训练过。因此,需要设计合适的深度图接入方式,收集深度图数据用于模型训练。

他们详细思考了如何让模型工作在任何场景下,即在不同任务中统一 RGB、深度信息的获取、模型输入和输出。

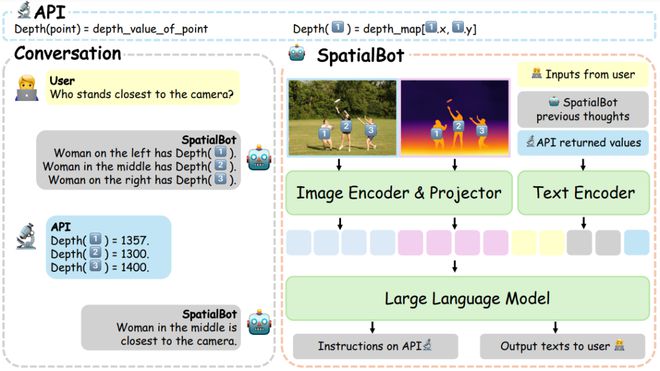

为了让模型准确获得深度图上的信息,他们参考 Agent 的模式,设计了 Depth API 供模型调用深度图上任意点的深度值。

图 SpatialBot 模型结构图(来源:arXiv)

在一开始,他们比较执着于大规模地使用深度图进行预训练,因此收集了很多基于 RGB 图像的大模型视觉问答数据,以及传统视觉任务中的 RGBD 数据。

通过使用课题组的数据引擎,能够将它们转化为可以被用于训练多模态大模型的 RGBD 视觉问答数据格式。在后续的实验中他们发现,大规模的粗糙数据不如小规模的、精心设计的高质量数据有效。

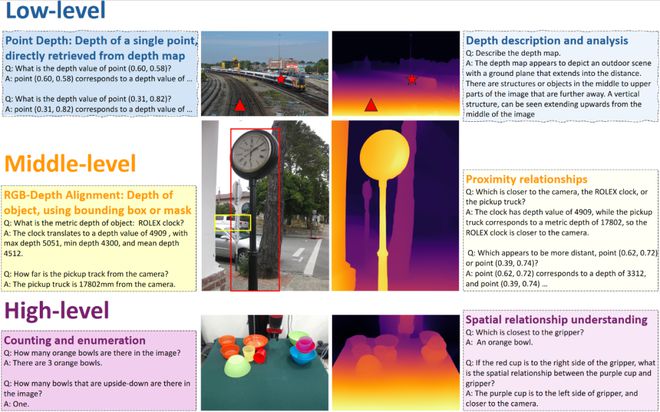

因此他们决定设计 SpatialQA,在对话中引导模型从深度图中获取知识,以便回答一些没有深度图信息就无法回答的问题,例如图像中某个点的深度、物体的深度、以及根据深度图猜测拍摄的场景和物体等。

然后,他们引导模型使用深度信息完成更高层的任务,比如多个物体之间的位置关系判断,遮挡情况下的物体计数等。最终,他们构造出包含大量不同场景和任务的 39k 高质量训练数据。

图 SpatialQA 中包含的任务和数据类型(来源:arXiv)

为了评测多模态大模型的空间理解能力,他们也提出了空间关系能力的评测基准 SpatialBench。

通过消融实验,他们发现在 SpatialQA 数据集上训练的模型确实能够有效利用深度图来理解空间关系。此外,SpatialQA 甚至可以大幅提升多模态大模型在通用指标上的性能。

在完成通用领域的实验后,在机器人任务上做进一步的实验。他们选择依照谷歌机器人 RT 的思路训练,并尝试了多个测试环境,包括 UR5 虚拟环境、ManiSkill、calvin、达闼机器人、Franka 真机等。

在初步版本中,他们沿袭了大模型对于 bounding box 的预测形式,直接让大模型输出编码后的数字,借此取得了不错的效果。

并在真机上收集了大规模的、以空间理解为中心的机器人数据集 SpatialQA-E 用于训练面向机器人任务的空间理解大模型。

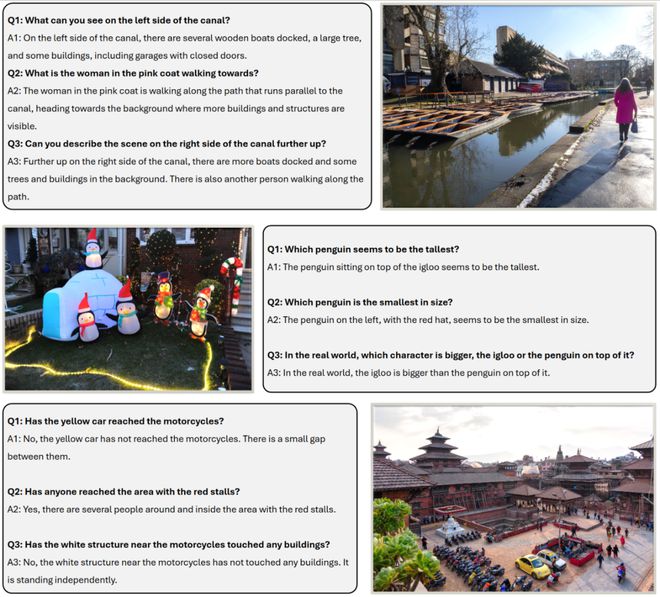

图 SpatialBot 可以精准理解自然场景(来源:arXiv)

研究中,他们与北京大学董豪教授团队开展深入合作,获得了包括真机实验等多方面的支持。借此发现,SpatialBot 模型和数据受到了许多学术界和产业界的关注,并正在被不同领域的研究者使用。

日前,相关论文以《SpatialBot:使用视觉语言模型进行精确的空间理解》(SpatialBot: Precise Spatial Understanding with Vision Language Models)为题发在arXiv[1],Wenxiao Cai 是第一作者,赵波担任通讯作者。

图相关论文(来源:arXiv)

通过增强多模态大模型的的三维空间理解能力,本次研究可以促进具身智能在工业机器人、医疗机器人和家用机器人等诸多领域的应用。

图 SpatialBot 可以精准的理解机器人场景(来源:arXiv)

例如,在工业制造中,具备空间理解能力的机器人可以在受限的空间内精准操作,进行微小零件的组装或复杂焊接,提高生产效率和产品精度。

在医疗领域,手术机器人基于精确的空间理解,能对更复杂的组织结构进行切割、缝合等操作。

在家庭环境中,服务机器人基于更精准的空间理解能力,能够更智能地进行室内导航和对不规则物体的抓取等操作,从而完成更复杂的任务。

接下来,他们会在空间大模型方向继续探索。从数据和模型两个方面,提升空间大模型的空间理解能力,提升大模型操控机器人的精准度和平滑度,以便完成更复杂的机器人抓取任务。

参考资料:

https://arxiv.org/pdf/2406.13642

运营/排版:何晨龙