明敏发自凹非寺

量子位公众号 QbitAI

超逼真的机器人小镇来了!

在这里,机器人可以像人一样在超市里购物:

买菜回家做饭:

在办公室里接咖啡(旁边还有人类同事):

不只有人形机器人,机器狗、臂式机器人也在这个“城市”里穿梭自如。

这就是由上海 AI 实验室最新提出的首个模拟交互式 3D 世界:GRUtopia(中文名:桃源)。

在这里,由多达100k个交互式、带精细注释的场景自由组合成逼真城市环境。

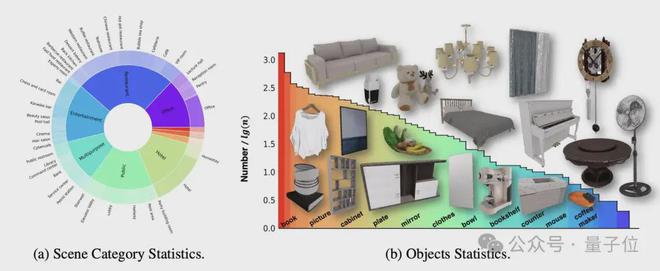

包含室内室外,餐厅、超市、办公室、家庭等89 个不同场景类别。

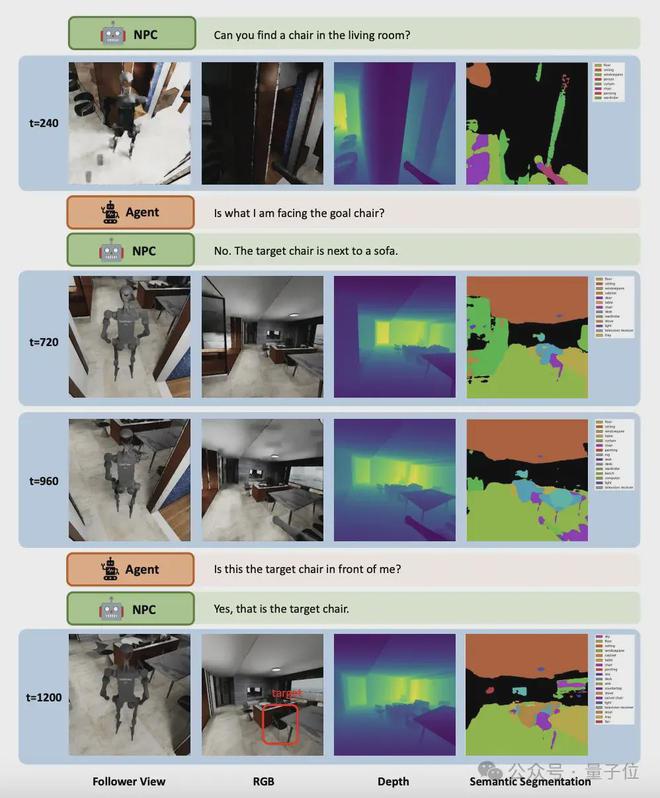

由大模型驱动的 NPC,可以在这个世界里和机器人对话交互。

这样一来,各种机器人能在虚拟小镇里完成各种行为模拟,也就是最近流行的 Sim2Real 路线,能大幅降低具身智能现实世界数据收集难度和成本。

该项目计划开源,现阶段在 GitHub 上已提供 demo 安装指南。

安装成功后,就能在 demo 里控制一个人形机器人在房间内活动,并支持调整不同视角。

机器人的虚拟桃源

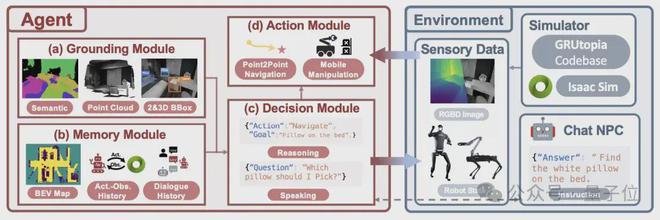

其核心工作共有三项:

- GRScenes

- GRResidents

- GRBench

其中,GRScenes 是一个包含大规模场景数据的数据集。

它极大程度上扩展了机器人可以活动和操作的环境范围,此前的工作更聚焦于家庭场景。

该研究表示,他们的目标是将通用机器人的能力扩展到各种服务场景,比如超市、医院等。同时覆盖室内室外环境,包括游乐园、博物馆、展览馆等。

对于各个场景,他们都进行了精细高质量建模,100 个场景包含 96 个类别的 2956 个交互式物体和 22001 个非交互式物体。

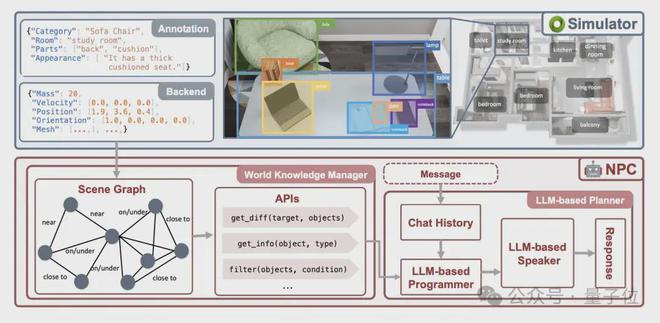

GRResidents 是一个 NPC 系统。

它由大模型驱动,同时对模拟环境中的场景信息非常了解。因此 NPC 可以推断物体之间的空间关系,参与动态对话和任务分配。

借助于这个系统,GRUtopia 可以生成海量场景任务供机器人完成。

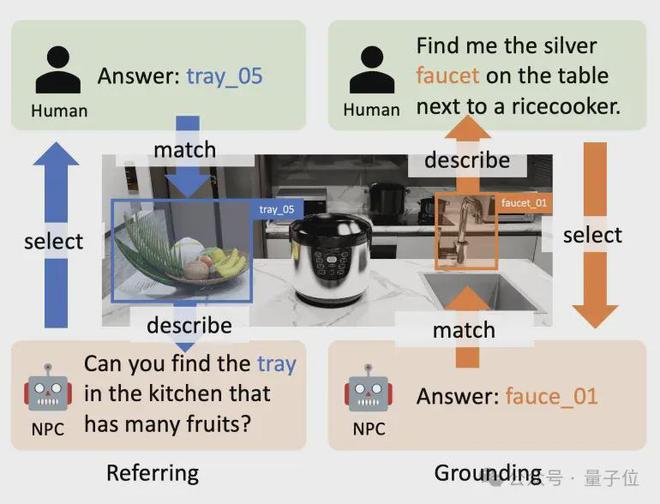

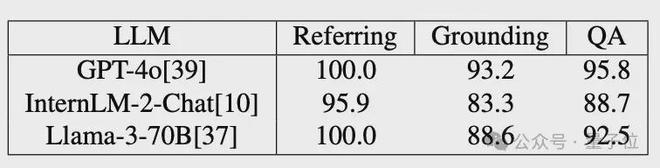

通过与人类进行交叉验证,NPC 系统在描述和定位对象上的准确率都不错。

在描述实验中,让 NPC 系统随机选择一个物体进行描述,人类能找到对应物体就算成功。

在定位实验中则反过来,如果 NPC 系统能根据人类给出的描述找到对应物体就算成功。

调用不同大模型的成功率不尽相同,综合来看 GPT-4o 的表现最好。

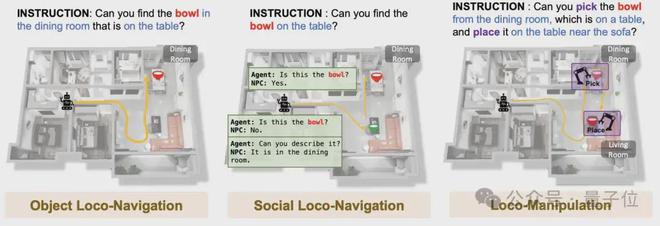

GRBench 是一个评估具身智能表现的 benchmark。

它包含 3 个基准,涉及目标定位导航(Object Loco-Navigation)、社交定位导航(Social Loco-Navigation)和定位操作(Loco-Manipulation),这三种评估的难度逐渐递增。

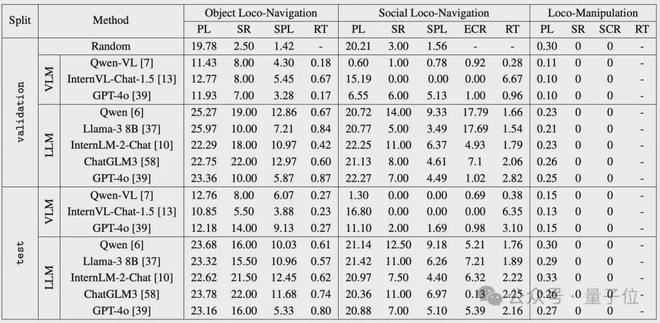

为了分析 NPC 和控制 API 的性能,研究提出了基于 LLM 和 VLM 的基线,以验证基准设计的合理性。

实验结果表明,与随机策略相比,在所有基准测试中,使用大型模型作为后端代理的表现都更好。

而且Qwen-VL 在对话上的表现超过了 GPT-4o。

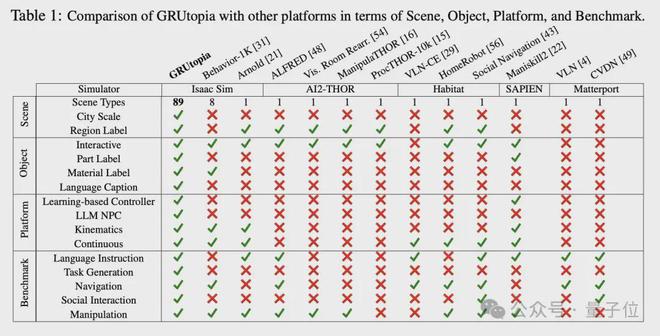

最后整体对比来看,GRUtopia 其他平台在各个维度上都更强大。

该研究工作由上海人工智能实验室 OpenRobot Lab 领衔。

该实验室聚焦研究具身通用人工智能,致力于构建软硬虚实一体化的通用机器人算法体系。

今年 5 月,该团队还发布了具身多模态大模型 Grounded 3D-LLM,能够自动化生成物体到局部区域的场景描述与具身对话数据,有效缓解了目前三维场景理解的局限性。

论文地址:

https://arxiv.org/abs/2407.10943

GitHub 地址: