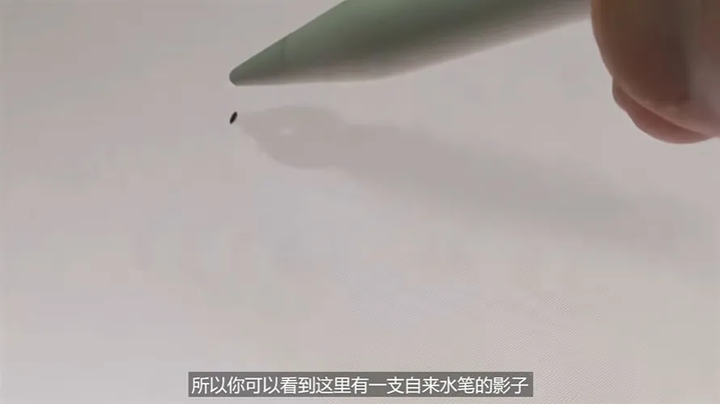

iPad Pro 2024 最令我感兴趣的特性,不是新的 M4 芯片,也不是新的 OLED 屏幕,而是那一支 Apple Pencil Pro 和 iPad Pro 2024 之间一个微小的「化学反应」:当你使用 Apple Pencil Pro 在 iPad Pro 2024 上进行绘画写作时,屏幕上会显示对应笔刷的阴影,让用户知道当前的 Apple Pencil Pro 是何种模式。

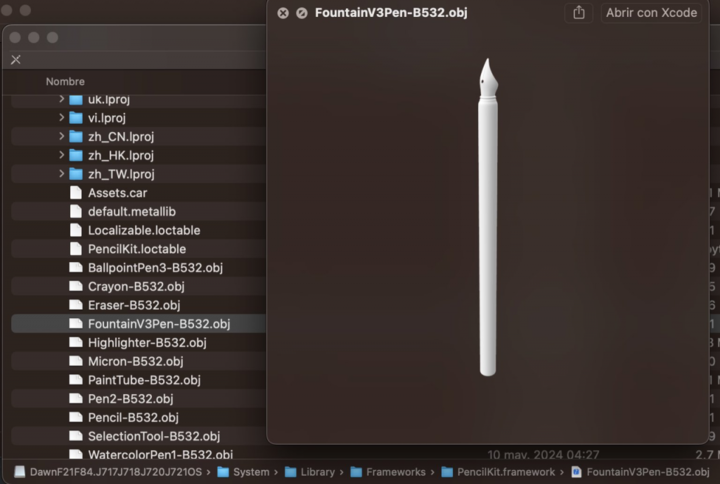

随后,就有人在苹果的 PencilKit 框架中找到了苹果为该功能开发的 10 个 3D 模型。

而且有意思的是,这个阴影并非简单的贴图,它会根据真实世界里 Apple Pencil Pro 的位置,与屏幕的距离,还有倾斜角度进行相应变化,简言之,它具有极强的「真实性」、「空间感」和「互动性」。

关于这一支 Apple Pencil Pro 更多的信息也被披露:苹果给它塞进去了新的触觉反馈引擎、新的压力传感器、陀螺仪及 U2 芯片。它有潜力在 iPad Pro 上模拟真实的书写体验,以及也有潜力和 Vision Pro 进行联动。

苹果的模仿游戏

苹果是这个世界上最喜欢通过硬件,模拟出真实世界感官体验的企业。

在 2015 款 MacBook 上搭载的 Taptic Engine,通过振感和触感的细腻模拟,触控板成功实现了「以假乱真」。也许直到现在,还有很多人都不知道 MacBook 的 Force Touch 触控板本身是「无法按动」的一个平面。

而不管是 3D Touch,抑或是现在没有压感的 Haptic Touch,iPhone 都在这一款平面的玻璃上,通过恰到好处的振动反馈,模拟出一种按下了按钮回弹的神奇感觉,配上模仿按钮按动的音效,让人忍不住多按几次。

同样的技术也在 iPhone 7 的 Home 键、Apple Watch 旋转表冠上得到了运用,都实现了非常接近机械按键和齿轮的触感。

除了用 Taptic Engine「欺骗」用户的手指,iOS 14 搭配 AirPods 设备营造的「空间音频」,通过模拟 3D 空间中各种方向感的声音,以及头部追踪技术,给用户带来「声临其境」的感觉。社交平台上,有不少用户表示打开空间音频后,戴上耳机还以为手机在外放。

在 Apple Pencil Pro 发布之前,不少消息来源都预测,苹果会在这支新的笔上配备全新的 Taptic Engine,让 Apple Pencil Pro 和 iPad 也能提供接近纸笔的真实摩擦感。

这样听起来有点「科幻」的功能,却也不让人感到天马行空,因为苹果就是一个喜欢并且擅长把振动马达玩出花的厂商。即使目前的 Pencil 还没实现相关功能,依然未来可期。

而另一家也很喜欢用硬件欺骗用户感官的企业是任天堂。

Nitendo Switch 上的 Joy-Con 手柄支持「HD 振动」的技术,玩家可以仅仅凭借不同的振动手感,分辨出「往杯子倒冰」和「往杯子倒水」的细微区别。而配合上 Switch Labo 纸皮套装,手柄里的陀螺仪和振动马达还能够神还原从水里钓出鱼的真实手感。

无论是苹果的振动魔法,还是任天堂的 Labo 套件和手柄,都是在用「一种硬件」模拟出「无数种可能性」。

像是 iPhone 7 上的 Taptic Engine,不单纯为模拟 Home 键和 3D Touch 存在,输错密码手机「摇头」般的振动,以及系统中的各种反馈,各种振动动作都靠内部这块巨大的 Taptic Engine 完成。

空间音频也是类似,通过陀螺仪和加速感应器,AirPods Max 能够模拟复杂的、带有空间感方位性的声音。

如果说任天堂是为了给玩家带来更逼真的游戏体验,那么苹果的「模仿游戏」,则是全方位的模拟,涵盖了触觉、听觉、视觉。

因而,Apple Pencil Pro 的投影,绝不是一个孤立的小彩蛋。

Vision Pro 的补完计划

在去年 visionOS 测试过程中,就有开发者发现,当用户手持 Apple Pencil 的时候, Vision Pro 无法正常识别手指的捏合操作,但官方的反馈说「这是经过设计的特性,并非 BUG」,可见识别 Apple Pencil 很可能在 Vision Pro 中已经存在。

而触觉反馈引擎、新的压力传感器、陀螺仪及 U2 芯片等硬件的加入,使得它也更像一个更小型的 VR 手柄,逻辑上相当类似。

无独有偶,罗技为 Meta Quest 2 和 3 推出了一款应用于 VR 设备的手写笔 MX INK。

这支比 Apple Pencil 2 重了 10 克的手写笔,既可以像传统触控笔一样在混合现实环境中创建平面的内容,也支持六自由度的跟踪,在 3D 空间内自由创作,笔身配备有多个按钮,笔端还支持压敏。

▲ 罗技 MX INK

所以,Vision Pro 需要一支笔吗?或者说,它需要除了眼睛和手指之外的「外设」吗?

在聊这个开放性问题之前,我们可以看看苹果在 WWDC24 上为开发者准备的一系列科普视频:比如《打造引人入胜的空间照片和视频使用体验》。

里面提到了很多概念性的东西,苹果把立体视频体验分为:3D 视频,空间视频和苹果沉浸式视频:

- 3D 视频在平面上呈现,内容具有纵深感,类似我们在电影院看的 3D 电影

- 空间视频,在具有立体感之余,内容会被缩放到对象的真实大小,边界模糊

- 沉浸式视频则完全环绕着用户,用户不是看视频,而是置身其中

其中,「空间视频」能模仿现实世界中人们的在场感,可以在一定幅度内改变观看的角度;而「沉浸式视频」则更加极致,用户目之所及都是视频,用户成为了视频的一部分。

并且,苹果还提出了另外的要求,例如,沉浸式视频需要有可以交互的 3D 内容。

▲ 漫威为 Vision Pro 推出的《What If…?》沉浸式故事,可以让用户伸手参与其中(图源:YouTube @Adam Savage’s Tested)

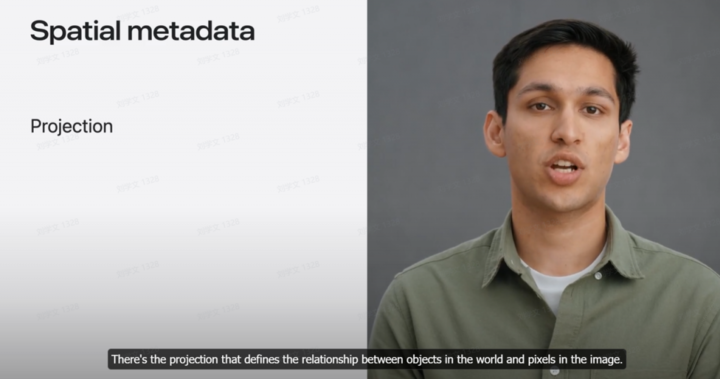

科普视频中还提到了「空间元数据」的概念,其中还有关于「投影」的解释:投影定义了世界中物体和图像中像素之间的关系。

Apple Pencil Pro 里的小彩蛋,也在 Vision Pro 的开发者科普视频里得到解释:苹果从未把 iPad Pro 2024 和 Apple Pencil Pro 当作分离的设备,它们通过「投影」联系在了一起。

也就是说,一支 Apple Pencil 未来或许能在 Vision Pro 的虚拟世界中「投影」为各种不同形态的笔。

既然 Vision Pro 能解释关于 Apple Pencil Pro 的疑问,那么苹果作为这个「模仿游戏」的集大成者,我们也有理由相信,现在的 Vision Pro 还在产品初期阶段,它在视觉和听觉上已经能实现相当程度的「以假乱真」,但是在触觉上还远远不够,这自然归结到 Vision Pro 还没有专门适配的外设,总不能靠 Vision Pro 装马震我们的脑瓜子吧?

现在,我们几乎可以确定带有振动引擎、陀螺仪和 U2 芯片的 Apple Pencil Pro 能和 Vision Pro 发生联动,Apple Pencil Pro 也可以在屏幕上投影成「其他模样」,例如一支墨水钢笔;那么这根笔也许可以像其他 VR 设备的手柄那样,变成 Saber Beat 游戏里的光剑,或者,《哈利·波特》系列里的魔杖?

▲ Dexmo 力反馈手套

还能再天马行空一点,或许苹果还会发布一种「力反馈手套」,整个手套布满振动马达,再配合苹果的调校,让用户真的能「触摸」到 Vision Pro 呈现的虚拟世界。

当下几乎可以确定的是,苹果已经在想办法,在 Vision Pro 里加入更多的「交互」,因为 Vision Pro 还不是完全体,苹果用虚拟替换现实的「模仿游戏」也远未结束。

「真实感」的重要性

在曾经的文章中,我们讨论过按键的重要性。而来到 Vision Pro 这种让用户类似「无实物表演」的场景,交互和反馈可以说更加重要,科技杂志《连线》主编曾经有这么一句话:

所有设备都需要交互。如果一个东西没有交互感,它就会被认为是坏了。

这完美契合了我第一次试用 Vision Pro 的体验:无论我以哪种方式、哪个位置去尝试使用手势操作,都无法点按到想点的按钮,而我甚至不知道这是 Vision Pro 的问题,还是我自己的问题。

因此,苹果就算要砍掉 3.5 毫米耳机接口、减少电池容量,也要腾出空间容纳一块巨大的 Taptic Engine,既通过舍弃机械结构延长了部件的寿命,也同时确保了交互反馈的真实感。

交互的实感也不仅仅是反馈设备坏了与否的信号,如果想更深一层,我们已经从「按键」时代彻底转向了「触控」的时代,也正在进入「隔空操作」的时代。在未来,或许我们不会再需要触摸任何设备就能实现各种操作,各种全息 UI 会环绕着我们,想做什么只需要随时在空中指指点点,或者语音操控。

这种虚拟和现实模糊的未来会给我们带来各种不确定感,比如说,你怎么知道自己是活生生的人,而不是缸中的一个大脑呢?

或许苹果的「模仿游戏」总有一天会随着操作的变革而彻底结束,但在这之前,我们依旧可以期待苹果会如何用各种方式,骗过我们的手指和大脑。