西风发自凹非寺

量子位公众号 QbitAI

笑不活,最新虚拟试穿神器被网友们玩坏了。

黄院士、马斯克、奥特曼、史密斯等一众大佬衣服集体被扒。

前有老黄卸下皮衣套上糖果包装袋:

后有奥特曼大秀花臂穿 CUCCI:

再有老马变成了蛛蛛侠:

好莱坞巨星史密斯也风格大变:

但说回研究本身,确实正儿八经的研究。

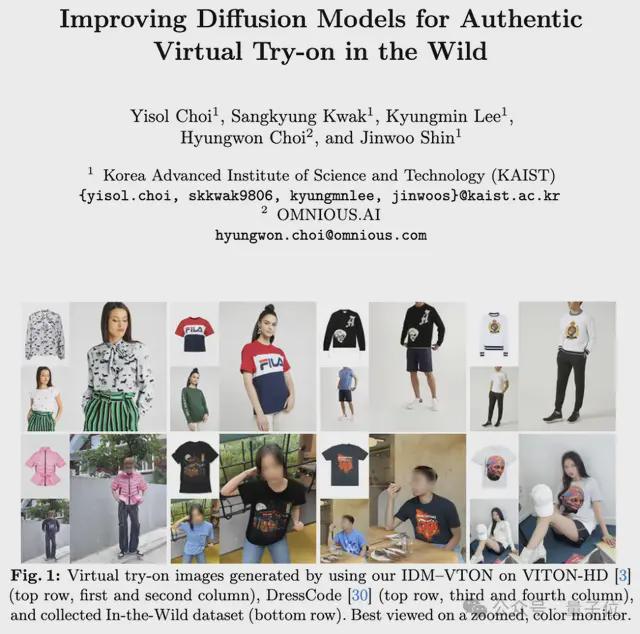

名为 IDM–VTON,由来自韩国科学技术院和 OMNIOUS.AI 公司的研究团队基于扩散模型打造。

目前官方放出了 demo,大伙儿可以试玩,推理代码已开源。

除了开头所展示的,抱抱脸研究员也玩的不亦乐乎,给老黄换上了专属战袍。其 CEO 连忙转发打趣:我被替代了,没法和他争 CEO。

看热闹的网友也是感慨,经过这么多年,终于不用再担心自己“手残”了(AI 帮你搞定)。

来玩啊~

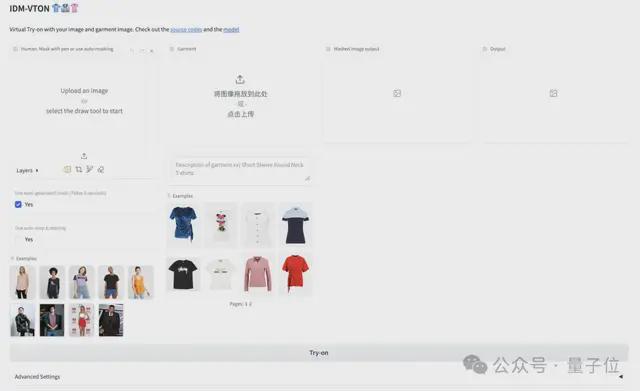

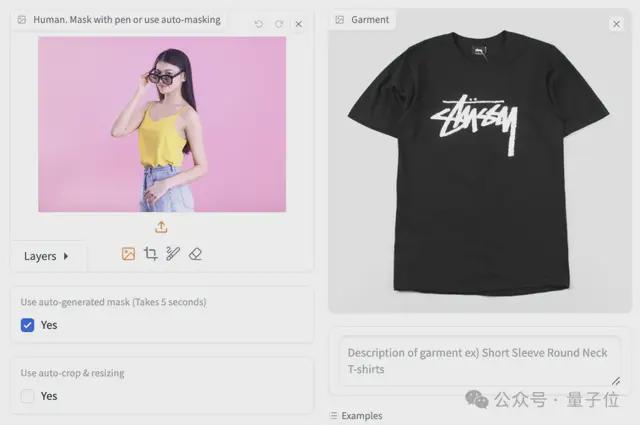

我们也赶紧上手体验了一把。demo 整个页面是这样婶儿的:

操作起来也是非常简单。

首先上传人物图,可以手动或者自动选择要修改的区域。然后,上传要换的衣服。

直接点击 Try-on,会自动生成掩模图和换装后的图:

上面这张自动生成的掩模把手也选进去了,所以最后生成的左手效果不好。

我们手动选取涂抹一下,同时人和衣服全部都用我们自己的图。

这次效果大伙儿觉得如何?

再来展示一波网友的试玩成品图。

DeepMind 联合创始人苏莱曼穿上了微笑面具修格斯联名款T恤:

甚至不少网友真想要这件衣服。

奥特曼再次被网友当成模特:

当然也有翻车的时候,比如马斯克穿的就是山寨 CUCCI。

看完效果后,接着来看 IDM–VTON 在技术上是如何实现的。

基于扩散模型

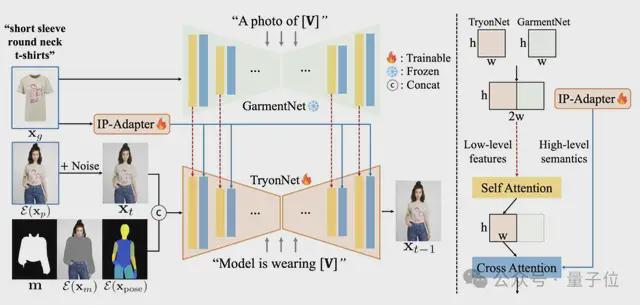

技术方面,IDM–VTON 基于扩散模型,通过设计精细的注意力模块来提高服装图像的一致性,并生成真实的虚拟试穿图像。

模型架构大概包含三部分:

- TryonNet:主 UNet,处理人物图像。

- IP-Adapter:图像提示适配器,编码服装图像的高级语义。

- GarmentNet:并行 UNet,提取服装的低级特征。

在为 UNet 提供输入时,研究人员将人物图片的含噪声潜在特征、分割掩模、带掩蔽的图片和 Densepose 数据整合在一起。

他们还会为服装添加详细描述,例如[V]表示“短袖圆领T恤”。这个描述随后用作 GarmentNet(例如,“一张[V]的照片”)和 TryonNet(例如,“模特正在穿[V]”)的输入提示。

TryonNet 和 GarmentNet 产生的中间特征进行了合并,随后传递至自我注意力层。研究人员只使用了来自 TryonNet 的输出的前半部分。这些输出与文本编码器和 IP-Adapter 的特征一起,通过交叉注意力层进行融合。

最终,研究人员对 TryonNet 和 IP-Adapter 模块进行了精细调整,并锁定了模型的其它部分。

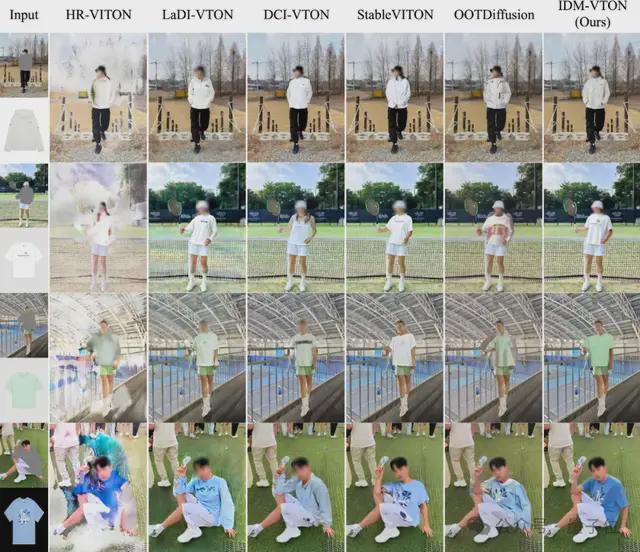

实验阶段,他们使用 VITON-HD 数据集训练模型,并在 VITON-HD、DressCode 和内部收集的 In-the-Wild 数据集上进行评估。

IDM–VTON 在定性和定量上都优于先前的方法。

IDM-VTON 可以生成真实的图像并保留服装的细粒度细节。

更多细节,感兴趣的家人们可以查看原论文。

项目链接:

[1]https://idm-vton.github.io/?continueFlag=589fb545dbbb123446456b65a635d849

[2]https://arxiv.org/abs/2403.05139

[3]https://huggingface.co/spaces/yisol/IDM-VTON?continueFlag=589fb545dbbb123446456b65a635d849

参考链接:

[1]https://twitter.com/multimodalart/status/1782508538213933192

[2]https://twitter.com/fffiloni/status/1783158082849108434

[3]https://twitter.com/ClementDelangue/status/1783179067803533577