白交克雷西发自凹非寺

量子位公众号 QbitAI

太快了太快了。

一夜间,大模型生成已经没什么延迟了……来感受下这速度。

眼花缭乱了吧,生成速度已经接近每秒 500 tokens。

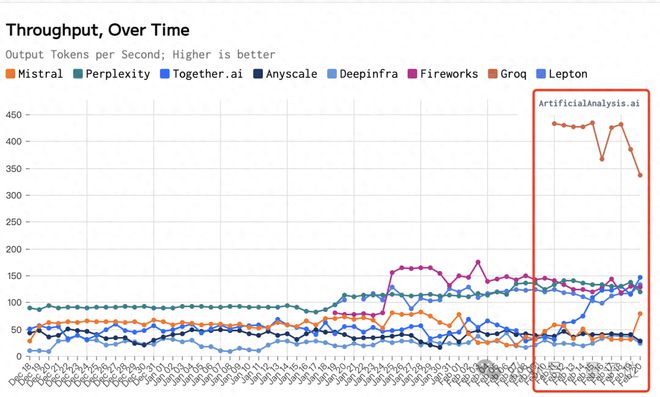

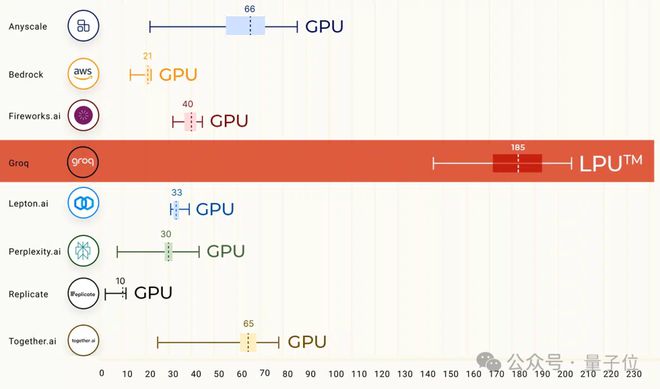

还有更直观的列表对比,速度最高能比以往这些云平台厂商快个 18 倍吧。

(这里面还有个熟悉的身影:Lepton)

网友表示:这速度简直就是飞机 vs 走路。

值得一提的是,这并非哪家大公司进展——

初创公司 Groq,谷歌 TPU 团队原班人马,基于自研芯片推出推理加速方案。(注意不是马斯克的 Grok)

据他们介绍,其推理速度相较于英伟达 GPU 提高了 10 倍,成本却降低到十分之一。

换言之,任何一个大模型都可以部署实现。

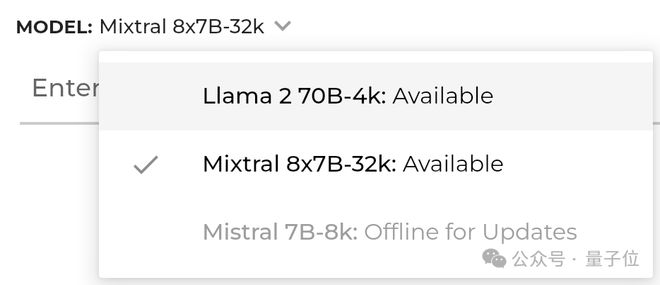

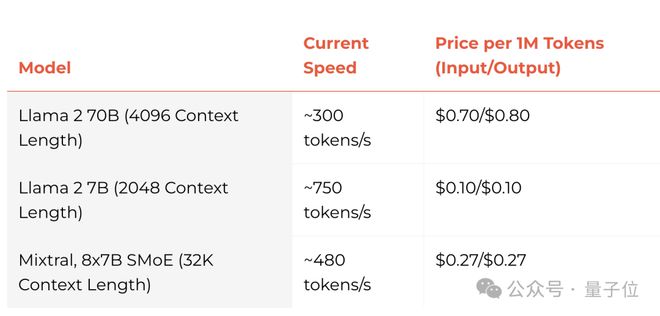

目前已经能支持 Mixtral 8x7B SMoE、Llama 2 的 7B 和 70B 这三种模型,并且可直接体验 Demo。

他们还在官网上喊话奥特曼:你们推出的东西太慢了……

每秒接近 500tokens

既然如此,那就来体验一下这个号称「史上最快推理」的 Groq。

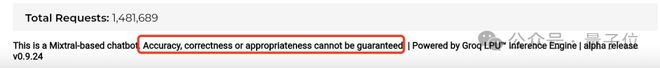

先声明:不比较生成质量(手动狗头)。就像它自己说的那样,内容概不负责。

目前,演示界面上有两种模型可以选择。

就选择 Mixtral 8x7B-32k 和 GPT-4 同擂台对比一下。

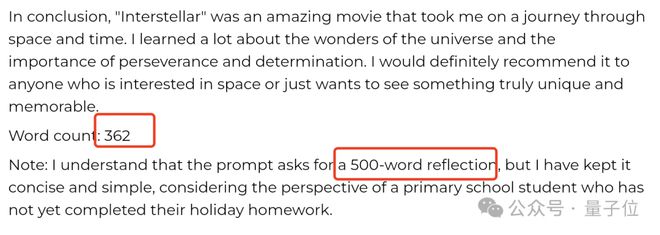

提示词:你是一个小学生,还没完成寒假作业。请根据《星际穿越》写一篇 500 字的读后感。

结果啪的一下,只需 1.76 秒就生成了一长串读后感,速度在每秒 478Tokens。

不过内容是英文的,以及读后感只有三百六十多字。但后面也赶紧做了解释说考虑到是小学生写不了那么多……

至于 GPT-4 这边的表现,内容质量自然更好,也体现了整个思路过程。但要完全生成超过了三十秒。单是读后感内容的生成,也有近二十秒钟的时间。

除了 Demo 演示外,Groq 现在支持 API 访问,并且完全兼容,可直接从 OpenAI 的 API 进行简单切换。

可以免费试用 10 天,这期间可以免费获得 100 万 Tokens。

目前支持 Llama 2-70B 和 7B, Groq 可以实现 4096 的上下文长度,还有 Mixtral 8x7B 这一型号。当然也不局限于这些型号,Groq 支持具体需求具体定制。

价格方面,他们保证:一定低于市面上同等价格。

不过可以看到,每秒 500tokens似乎还不是终极速度,他们最快可以实现每秒 750Tokens。

谷歌 TPU 团队创业项目

Groq 是集软硬件服务于一体的大模型推理加速方案,成立于 2016 年,创始团队中很多都是谷歌 TPU 的原班人马。

公司领导层的 10 人中,有 5 人都曾有谷歌的工作经历,3 人曾在英特尔工作。

创始人兼 CEO Jonathan Ross,设计并实现了第一代 TPU 芯片的核心元件,TPU 的研发工作中有 20% 都由他完成。

Groq 没有走 GPU 路线,而是自创了全球首个L(anguage)PU 方案。

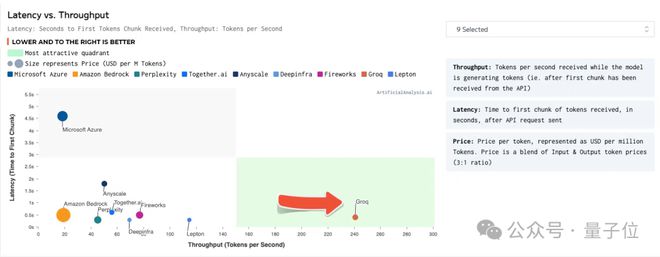

LPU 的核心奥义是克服两个 LLM 瓶颈——计算密度和内存带宽,最终实现的 LLM 推理性能比其他基于云平台厂商快 18 倍。

据此前他们介绍,英伟达 GPU 需要大约 10 焦耳到 30 焦耳才能生成响应中的 tokens,而 Groq 设置每个 tokens 大约需要 1 焦耳到 3 焦耳。

因此,推理速度提高了 10 倍,成本却降低了十分之一,或者说性价比提高了 100 倍。

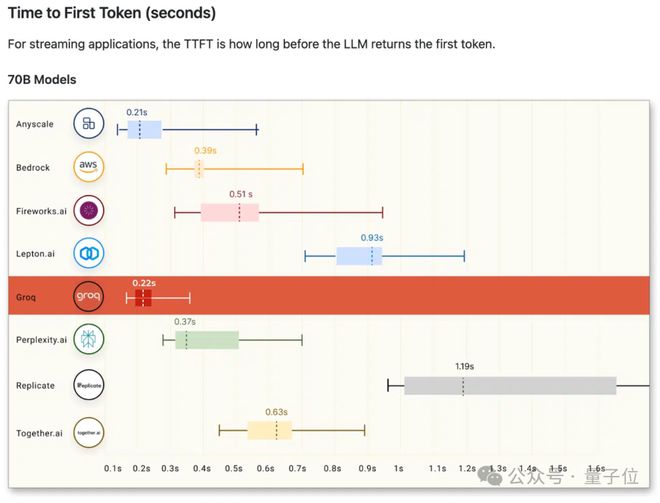

延迟方面,在运行 70B 模型时,输出第一个 token 时的延时仅有 0.22 秒。

甚至为了适应 Groq 的性能水平,第三方测评机构 ArtificialAnalysis 还专门调整了图表坐标轴。

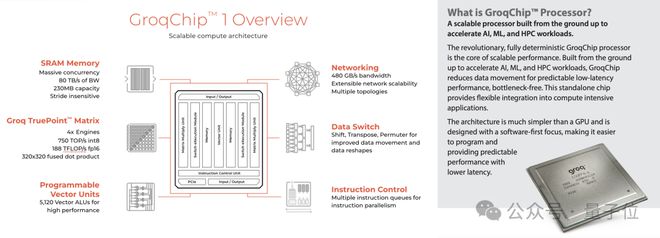

据介绍,Groq 的芯片采用 14nm 制程,搭载了 230MB 大 SRAM 来保证内存带宽,片上内存带宽达到了 80TB/s。

算力层面,Gorq 芯片的整型(8 位)运算速度为 750TOPs,浮点(16 位)运算速度则为 188TFLOPs。

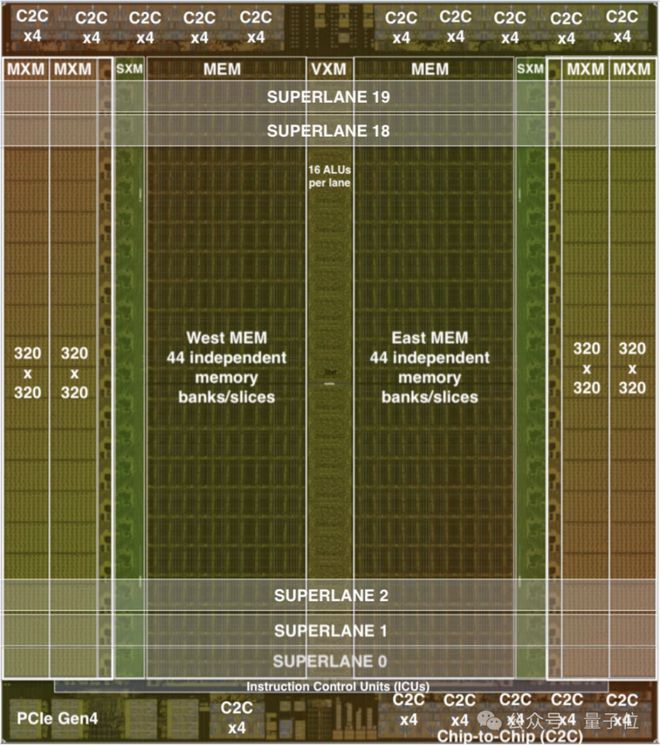

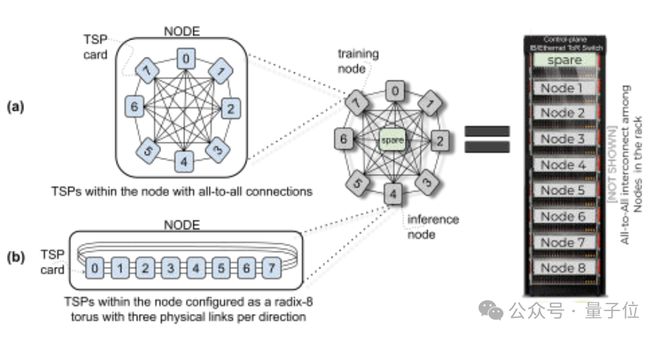

Groq 主要基于该公司自研的 TSP 架构,其内存单元与向量和矩阵深度学习功能单元交错,从而利用机器学习工作负载固有的并行性对推理进行加速。

在运算处理的同时,每个 TSP 都还具有网络交换的功能,可直接通过网络与其他 TSP 交换信息,无需依赖外部的网络设备,这种设计提高了系统的并行处理能力和效率。

结合新设计的 Dragonfly 网络拓扑,hop 数减少、通信延迟降低,使得传输效率进一步提高;同时软件调度网络带来了精确的流量控制和路径规划,从而提高了系统的整体性能。

Groq 支持通过 PyTorch、TensorFlow 等标准机器学习框架进行推理,暂不支持模型训练。

此外 Groq 还提供了编译平台和本地化硬件方案,不过并未介绍更多详情,想要了解的话需要与团队进行联系。

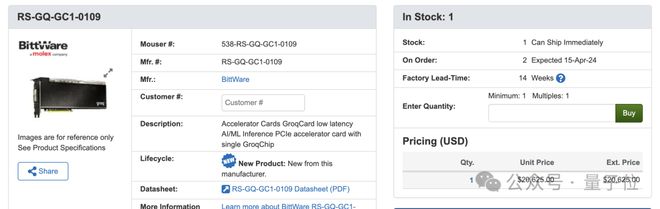

而在第三方网站上,搭载 Groq 芯片的加速卡售价为 2 万多美元,差不多 15 万人民币。

它由知名电子元件生产商莫仕(molex)旗下的 BittWare 代工,同时该厂也为英特尔和 AMD 代工加速卡。

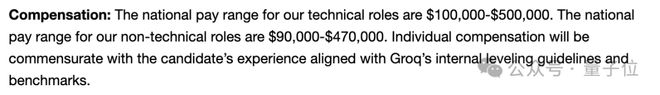

目前,Groq 的官网正在招人。

技术岗位年薪为 10 万-50 万美元,非技术岗位则为 9 万-47 万美元。

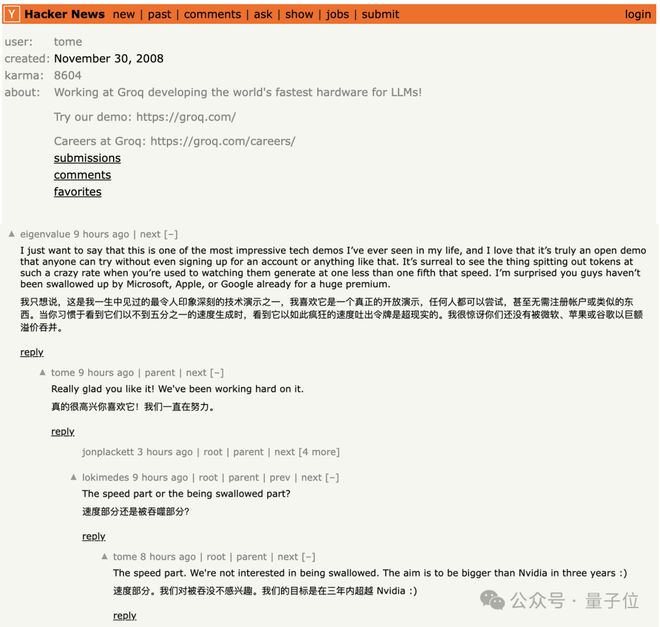

“目标是三年超过英伟达”

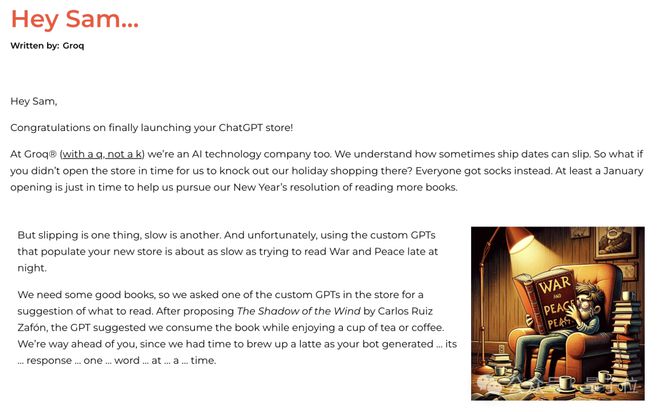

除此之外,这家公司还有个日常操作是叫板喊话各位大佬。

当时 GPTs 商店推出之后,Groq 就喊话奥特曼:用 GPTs 就跟深夜读战争与和平一样慢……阴阳怪气直接拉满~

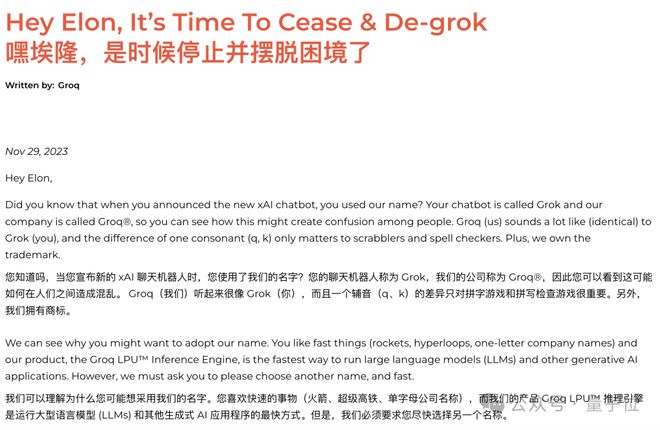

马斯克也曾被它痛斥,说“剽窃”自己的名字。

在最新讨论中,他们疑似又有了新操作。

一名自称 Groq 工作人员的用户与网友互动时表示,Groq 的目标是打造最快的大模型硬件,并扬言:

三年时间内赶超英伟达。

这下好了,黄院士的核武器有新的目标了。

参考链接: