萧箫发自凹非寺

量子位公众号 QbitAI

真·开源 GPT 模型,终于来了。

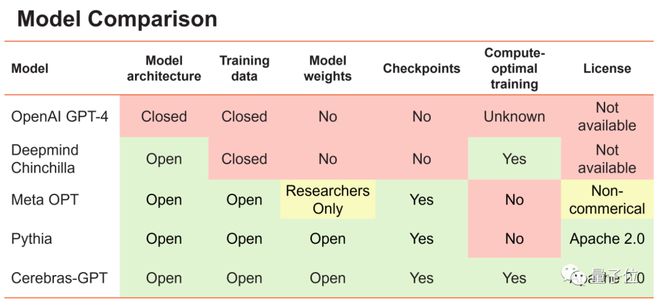

参数量级 130 亿,大小比肩最近 Meta 开放的 LLaMA-13B,但从数据集、模型权重到计算优化训练,全部开源。最关键的是,可商用。没错,虽然就 GPT-3 而言,之前 DeepMind、Meta 等组织陆陆续续开源过几个模型,不过基本都是半遮半掩。尤其最接近 GPT-3 的 Meta OPT 模型,不仅权重只开放给研究者,而且不可商用:

这意味着之前企业就算能抄作业,抄来的也没办法直接用。

现在,一家名叫 Cerebras 的公司开源了这一系列 GPT 模型,业界终于有机会追赶了。

模型性能如何?

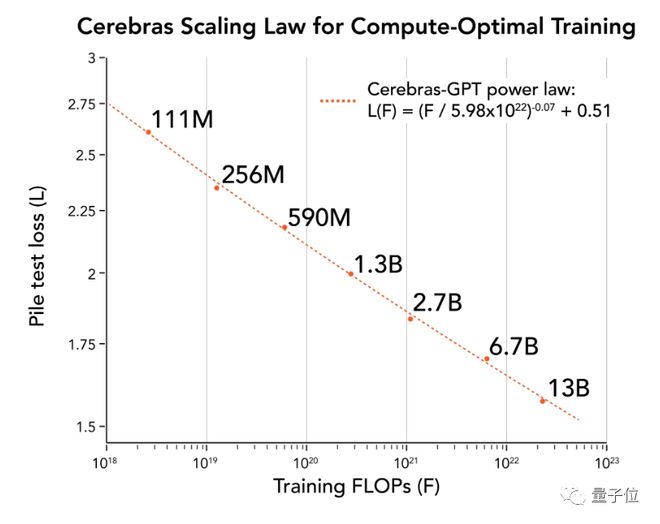

Cerebras 一共开源了 7 个 GPT 模型,参数量分别达到 1.11 亿、2.56 亿、5.9 亿、13 亿、27 亿、67 亿和 130 亿。

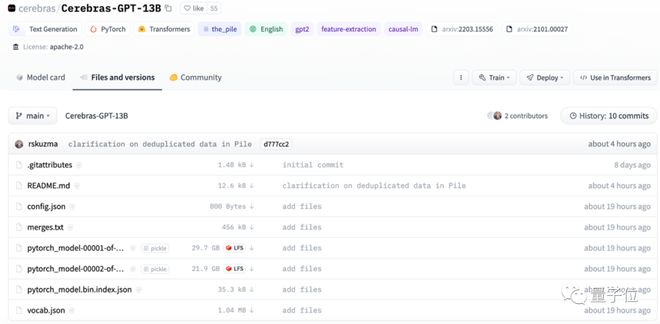

据 Cerebras 公司表示,他们开放出来的模型不仅包含数据集,可用于研究也可商用,而且关键是预训练模型权重开放(从下图来看文件大小近 50G)。

基于他们公开的预训练模型,大伙儿只需要用少量的数据对对模型进行微调,就能构建出效果不错的模型来。除此之外,这次 GPT 模型的训练还额外考虑到了计算优化训练(Compute-Optimal Training)。

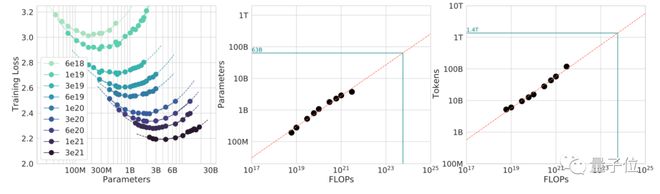

这个方法最早由 DeepMind 在 2022 年提出,名叫 Chinchilla,它认为大语言模型的语料数量和模型效果之间符合一个凸曲线,因此模型参数量和训练程度成一定比例。

依据这个方法,DeepMind 认为,包括 GPT-3 在内的超大参数 LLM 模型,有很多都是训练不足的。基于此,Cerebras 搞出了这一系列 GPT 模型,并将背后的流程进行了开源。

所以,Cerebras-GPT 系列模型性能如何呢?

团队将 Cerebras-GPT 系列和 LLaMA、GPT-3 等模型的性能进行了对比。这是包括 GPT-3、Gopher、Chinchilla 和 LLaMA 在内的其他 GPT 模型,在完成句子、问答等特定任务上表现的效果。

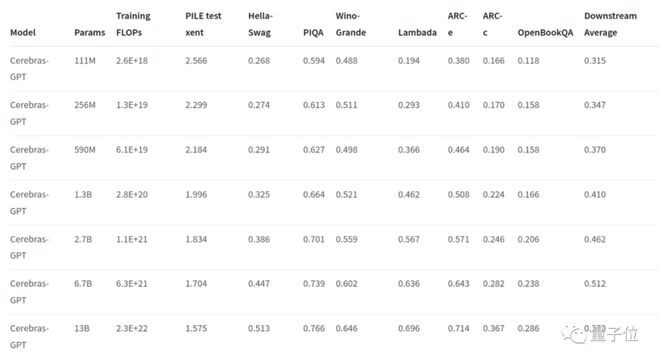

这是不同大小的 Cerebras-GPT 模型零次学习(0-shot)的效果:

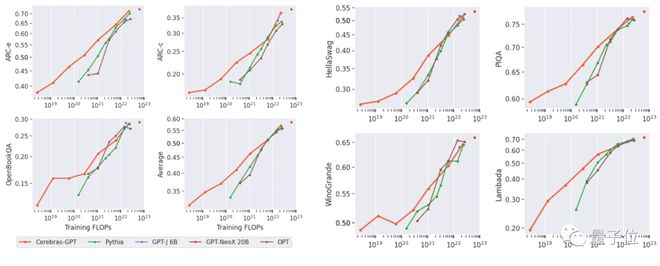

数据对比不是特别直观,团队还将结果进行了可视化。

可以看出,在最终性能相差不大的情况下,Cerebras-GPT 的训练效率要更高一些。

曾开发最大 AI 芯片

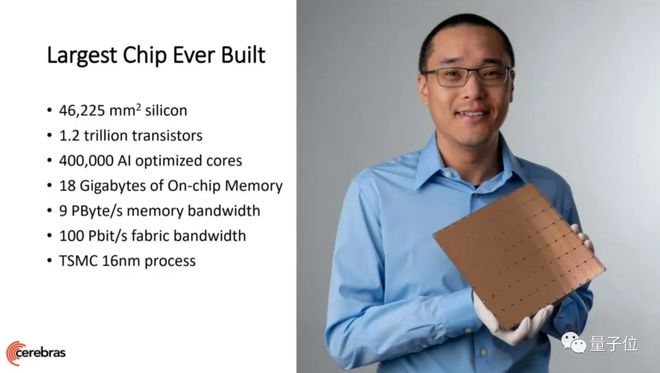

其实,Cerebras 的“本职”是一家 AI 芯片公司。Cerebras 公司由 Sean Lie 和 Andrew Feldman 等人于 2016 年创立。其中,Andrew Feldman 曾创建微型服务器公司 SeaMicro,并以 3.34 亿美元的价格出售给 AMD。与其他 AI 芯片公司不同,Cerebras 开发的芯片超大,像晶圆一样(但确实是芯片):

他们当年做出来过一个名叫“晶圆级引擎”(Cerebras Wafer Scale Engine,简称 WSE)的 AI 芯片,将逻辑运算、通讯和存储器集成到单个硅片上,一口气创下了4 项世界纪录:

- 晶体管数量最多的运算芯片:总共包含 1.2 万亿个晶体管。虽然三星曾造出 2 万亿个晶体管的芯片,却是用于存储的 eUFS。

- 芯片面积最大:尺寸约 20 厘米×23 厘米,总面积 46,225 平方毫米。面积和一块晶圆差不多。

- 片上缓存最大:包含 18GB 的片上 SRAM 存储器。

- 运算核心最多:包含 40 万个处理核心。

后来这个超大 WSE 又升级了二代,然后团队基于 WSE-2 打造出了一个名叫 Cerebras CS-2 的 AI 超算。

这次的 Cerebras-GPT 系列模型,就是在这个 Cerebras CS-2 的 AI 超算中训练出来的。对此这家公司表示:虽然训练这么大体量的模型通常需要几个月时间,但我们几周就能搞定。

Cerebras 还表示,虽然很多硬件公司都声称训练效果能接近英伟达 GPU的水平,但他们还没看到任何一家亲自推动开源 LLM 的硬件公司,这势必不利于开源 LLM 的发展。

这波啊,这波 Cerebras 格局大了(手动狗头)

模型地址:

https://huggingface.co/cerebras/Cerebras-GPT-13B

参考链接:

https://www.cerebras.net/blog/cerebras-gpt-a-family-of-open-compute-efficient-large-language-models/