原标题:大脑视觉信号被 Stable Diffusion 复现图像!日本新研究炸了

丰色萧箫发自凹非寺

量子位公众号 QbitAI

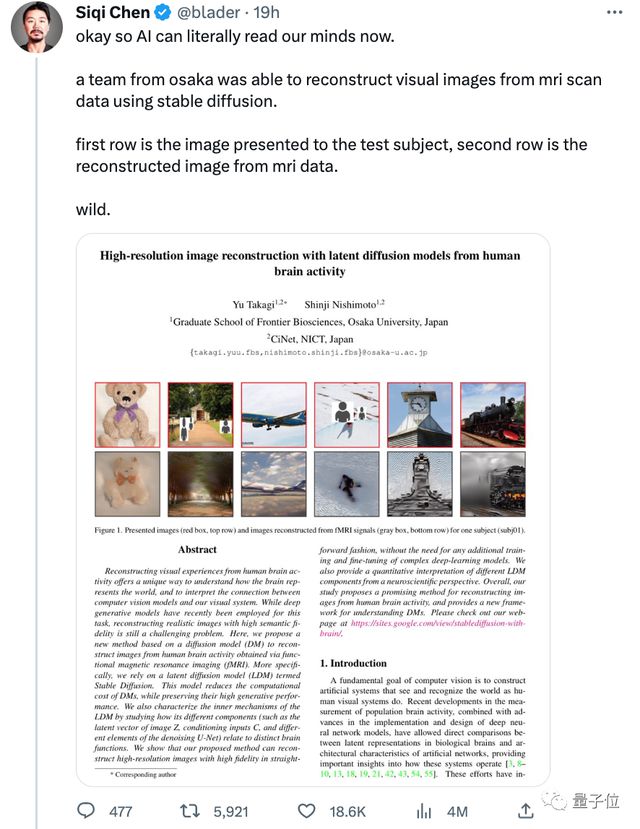

“现在 Stable Diffusion 已经能重建大脑视觉信号了!”

就在昨晚,一个听起来细思极恐的“AI 读脑术”研究,在网上掀起轩然大波:

这项研究声称,只需用 fMRI(功能磁共振成像技术,相比 sMRI 更关注功能性信息,如脑皮层激活情况等)扫描大脑特定部位获取信号,AI 就能重建出我们看到的图像!

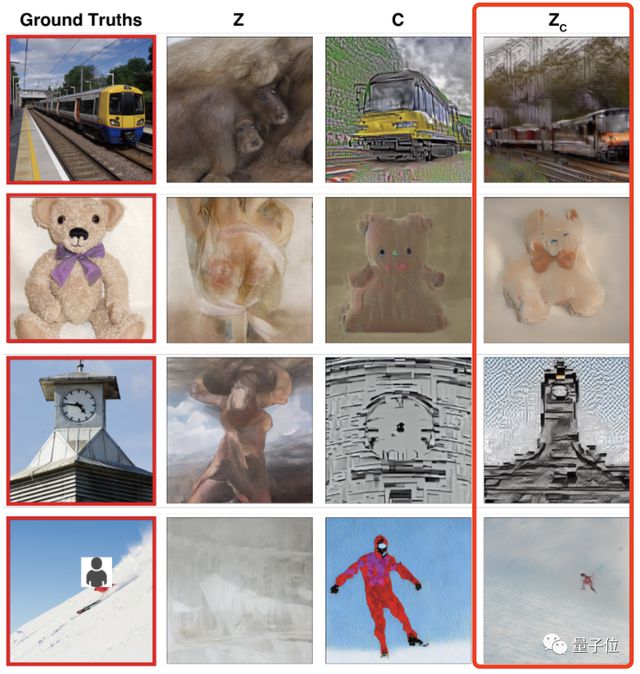

例如这是一系列人眼看到的图像,包括戴着蝴蝶结的小熊、飞机和白色钟楼:

AI 看了眼人脑信号后,立马就给出这样的结果,属实把该抓的重点全都抓住了:

再发展一步,这不就约等于哈利波特里的读心术了吗??

更有网友感到惊叹:如果说 ChatGPT 开放 API 是件大事,那这简直称得上疯狂。

所以,这究竟是怎么一回事?

用 Stable Diffusion 可视化人脑信号

这项研究来自日本大阪大学,目前已经被 CVPR 2023 收录:

研究希望能从人类大脑活动中,重建高保真的真实感图像,来理解大脑、并解读计算机视觉模型和人类视觉系统之间的联系。

要知道,此前虽然有不少脑机接口研究,致力于从人类大脑活动中读取并重建信号,如意念打字等。

然而,从人类大脑活动中重建视觉信号——具有真实感的图像,仍然挑战极大。

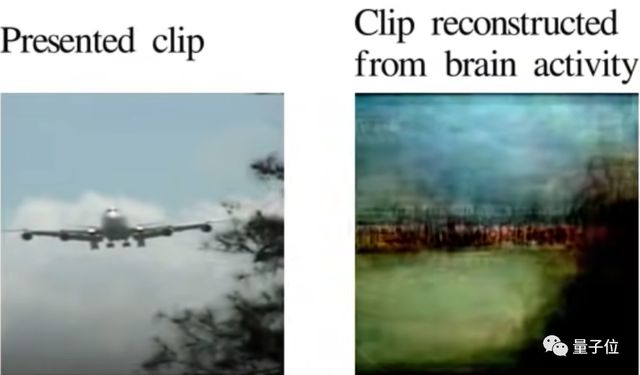

例如这是此前 UC 伯克利做过的一项类似研究,复现一张人眼看到的飞机片段,但计算机重建出来的图像却几乎看不出飞机的特征:

△图源 UC 伯克利研究 Reconstructing Visual Experiences from Brain Activity Evoked by Natural Movies

这次,研究人员重建信号选用的 AI 模型,是这一年多在图像生成领域地位飞升的扩散模型。

当然,更准确地说是基于潜在扩散模型(LDM)——Stable Diffusion。

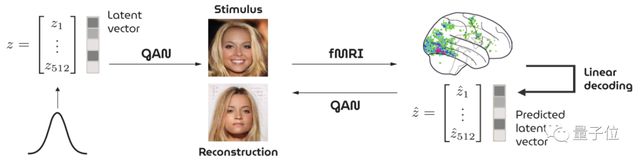

整体研究的思路,则是基于 Stable Diffusion,打造一种以人脑活动信号为条件的去噪过程的可视化技术。

它不需要在复杂的深度学习模型上进行训练或做精细的微调,只需要做好 fMRI(功能磁共振成像技术)成像到 Stable Diffusion 中潜在表征的简单线性映射关系就行。

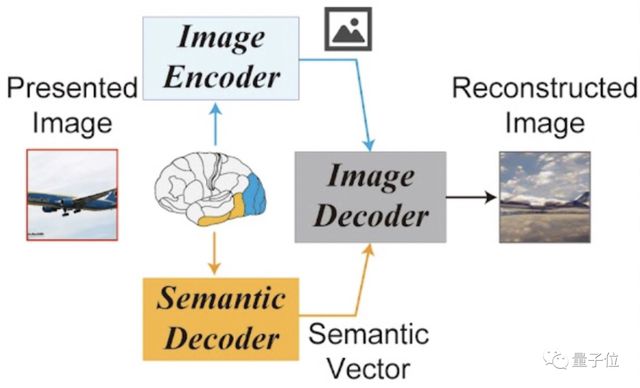

它的概览框架是这样的,看起来也非常简单:

仅由 1 个图像编码器、1 个图像解码器,外加 1 个语义解码器组成。

具体怎么 work?

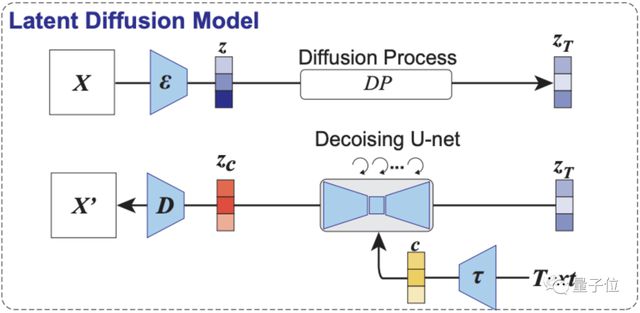

如下图所示,第一部分为本研究用到的 LDM 示意图。

其中ε代表图像编码器,D代表图像解码器,而τ是一个文本编码器(CLIP)。

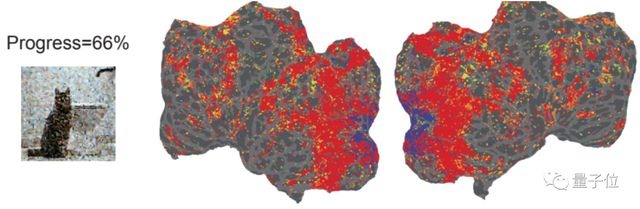

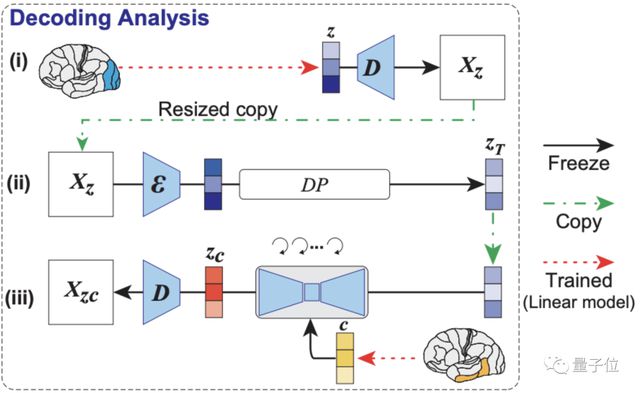

重点是解码分析,如下图所示,模型依次从大脑早期(蓝色)和较高(黄色)视觉皮层内的 fMRI 信号中,解码出重建图像(z)和相关文本c的潜在表征。

然后将这些潜在特征当作输入,就可以得到模型最终复现出来的图像 Xzc。

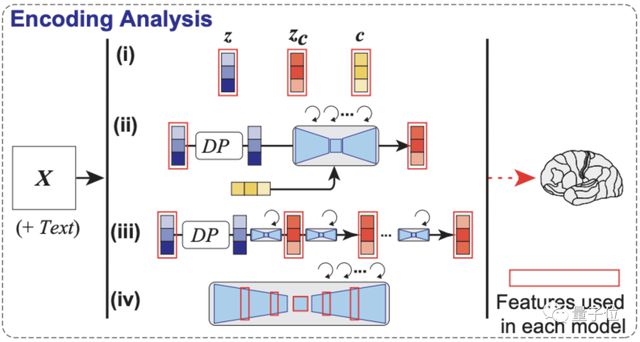

最后还没有完,如编码分析示意图,作者还构建了一个编码模型,用来预测 LDM 不同组件(包括图像z、文本c和 zc)所对应的 fMRI 信号,它可以用来理解 Stable Diffusion 的内部过程。

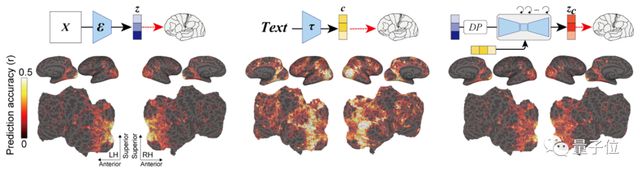

可以看到,采用了 zc 的编码模型在大脑后部视觉皮层产生的预测精确度是最高的。(zc 是与c进行交叉注意的反向扩散后,z再添加噪声的潜在表征)

相比其他两者,它生成的图像既具有高语义保真度,分辨率也很高。

还有用 GAN 重建人脸图像的

看完这项研究,已经有网友想到了细思极恐的东西:这个 AI 虽然只是复制了“眼睛”所看到的东西。

但是否会有一天,AI 能直接从人脑的思维、甚至是记忆中重建出图像或文字?

“语言的用处不再存在了”

于是有网友进一步想到,如果能读取记忆的话,那么目击证人的证词似乎也会变得更可靠了:

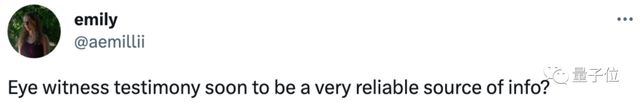

还别说,就在去年真有一项研究基于 GAN,通过 fMRI 收集到的大脑信号重建看到的人脸图像:

不过,重建出来的效果似乎不怎么样……

显然,在人脸这种比较精细的图像生成上,AI“读脑术”还有很长一段路要走。

对于这种大脑信号重建的研究,也有网友提出了质疑。

例如,是否只是 AI 从训练数据集中提取出了相似的数据?

对此有网友回复表示,论文中的训练数据集和测试集是分开的:

作者们也在项目主页中表示,代码很快会开源。可以先期待一下~

作者介绍

本研究仅两位作者。

一位是 2021 年才刚刚成为大阪大学助理教授的 Yu Takagi,他主要从事计算神经科学和人工智能的交叉研究。

最近,他同时在牛津大学人脑活动中心和东京大学心理学系利用机器学习技术,来研究复杂决策任务中的动态计算。

另一位是大阪大学教授 Shinji Nishimoto,他也是日本脑信息通信融合研究中心的首席研究员。

研究方向为定量理解大脑中的视觉和认知处理,谷歌学术引用 3000+ 次。

那么,你觉得这波 AI 重建图像的效果如何?

项目地址:

https://sites.google.com/view/stablediffusion-with-brain/

参考链接:

[1]https://twitter.com/SmokeAwayyy/status/1631474973243236354

[2]https://twitter.com/blader/status/1631543565305405443