丰色发自凹非寺

量子位公众号 QbitAI

ChatGPT 中有这样一个核心训练方法,名叫“人类反馈强化学习(RLHF)”。它可以让模型更安全、输出结果更遵循人类意图。现在,来自谷歌 Research 和 UC 伯克利的研究人员发现,将该方法用在 AI 绘画上,“治疗”图像跟输入不完全匹配的情况,效果也奇好——可以实现高达 47% 的改进。

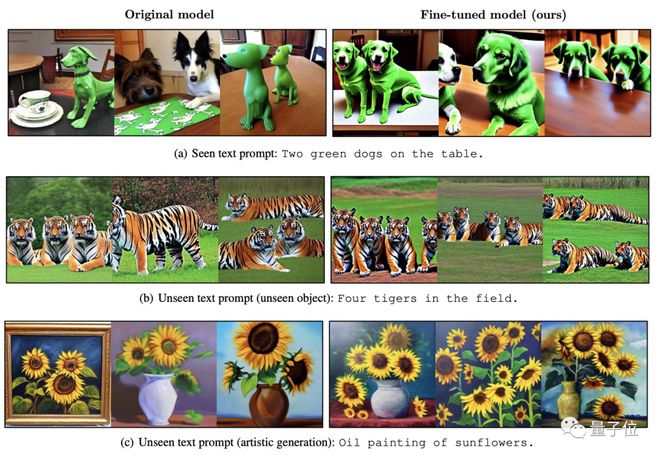

△ 左为 Stable Diffusion,右为改进后效果

这一刻,AIGC 领域中两类大火的模型,似乎找到了某种“共鸣”。

如何将 RLHF 用于 AI 绘画?

RLHF,全称“Reinforcement Learning from Human Feedback”,是 OpenAI 和 DeepMind 于 2017 年合作开发的一种强化学习技术。

正如其名,RLHF 就是用人类对模型输出结果的评价(即反馈)来直接优化模型,在 LLM 中,它可以使得“模型价值观”更符合人类价值观。

而在 AI 图像生成模型中,它可以让生成图像与文本提示得到充分对齐。

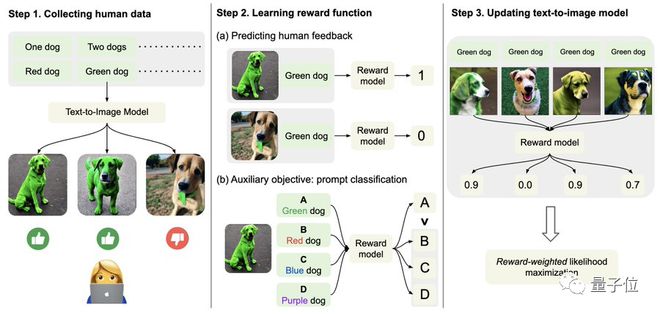

具体而言,首先,收集人类反馈数据。

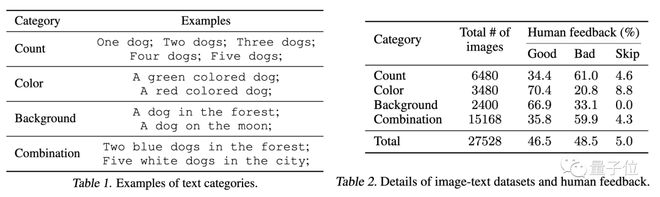

在这里,研究人员一共生成了 27000 余个“文本图像对”,然后让一些人类来打分。

为了简单起见,文本提示只包括以下四种类别,分别关乎数量、颜色、背景和混合选项;人类的反馈则只分“好”、“坏”与“不知道(skip)”。

其次,学习奖励函数。

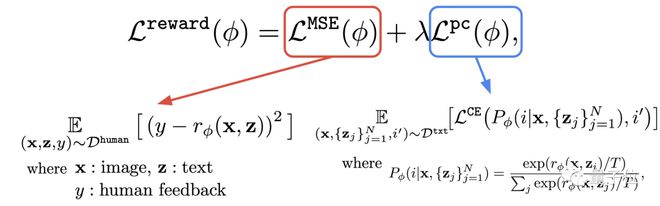

这一步,就是利用刚刚获得的人类评价组成的数据集,训练出奖励函数,然后用该函数来预测人类对模型输出的满意度(公式红色部分)。

这样,模型就知道自己的结果究竟有几分符合文本。

除了奖励函数,作者还提出了一个辅助任务(公式蓝色部分)。

也就是当图像生成完成后,模型再给一堆文本,但其中只有一个是原始文本,让奖励模型“自己检查”图像是否跟该文本相匹配。

这种逆向操作可以让效果得到“双重保险”(可以辅助下图中的 step2 进行理解)。

最后,就是微调了。

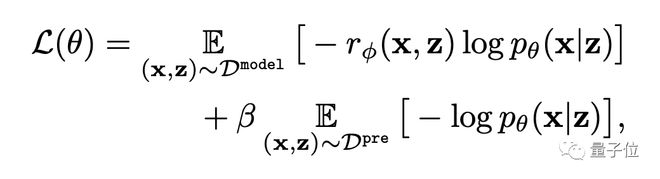

即通过奖励加权最大似然估计(reward-weighted likelihood maximization)(下公式第一项),更新文本-图像生成模型。

为了避免过拟合,作者对预训练数据集上的 NLL 值(公式第二项)进行了最小化。这种做法类似于 InstructionGPT(ChatGPT 的“直系前辈”)。

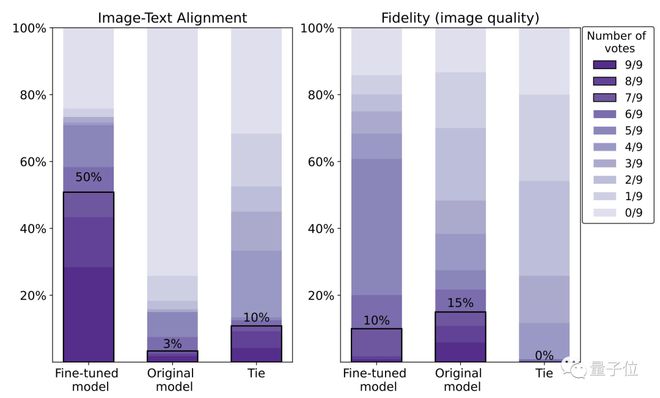

效果提升 47%,但清晰度下滑5%

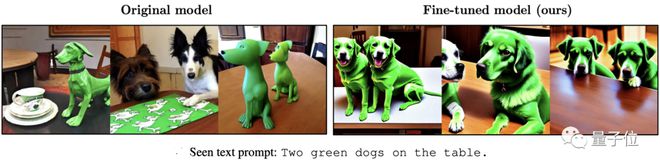

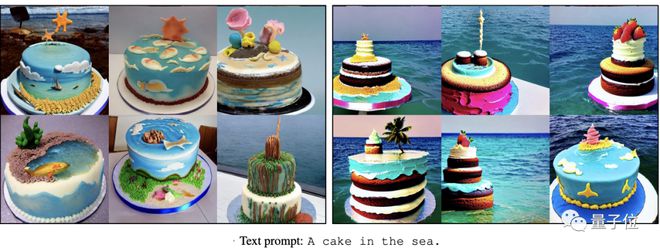

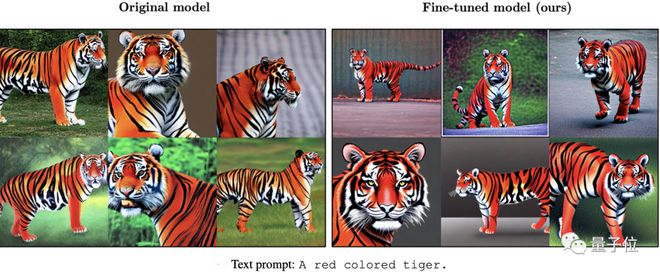

如下一系列效果所示,相比原始的 Stable Diffusion,用 RLHF 微调过后的模型可以:

(1)更正确地 get 文本里的“两只”和“绿色”;

(2)不会忽略“大海”作为背景的要求;

(3)想要红老虎,能给出“更红”的结果。

从具体数据来看,微调后的模型人类满意度为 50%,相比原来的模型(3%),得到了 47% 的提高。

不过,代价是失去了5% 的图像清晰度。

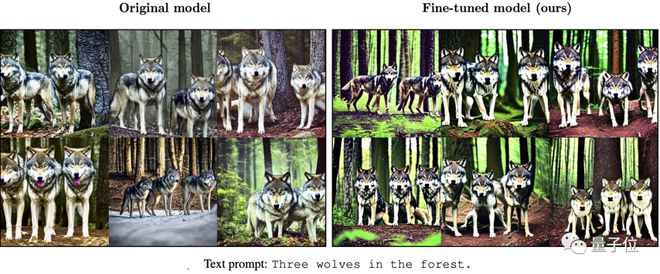

从下图我们也能很清楚的看到,右边的狼明显比左边的糊一些:

对此,作者表示,使用更大的人类评价数据集和更好的优化(RL)方法,可以改善这种情况。

关于作者

本文一共 9 位作者。

一作为谷歌 AI 研究科学家 Kimin Lee,韩国科学技术院博士,博士后研究在 UC 伯克利大学展开。

华人作者三位:

Liu Hao,UC 伯克利在读博士生,主要研究兴趣为反馈神经网络。

Du Yuqing,同 UC 伯克利博士在读,主要研究方向为无监督强化学习方法。

Shixiang Shane Gu (顾世翔),通讯作者,本科师从三巨头之一 Hinton,博士毕业于剑桥大学。

△ 顾世翔

值得一提的是,写这篇文章时他还是谷歌人,如今已经跳槽至 OpenAI,并在那里直接向 ChatGPT 负责人报告。

论文地址:

https://arxiv.org/abs/2302.12192

参考链接: