新智元报道

编辑:LRS

首发长故事生成器 Re3 两个月后,田渊栋团队再次更新第二版 DOC,连贯性、一致性再次大幅提升!

前段时间田渊栋博士团队在 EMNLP2022 上发布了一个基于大规模语言模型的故事生成器 Re3(Recursive Reprompting and Revision)框架,通过设计 prompt 让模型生成一致性强的故事,完全不需要微调大模型,最长可以生成 7500 词的故事。

最近 Re3 的作者团队又发布了第二版长故事生成框架 DOC(Detailed Outline Control),使用层次化的大纲(outline)对故事进行更细节的描绘,并使用微调后的 OPT-350m 模型对生成的内容进行更连贯的续写,相比之下,人类评估后认为 DOC 比上一代 Re3 的写作能力更强。

论文链接:https://arxiv.org/abs/2212.10077

论文链接:https://github.com/yangkevin2/doc-story-generation

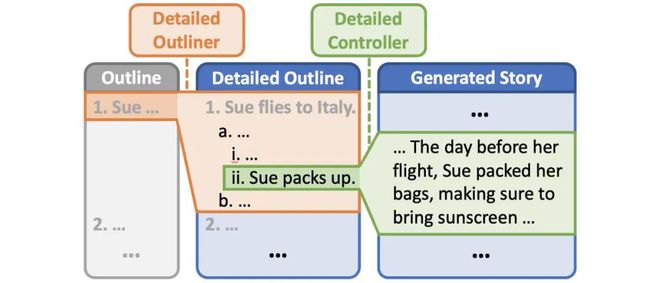

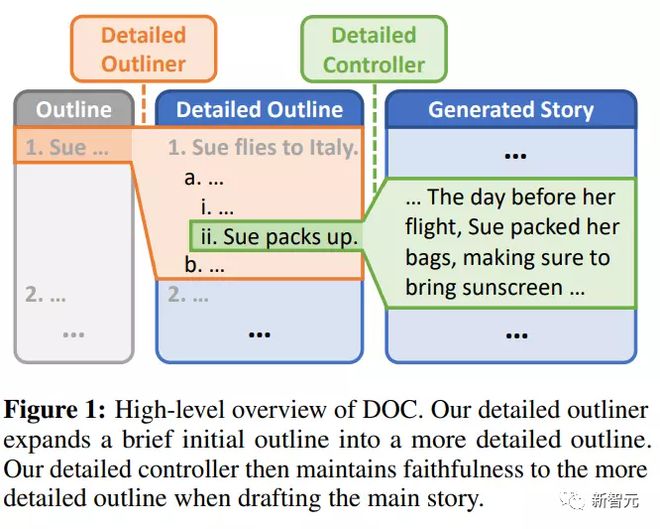

DOC 由两个互补的组件组成:

1. 详细大纲生成器(detailed outliner)可以创建一个更详细的、分层结构的大纲,将创造性的工作从主起草(drafting)过程转移到规(planning)划阶段;

2. 详细的控制器(detailed controller)通过控制故事段落与大纲细节保持一致,确保更详细的大纲在生成过程中仍然能够发挥作用。

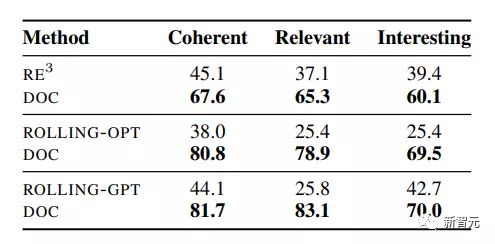

在自动生成故事的人类评估中,DOC 在情节一致性上取得 22.5% 的绝对增益,大纲相关性提升 28.2%,趣味性提升 20.7%,大大优于先前的 Re3 基线模型,并且人类评估者还认为 DOC 在交互式生成环境中更容易控制。

文章的第一作者 Kevin Yang 是加州大学伯克利分校的四年级博士生,主要研究兴趣为结构化设置下的可控自然语言文本生成,如利用可控生成的结构化方法来改善长篇文本的一致性。

第二作者田渊栋博士是 Meta 人工智能研究院研究员、高级经理,其研究方向为深度增强学习及其在游戏中的应用,以及深度学习模型的理论分析。先后于 2005 年及 2008 年获得上海交通大学本硕学位,2013 年获得美国卡耐基梅隆大学机器人研究所博士学位。

DOC 框架

随着自然语言技术的不断发展,大规模语言模型对于短文本的理解逐渐接近瓶颈,人们对生成更长的文本逐渐产生兴趣,比如一次生成数千个单词。

与短文本生成任务相比,长文本包含的内容和限制也更多,模型需要保持总体一致性,长期事实一致性,还要保持与用户输出的前提或计划保持相关性。

与人类相比,像 Re3 这样的故事生成系统在许多方面仍然存在不足,例如无法保证长距离下的剧情连贯性,全局不一致,故事内容偏离设定的计划等。

为了弥补这一差距,详细大纲控制(DOC)框架在重复使用 Re3 的高层次规划起草修订(panning-drafting-revision)结构的同时,通过两种互补的方法提高了长期一致性。

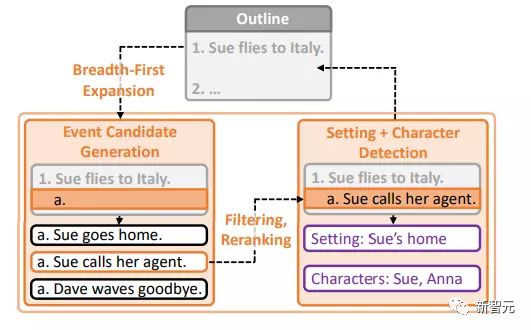

详细大纲

首先,detailed outliner 将一个简短的初始大纲细化为一个更详细、层次化的大纲,这样设计的原因是人类作者可能在起草一份长文档之前迭代地细化和扩展一个简短的初始大纲。

与即兴创作新的情节点相比,作者可能会在高层次大纲阶段计划一个连贯的总体情节,使用扩展的大纲在起草过程中提供更详细的指导。

在起草阶段,研究人员重用了 Re3 重写阶段的大纲相关性和文本连贯性重排序,以检测当前大纲项目何时完成了一段文章,并基于分数阈值实现提前停止。

大纲中有完整的设置和相关的角色,每个大纲项目都经过仔细筛选,以确保上下文中的相关性和连贯性。

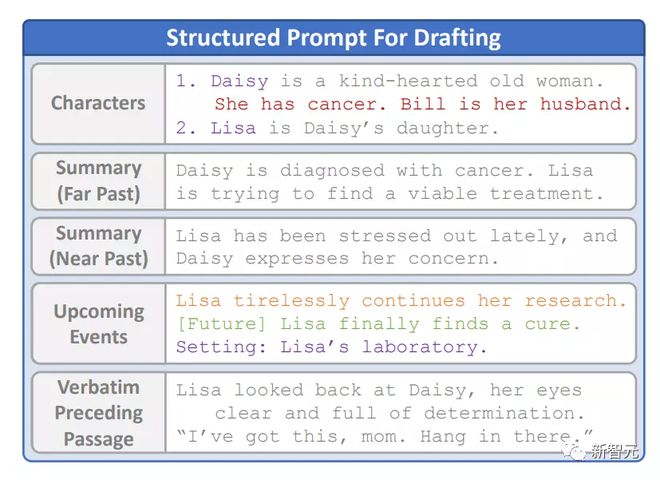

在结构化 prompt 中,模型会突出显示当前设置、设置中的更改,还会根据大纲中检测到的角色检索角色描述。

相比之下,Re3 在起草过程中为每一段动态选择相关角色,并且不跟踪设置信息,这可能会导致故事设置发生意外变化

详细控制器

第二个组件详细控制器(detailed controller)通过基于相应的大纲项目控制段落生成来保持对详细大纲的忠实性。

因为详细大纲强加了许多重叠的软约束,所以详细控制器必须施加足够的控制强度,同时详细控制器还必须适应灵活的自然语言输入,并在使用最先进的大型语言模型生成时具有计算效率。

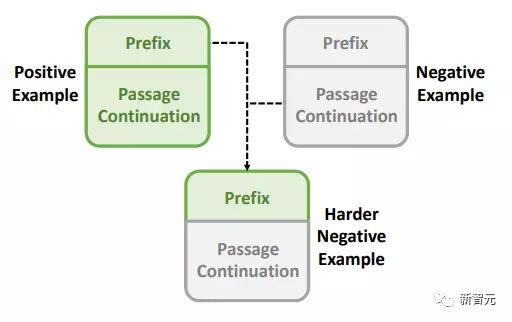

所以研究人员将详细控制器实现为基于 OPT350m 的控制器,设计了一个对比训练程序,将摘要与段落前缀对齐。

最关键的是,研究人员还构建了许多流畅的硬负例(fluent hard negatives),以促进生成的段落不仅在开始时与主题相关,而且贯穿始终。

实验部分

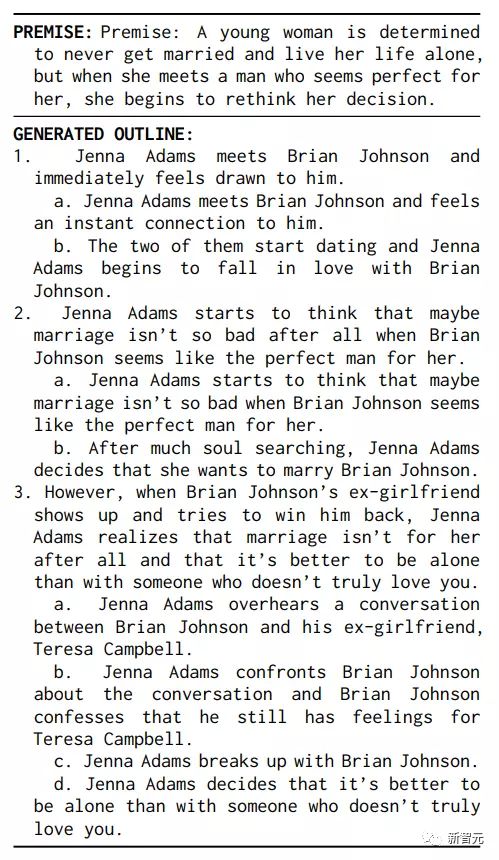

在实验中,模型的输入只是一个简短的英语前提(premise),通常 30-60 个单词,输出是一个完整的故事。

研究人员没有施加更多规则上的约束,因为「故事」的定义还不明确,更不用说定义「好故事」了,质量好坏主要依赖人工评估指标。

在评价上主要使用三个指标,更适用于比较段落而非完整的故事:

1. 连贯性,人类标注员判断情节连贯的段落百分比;

2. 相关性,被判断为符合相应大纲条目的段落百分比;

3. 趣味性,被认为有趣的段落百分比。

对比的基线模型包括 Re3, ROLLING-OPT 和 ROLLING-GPT。

在实验结果可以看到,与 Re3 相比,标注人员认为 DOC 生成的情节更加连贯,与大纲更加相关,相比 ROLLING 基线提升更高。

并且结果证实了模型设计的正确性,即剧情连贯性和大纲相关性得益于将创意工作从规划转向起草,以及改进的控制机制。

而且令人意外的是,标注人员还认为 DOC 的段落明显更有趣,研究人员认为这是更详细(更具事件性)大纲带来的进步,进一步的消融实验也支持了这一假设。

不过定性分析也揭示了该模型仍然有进一步改进的巨大空间。

与 RE3 不同的是,DOC 通常不会严重偏离顶层大纲,而 RE3 有时几乎完全偏离主题,但 DOC 通常无法遵循详细大纲的较低层次部分。

DOC 和 RE3 中的内部一致性仍然存在问题,详细大纲中偶尔出现的错误可能会造成特别大的负面影响,从而在起草过程中导致更大的级联错误。

此外,DOC 中的大纲往往在细节层次上不一致,有些过于模糊,而另一些似乎过于展开(over-expanded)。

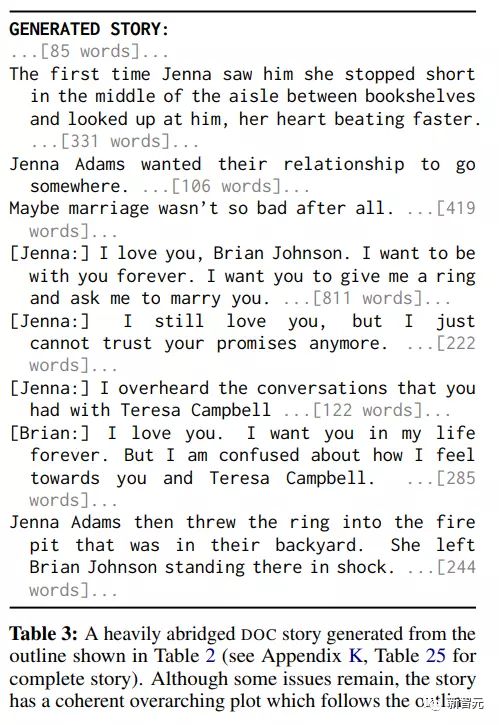

此外,模型检测到的设置和角色有时也会不正确或不完整,下面的例子显示了 DOC 根据上述大纲编写的一篇删节严重的故事。

参考资料: