Pine 发自凹非寺

量子位公众号 QbitAI

输入一段台词,让照片“演戏”又进阶了!

这次的 AI 直接让“演技”整体上了一个台阶,表演生气、开心、可怜……各种情绪都不在话下。

并且,口型、眼神、头部动作也都让这个 AI 狠狠拿捏住了!

甚至还能调节喜怒哀乐的程度。

这是英伟达最新推出的一款 AI,名为 SPACEx(此 SPACEx 非马斯克的 SpaceX),全称是可控表达的语音驱动肖像动画(Speech-driven Portrait Animation with Controllable Expression)。

其实,在英伟达推出 SPACEx 之前,已经有不少语音驱动照片的 AI 问世,那相较于之前那些 AI,SPACEx 有什么优势呢?

人脸动作更稳定,更注重细节

此前,最常使用的语音驱动照片的 AI 主要有三个:PC-AVS、MakeItTalk 和 Wav2Lip。

但这三个 AI 都或多或少有些缺陷之处,并且要么只能对口型,要么就只是整体面部控制的比较好,多个功能往往不能兼顾。

先来说说 PC-AVS,它在对图像和语音进行处理时,会对输入图像进行严格的剪裁,甚至还会改变姿势,此外,生成的人脸动作很不稳定。

而 MakeItTalk,在对口型方面效果不是很好,有时候生成的视频中还会出现空白的地方。

Wav2Lip 的功能则比较单一,它主要是配音 AI,只改变唇部的动作,唇部之外的面部表情毫无变化。

而这些问题,在 SPACEx 身上通通都被解决掉了,话不多说,直接看看它们之间的效果对比!

可以看出,无论是细节的口型、眼神,还是整体的面部动作,SPACEx 都会更加自然一些。

而细分到各个具体的功能,SPACEx 都集成了哪些功能呢?

下面这个表格给出了答案,情绪控制、标记面部 landmark、头部转动和动作生成,SPACEx 都能很好地兼顾,不会像以往的模型顾此失彼。

值得注意的是,SPACEx 生成视频的质量也整体上升了一个台阶,以往同类型的 AI 最高只能达到 384 的分辨率,而 SPACEx 这次已经达到了 512X512。

兼顾这么多功能还能生成高质量视频,SPACEx 又是怎样做到的呢?

具体原理

其中,很大一部分功劳是 face-vid2vid 贡献的,它是英伟达两年前公布的一个 AI 算法。

它不仅能压缩视频的流量,还能保证视频的画质。

并且,face-vid2vid 还能让视频中的人物随意扭头。

不过它要求输入的是一个视频,而 SPACEx 则是一个图片,它俩又是怎么关联到一起的?

这得从 SPACEx 生成视频的过程来看,主要分三个阶段。

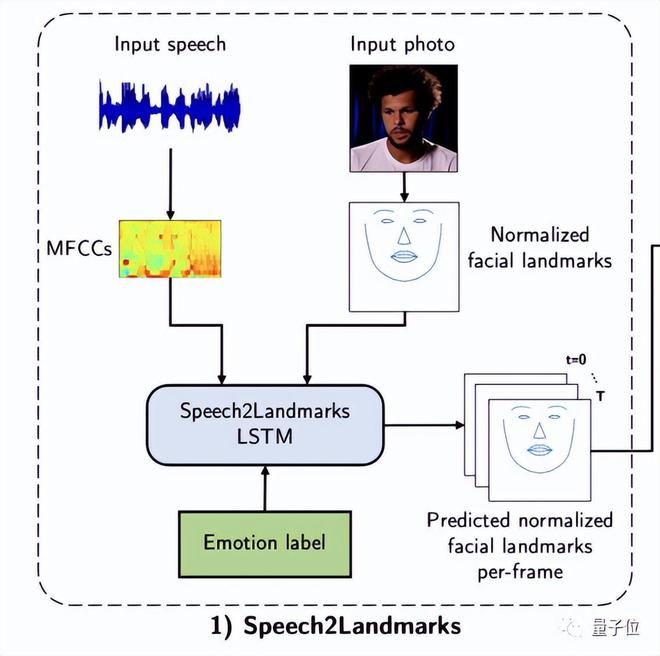

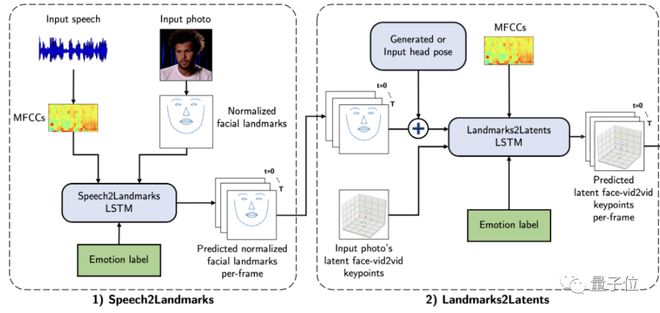

第一个阶段可以概括为 Speech2Landmarks,即从输入的语音中来预测各个音节所对应的标准面部 landmarks。

在预测的过程中,还会插入对应的情绪标签。

预测好面部 landmarks 后,来到第二步:Landmarks2Latents,输入各个图像的 face-vid2vid 关键点,以控制整个面部表情。

然后将这些关键点对应到上一步输出的标准面部 landmarks 上。

最后一步便能通过 face-vid2vid 生成器来生成视频了。

话说回来,当然 SPACEx 也不是个全能选手,当输入有较大的头部旋转时,现有的方法表现就不是很好了。

不过还是值得一试的,感兴趣可以戳下文链接~

论文地址:

https://arxiv.org/pdf/2211.09809.pdf

参考链接: