微博的人工智能部门推出了开源的 VibeThinker-1.5B,这是一个拥有 15 亿参数的大型语言模型(LLM),基于阿里巴巴的 Qwen2.5-Math-1.5B 进行的精细调整。

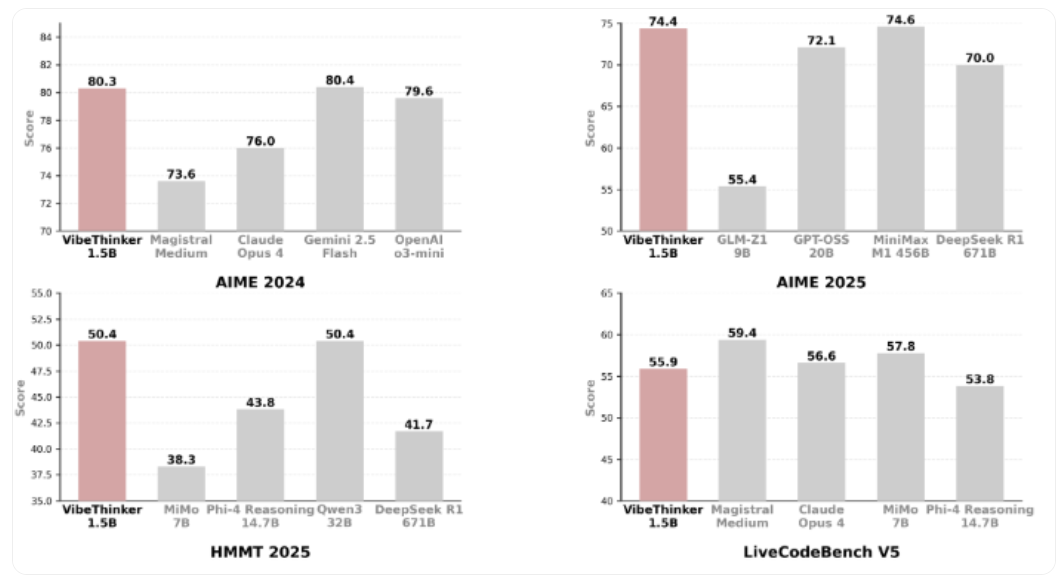

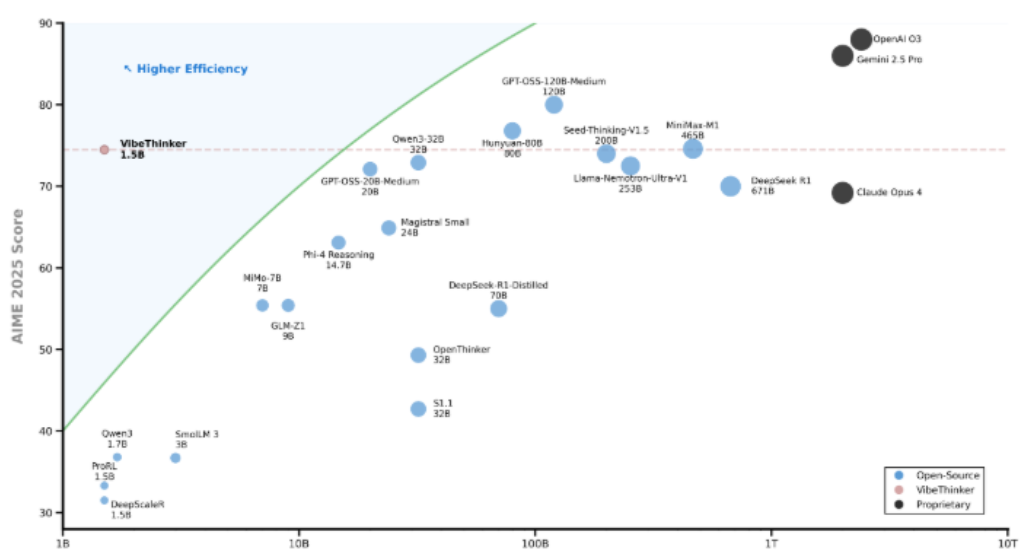

尽管 VibeThinker-1.5B 体积小,但在数学和代码任务上表现出色,达到了行业领先的推理性能,甚至超越了体量达 6710 亿参数的竞争对手 DeepSeek 的 R1 模型。该模型还与 Mistral AI 的 Magistral Medium、Anthropic 的 Claude Opus4 和 OpenAI 的 gpt-oss-20B Medium 等多个大型模型抗衡,同时所需的基础设施和投资成本却少得多。

值得一提的是,VibeThinker-1.5B 在后期训练中仅花费了 7800 美元的计算资源,这一成本远低于同类或更大规模模型所需的数十万美元甚至数百万美元。LLM 的训练分为两个阶段,首先是预训练,模型通过大量文本数据学习语言结构和一般知识。之后的后期训练则使用更小的高质量数据集,使模型能够更好地理解如何提供帮助、进行推理和与人类期望对齐。

VibeThinker-1.5B 采用了一种名为 “谱 - 信号原则”(Spectrum-to-Signal Principle,SSP)的训练框架,该框架将监督微调和强化学习分为两个阶段。第一个阶段注重多样性,第二个阶段则通过强化学习优化最优路径,使得小模型也能有效探索推理空间,从而实现信号放大。

在多个领域的性能测试中,VibeThinker-1.5B 的表现也超过了许多大型开源和商业模型。其开放源代码的发布,打破了对模型参数规模和计算强度的传统看法,展示了小型模型在特定任务中也能取得优异表现的可能性。